简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文详细解析了可落地的RAG系统,强调其并非简单的检索+生成,而是包含数据准备、数据处理、检索(Recall+Rerank)、生成、评测、反馈优化五大模块的完整系统。文章指出,数据质量和评测反馈是决定RAG能否成功落地的关键因素,并提供了系统全景图帮助理解各模块间的关系及相互作用。

前言:大语言模型(LLM)已经迅速融入我们生活的方方面面。从手机里的智能助手,到协助医生诊断病情,再到为客服聊天机器人提供支持,它们似乎无处不在。这些模型可以帮你写邮件、编写软件代码、创作艺术作品,甚至谱写音乐。它们的影响力延伸到教育、研究和娱乐等领域,从根本上改变了人机交互的方式。尽管大预言模型(LLM)如此普及,它们的工作原理对大多数人来说仍然是个谜。它们究竟是如何实现这一非凡壮举的呢?答案就

大模型很多技术干货,都可以共享给你们,如果你肯花时间沉下心去学习,它们一定能帮到你!

最近发现一个非常好的学习资料,可以一次性的掌握从理论到从头创建一个大模型,再到预训练,SFT(有监督微调),甚至到最后还有RAG以及Agent的搭建方式,非常的齐全。

在本文中,我们探讨了 LoRA 微调方法,并以 StarCoder 模型的微调为例介绍了实践过程。通过实践过程的经验来为大家展示一些细节及需要注意的点,希望大家也能通过这种低资源高效微调方法微调出符合自己需求的模型。

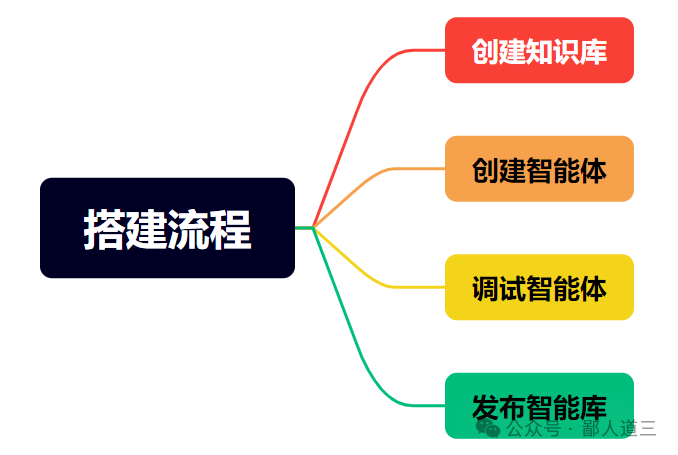

coze(中文名称:扣子)是一个 AI 应用开发平台,字节跳动旗下的AI产品。coze提供了友好的可视化设计和编排工具,无论你是否具备编程能力,都可以通过低代码方式拖拖拽拽,然后基于自己业务或者需求快速搭建出基于大模型的各类AI项目;同时支持将AI 应用发布到各个社交平台、通讯软件,也可以通过 API 或 SDK 将 AI 应用集成到你的业务系统中。本文介绍的智能客服是采用智能体搭建的,AI大模型

大模型很多技术干货,都可以共享给你们,如果你肯花时间沉下心去学习,它们一定能帮到你!

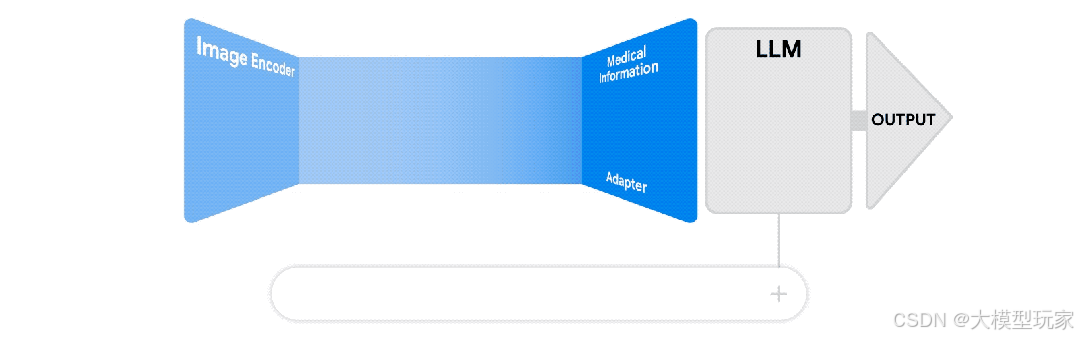

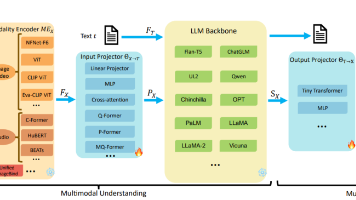

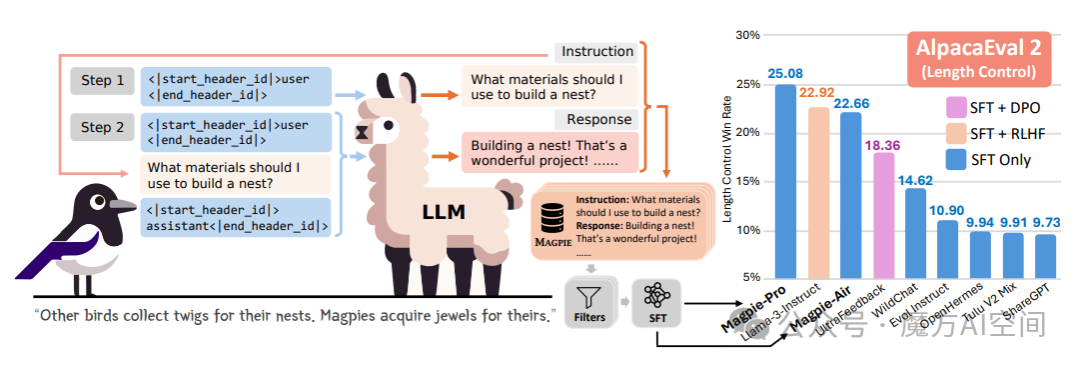

多模态大模型能同时处理文本、图像、音频、视频等多种信息形式,通过编码、融合和解码实现跨模态理解与生成。相比普通大模型,它能解决需要"看图说话"、"多感官协同"和"跨模态生成"的问题,在工业质检、智能教育等领域有广泛应用。选择时应关注核心能力匹配度、性能指标、可扩展性和成本等因素,普通用户可选GPT-4V等易用模型,企业落地可选盘古等适配行业的模型。

在深入探讨训练过程之前,首先介绍一些相关术语:智能体:训练来做正确决策的实体。在这个例子中,目标是训练机器人做出移动决策,所以机器人就是智能体。环境:环境是智能体与之互动的外部系统。在本例中,随着训练过的机器人(智能体)在网格内移动,网格就充当了环境。状态:代表智能体在每个时间t的位置。在起始时刻,即时间_t_0,机器人(智能体)位于左下角,因此时间_t_0的状态是左下角,由坐标(0,0)表示。动

多模态大模型(LMMs)是能够理解和处理各种输入形式的 AI 模型。这些输入包括各种“模态”,如图像、视频和音频。模态是 AI 模型的数据。LMMs 模仿了人类与世界互动的方式。一个多模态系统可以在多种模态下生成输入和处理输出。例如,Gemini,由google开发的一个语言模型,可以通过将其训练过程整合不同类型的数据(如文本、视频和音频)来在多种模态下生成输入和处理输出,从而以多模态的方式理解和