简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

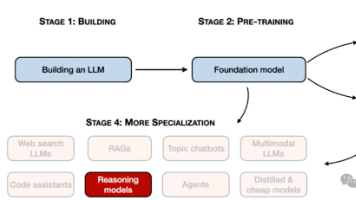

在人工智能的发展历程中,通用人工智能(AGI)一直是研究者们追求的终极目标,AGI旨在构建一个能够像人类一样在多种领域和任务中表现出智能的系统。2023年来,随着 AI 研究的不断进步,AGI的发展叙事逐渐清晰:从处理单一 模态信息的单模态模型,到融合多种模态信息的多模态模型,再到以多模态模型为底模、能够自主规划和执行任务的Agent,发展到能与现实世界深度交互的具身智能、能探索前沿科学的 AI

根据行业报告,近年来 AIGC(AI Generated Content) 领域岗位数量井喷式增长,AI大模型产品经理作为连接技术与市场的桥梁,正扮演着越来越重要的角色。这一趋势的背后,是企业对AI技术应用的迫切需求和对专业人才的高度渴求。然而,市场需求的激增也带来了人才供给的紧张,尤其是既懂技术又懂市场的复合型人才更是难求。AI大模型产品经理是一个在人工智能领域中具有关键作用的职位,他们负责策划

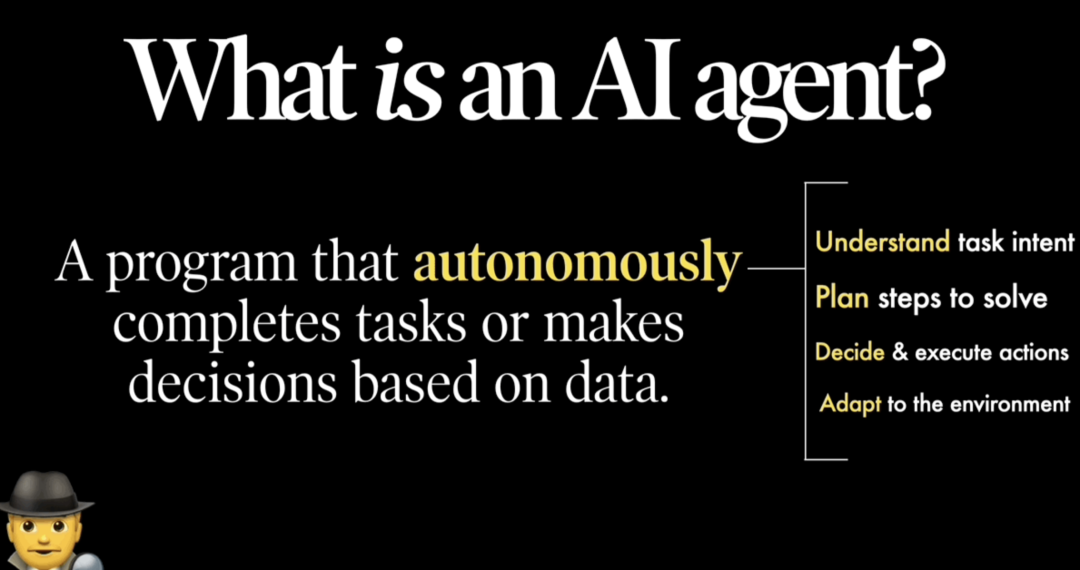

理解 AI Agent 的演变、架构和未来Agent(智能体)是一个能够基于数据自主完成任务或做出决策的程序。它与 AI模型对话,以使用工具和资源执行基于目标的操作。传统 AI 模型和 Agent 之间的区别是微妙但意义深远的。当我们与 AI 模型(例如 Gemini、o1、Sonnet 或类似的大型语言模型)交互时,本质上是在进行一系列一次性的互动:我们提供输入,模型处理输入,然后返回输出。虽然

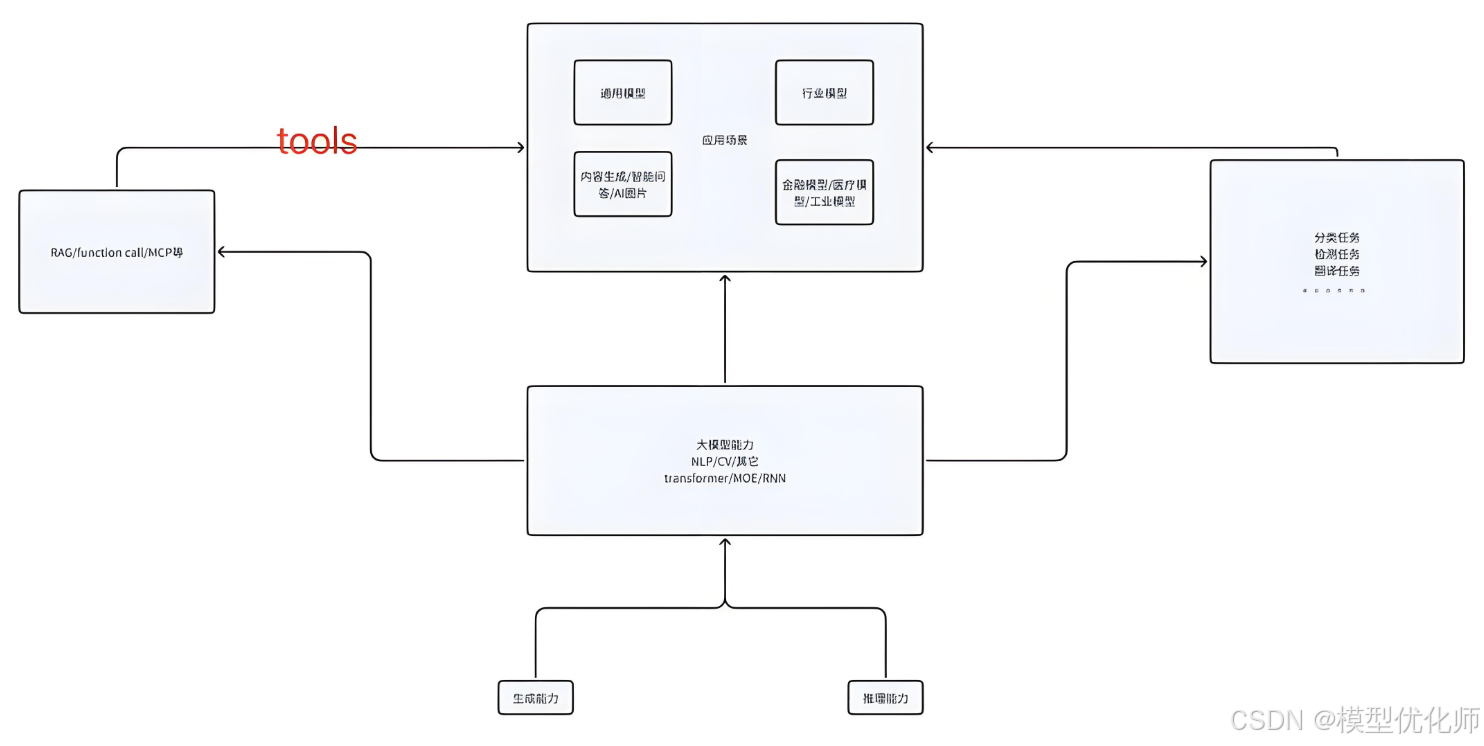

“大模型的应用是玩出来的而不是看出来的,多体验和尝试不同的模型之间的功能和区别才能让你真正了解大模型的能力。”在关于大模型应用方面,虽然也了解和应用过其中的一些技术;但经过这段时间的实践和思考发现,对大模型应用的认识还很浅显,因此在此记录一下自己的思考。

在人工智能发展的历史长河中,我们正经历着一场前所未有的技术革命。随着大语言模型(LLM)技术的飞速发展。AI Agent(智能体)作为一种能够自主感知、决策和行动的智能系统,正从概念走向实践,重塑着各行各业的工作方式和商业模式。

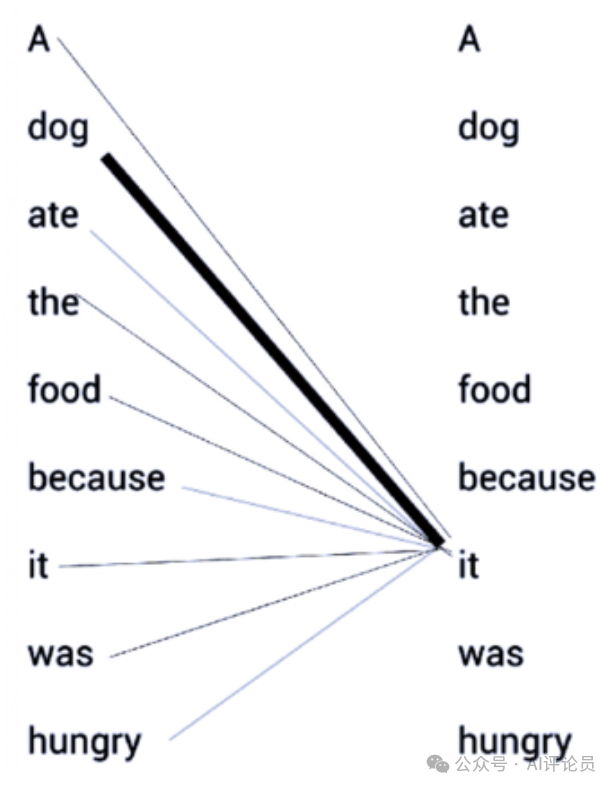

2017 年 Google 在论文《Attention Is All You Need》中提出 Transformer 模型架构,该架构是基于 Encoder-Decoder (编码器-解码器)的架构。作为当下最先进的深度学习架构之一,Transformer 被广泛应用于自然语言处理领域,它不仅替代了以前流行的循环神经网络(RNN)和长短期记忆网络(LSTM),而且后来的 BERT、GPT-3 等

在人工智能技术的浪潮中,AI大模型(Foundation Models)正以其卓越的数据处理能力和复杂的计算结构,在公路交通领域引发一场深刻的变革。这些模型不仅推动了社会生产力的提升,还在理解、学习、适应和实现任何知识工作的能力上展现出巨大潜力,即向通用人工智能(AGI)阶段的快速进化。

大模型在当今人工智能领域占据着核心地位,其强大的能力正不断推动各行业的变革与创新。无论是对人工智能充满好奇的初学者,还是希望在该领域深入发展的专业人士,掌握大模型相关知识和技能都至关重要。以下为你详细介绍 2025 年从零基础入门到精通大模型的学习路线。

大模型在当今人工智能领域占据着核心地位,其强大的能力正不断推动各行业的变革与创新。无论是对人工智能充满好奇的初学者,还是希望在该领域深入发展的专业人士,掌握大模型相关知识和技能都至关重要。以下为你详细介绍 2025 年从零基础入门到精通大模型的学习路线。

本文精选7个GitHub优质仓库,帮助开发者系统学习大模型与深度学习。从Karpathy的神经网络基础实现,到Hugging Face的Transformers应用,再到FastAI实战方法、MLOps落地、系统设计、深度学习理论课程和生成式AI前沿资源,覆盖从入门到进阶全路径。无论你是初学者还是想提升实战能力,这些资源都能帮你构建完整知识体系,2026年紧跟AI发展潮流。