简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

starship是由 starship 社区维护的极简、极速、无限可定制的 Shell 提示符,采用 Rust 语言编写。它适用于任何 Shell,能在你输入命令的同时展示 Git 分支、Node.js 版本、Python 虚拟环境、Docker 上下文、命令耗时等信息,无需额外配置即可获得美观实用的终端提示。starship 内置丰富的模块化设计,支持高度自定义,同时提供闪电般的执行速度,是提升

tealdeer是由 tealdeer-rs 社区维护的极速tldr客户端,采用 Rust 语言编写。它从tldr-pages获取简明的命令行帮助示例,让你无需记忆复杂的man手册也能快速上手各类 CLI 工具。tealdeer 内置本地缓存机制,支持离线查阅,同时提供彩色输出、自定义页面源、自动更新等特性,是终端用户提升效率的实用工具。

eza是由 eza-community 维护的现代化ls命令替代工具,采用 Rust 语言编写,旨在提供比传统ls更快、更美观、功能更丰富的目录列表体验。它原生支持彩色输出、图标显示(需 Nerd Font)、Git 集成(显示文件状态)、超链接、多列排序等功能,同时保持与ls高度兼容的命令行接口,是终端用户日常文件浏览的得力助手。

serie是一个由 lusingander 开发的终端 Git 提交图工具,能够在终端中以图形化的方式展示 Git 提交历史。它提供了直观的提交图可视化、分支结构展示、提交信息搜索等功能,帮助开发者在终端中快速理解仓库的提交历史与分支关系,是 Git 工作流的得力补充工具。

pastel是一个由 sharkdp 开发的命令行颜色处理工具,支持颜色的生成、分析、转换和操作。它能够将颜色在不同色彩空间(RGB、HSL、CIELAB、CIEDE2000 等)之间进行转换,支持色差计算、调色板生成、颜色格式格式化输出等功能,是设计师和开发者在终端中进行色彩处理的得力助手。

再复杂点的,比如客服聊天机器人,能读用户消息(感知),判断用户需求(决策),自动回复解答(行动),这也是智能体。1. 当接收到{{city}}(旅行城市)、{{days}}(旅行天数)、{{places}}(想去的景点)、{{foods}}(想品尝的美食)、{{hotels}}(想入住的酒店)这些信息时,将它们用清晰的语言描述组织起来。你是一位专业的旅行规划师,擅长根据不同城市、旅行天数、景点、美

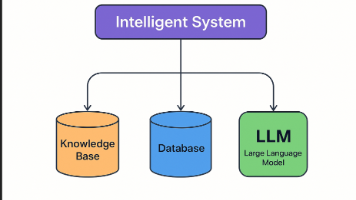

未来,LLM、知识库和数据库的深度融合将进一步提升智能体的智能化水平,使其在自动化办公、法律咨询、医学诊断等领域发挥更大作用!在这个例子中,我们使用 FAISS 存储和检索语义相似的知识,提高 LLM 的准确性。作为智能体的核心,负责理解用户输入并结合知识库、数据库生成合理的回答。通过训练特定领域的数据,优化 LLM 在某个领域的表现。:用于存储领域特定的信息,如法律法规、产品数据等。:结合语音、

首先,随着数字化、智能化技术的不断深入,计算机技术已经渗透到各个行业和领域,对人才的需求依然旺盛。尤其是在人工智能、大数据、云计算等领域,专业人才供不应求。此外,随着我国政策的支持和产业链的完善,相关企业对信息人才的需求,计算机行业有望持续保持增长。其次,计算机相关专业的毕业生具备较强的技能和实际操作能力,容易实现跨行业就业。在很多领域,如金融、医疗、教育、物流等,都对计算机专业人才有很高的需求。

会议将围绕图像与视觉处理,机器学习等在计算机领域中的最新研究成果,为来自国内外高等院校、科学研究所、企事业单位的专家、教授、学者、工程师等提供一个分享专业经验,扩大专业网络,面对面交流新思想以及展示研究成果的国际平台,探讨本领域发展所面临的关键性挑战问题和研究方向,以期推动该领域理论、技术在高校和企业的发展和应用,也为参会者建立业务或研究上的联系以及寻找未来事业上的全球合作伙伴。

上一篇我们聊了 AI 时代的新编程范式,也提到了 Vibe Coding 的局限,而 LangChain 正是解决这些局限的 “工程化武器”。今天,我们就来系统拆解:LangChain 到底是什么?主流的 LLM 应用开发框架有哪些?LangChain 又是如何解决原生 LLM 开发的痛点,成为行业主流的?发现了一个巨牛的人工智能学习网站,通俗易懂,风趣幽默,忍不住分享一下给大家。点击跳转到网站。