简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

昇腾是华为推出的面向人工智能计算的全栈解决方案,包含芯片、软件及生态体系;其中,昇腾芯片是专为深度学习设计的专用处理器(NPU,Neural Processing Unit),基于华为自研的达芬奇(DaVinci)架构,具备高并行、高吞吐、低功耗等优势,旨在为深度学习训练和推理提供高性能、高能效的算力支持,广泛应用于数据中心、边缘计算和终端设备等多种场景。

昇腾是华为推出的面向人工智能计算的全栈解决方案,包含芯片、软件及生态体系;其中,昇腾芯片是专为深度学习设计的专用处理器(NPU,Neural Processing Unit),基于华为自研的达芬奇(DaVinci)架构,具备高并行、高吞吐、低功耗等优势,旨在为深度学习训练和推理提供高性能、高能效的算力支持,广泛应用于数据中心、边缘计算和终端设备等多种场景。

昇腾是华为推出的面向人工智能计算的全栈解决方案,包含芯片、软件及生态体系;其中,昇腾芯片是专为深度学习设计的专用处理器(NPU,Neural Processing Unit),基于华为自研的达芬奇(DaVinci)架构,具备高并行、高吞吐、低功耗等优势,旨在为深度学习训练和推理提供高性能、高能效的算力支持,广泛应用于数据中心、边缘计算和终端设备等多种场景。

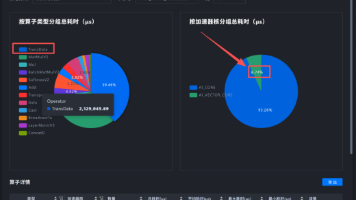

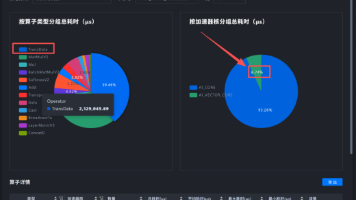

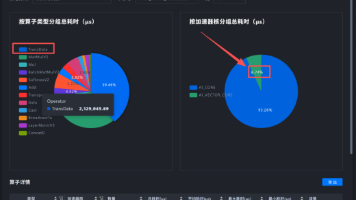

在人工智能芯片的广阔领域中,硬件的强大算力需要一套同样强大的软件工具来充分挖掘和利用。正是 CANN 软件栈中扮演这一核心角色的低层级开发工具包。它不仅仅是一个简单的库集合,而是直接暴露了 AI 处理器硬件底层能力的接口层,为上层的 CANN Runtime、Compiler、Catlass 等组件提供了与 AI 处理器进行高效交互的基石。asc-devkit 封装了对 AI 处理器设备的管理、内

在过去的一年里,大模型(LLM)颠覆了我们撸代码和写文案的方式。但在惊叹之余,开发者们往往面临着一个尴尬的落地痛点:无论后端的模型推理多快、多智能,一到前端交互,AI 就只能干巴巴地一行行吐字。它们有超凡的“脑力”,却连一个点头、一个眼神的交互都做不到。

MongoDB 作为分布式架构的 NoSQL 数据库,核心优势在于支持 JSON 格式的灵活数据存储,能轻松处理嵌套对象、数组这类复杂数据类型,还可通过各类索引提升检索效率,既适配开发者搭建灵活数据模型的 Web 应用,也能满足数据分析团队处理日志、实时监控等非结构化数据的需求,学生学习 NoSQL 时也能快速上手。它的实用性体现在实际场景中,比如电商场景里存储商品信息,可通过复合索引快速筛选出指

Docker Compose UI 的主要作用是把 Docker Compose 的命令行操作变成可视化界面,通过点击、拖拽就能管理容器的启动、停止,查看实时日志,调整配置。它特别适合刚接触 Docker 的新手 —— 不用死记硬背docker-compose up这类命令,也适合团队协作场景,大家能直观看到服务依赖关系。优点很明显:操作门槛低,状态一目了然,改配置比直接改 YAML 文件快得多,

Pansou 作为一款网盘资源搜索工具,核心功能是整合多平台网盘资源与 Telegram 频道内容,能识别并分类百度网盘、阿里云盘等十余种存储类型的资源,还通过智能排序让匹配度高、更新新的资源优先展示,适合追剧爱好者、职场办公人群、学习资料搜集者等需要高效找资源的人群,其轻量化(不到 20 兆)、Docker 快速部署、缓存加速的特点,大幅降低了资源搜索的时间成本。

Pansou 作为一款网盘资源搜索工具,核心功能是整合多平台网盘资源与 Telegram 频道内容,能识别并分类百度网盘、阿里云盘等十余种存储类型的资源,还通过智能排序让匹配度高、更新新的资源优先展示,适合追剧爱好者、职场办公人群、学习资料搜集者等需要高效找资源的人群,其轻量化(不到 20 兆)、Docker 快速部署、缓存加速的特点,大幅降低了资源搜索的时间成本。

极空间作为家用 NAS 设备,核心功能围绕存储、备份展开,能满足家庭用户的基础数据存放需求,1Panel 则是轻量级的服务器管理面板,通过图形化界面简化 Linux 服务器运维,无需复杂命令行就能部署各类应用,二者适配人群主要是普通家庭用户、小型办公团队,优点在于操作门槛低,极空间无需额外装系统,1Panel 还能自动签发 SSL 证书、管理 Docker 应用,兼顾实用性与安全性。