简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

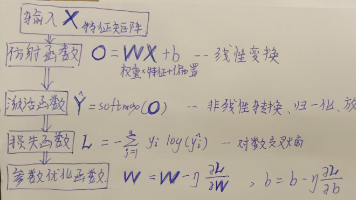

一次弄懂仿射、激活、损失、优化函数是什么,如何关联组成分类神经网络的。同时构建最大似然=交叉熵+Softmax的思想。

深度学习为什么要这么做,而不只教你如何做!从零开始的保姆级教程,小学生毕业也包教会!

瞎几把介绍了操作系统中进程间通信(IPC)的核心机制,包括管道、消息队列、共享内存和信号量。函数名简写你妈啊 参数那么多我考场写个der 这难崩的编程题我直接弃考好吧

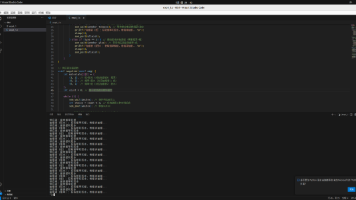

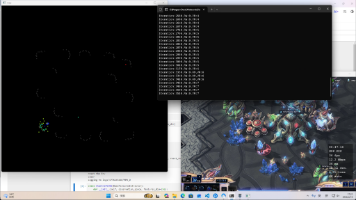

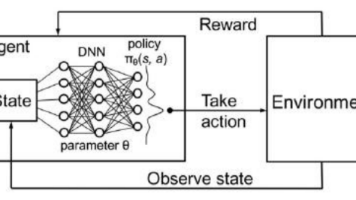

教你用强化学习PPO练一个能自己学习玩星际争霸的模型。前置课程需完成【强化学习实战1-7】

教你用强化学习PPO练一个能自己学习玩星际争霸的模型。前置课程需完成【强化学习实战1-7】

教你用强化学习PPO练一个能自己学习玩星际争霸的模型。前置课程需完成【强化学习实战1-7】

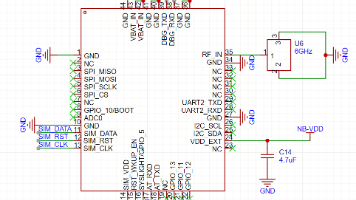

QS-100是一款基于芯翼XY1100的工业级NB-IoT无线通信模组,具有低功耗、多频段等特点,兼容R13/R14协议并支持R15升级。该模组内置多种通信协议栈,适配国内三大运营商物联网平台,采用44pin LGA封装(15.8×17.7×2.2mm)。硬件设计方面需注意:电源采用3.3V供电,串口需电平转换(仅支持3V),SIM卡电路需严格布线并添加去耦电容(33pF+100nF组合)以稳定供

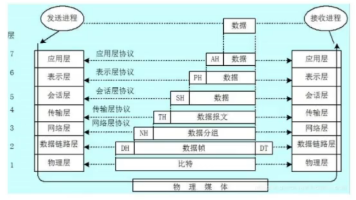

本文摘要: 本文系统梳理了计算机网络核心知识点,涵盖从物理层到应用层的关键概念。主要内容包括:网络基础架构(边缘与核心网络)、分组交换与电路交换原理、TCP/UDP协议对比、可靠数据传输机制(GBN/SR协议)、路由算法(OSPF/BGP)、HTTP协议流程及Cookie机制、DNS解析过程等。特别详细分析了TCP连接管理(三次握手/四次挥手)、拥塞控制算法(AIMD、慢启动、快速恢复)以及SDN

VLN视觉语言导航4草稿

深度学习模型是如何更新参数的?什么是梯度累计?为什么要累计梯度?解析解和数值解是什么?这些抽象的概念在此为您奉上较为详尽的解释。