从零开始学MCP(1)| MCP 协议核心原理解析,大模型入门到精通,收藏这篇就足够了!

MCP 不是简单的 RPC 协议,而是为 AI Agent 设计的 “工具协作语言”。其通过上下文传递、流式响应、动态注册等机制,为构建复杂智能应用提供了基础设施。

统一 AI 工具调用的“通信语言”

关键词:工具调用标准化、Client/Server 架构、上下文传递、SSE 流式响应

一、MCP 解决了什么痛点?

在 MCP 出现之前,AI 应用调用外部工具(如数据库、API)存在三大问题:

- 碎片化:每个模型需单独适配工具(如 OpenAI Function Calling vs Claude Tool Use)

- 高耦合:工具逻辑与模型代码深度绑定,难以复用

- 上下文丢失:多轮调用时状态管理复杂

MCP 的核心目标:

定义一套与模型无关的标准化协议,让任意 AI 模型通过统一接口调用任意工具。

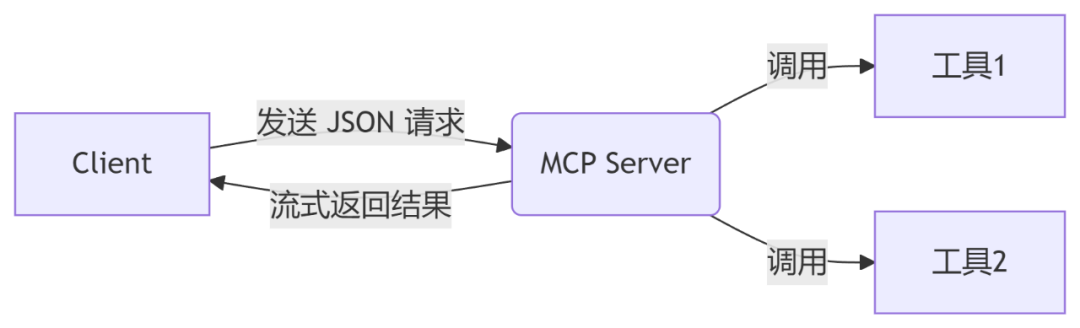

二、协议架构:Client/Server 解耦设计

核心角色定义

| 组件 | 职责 | 示例实体 |

|---|---|---|

| Client | 发起工具调用请求 | Claude/ChatGPT/Cursor |

| Server | 路由请求到工具并返回结果 | 本地 FastMCP 服务 |

| Tool | 执行具体操作 | 天气查询/数据库连接器 |

三、协议通信流程拆解

步骤 1:Client 发起请求(Request)

Client 发送 结构化 JSON 到 MCP Server,包含:

- **

context**:历史对话/当前状态(协议核心!) - **

tool_name**:目标工具标识符 - **

parameters**:工具调用参数

{

"context": {

"user_id": "u123",

"session_id": "s456",

"history": [{"role": "user", "content": "查询北京天气"}]

},

"tool_name": "get_weather",

"parameters": {"city": "北京", "unit": "celsius"}

}

步骤 2:Server 调用工具(Execution)

Server 根据 tool_name 路由到注册的工具函数,注入上下文并执行:

# MCP 工具注册示例(Python)

@mcp_tool(name="get_weather")

defweather_api(city: str, unit: str, context: dict) -> dict:

# 可访问 context["user_id"] 做权限校验

return fetch_weather(city, unit) # 调用真实 API

步骤 3:流式返回结果(Response)

通过 Server-Sent Events(SSE) 流式返回,支持大结果分块传输:

HTTP/1.1 200 OK

Content-Type: text/event-stream

event: result_chunk

data: {"progress": 30, "text": "正在获取数据..."}

event: final_result

data: {"temp": 25, "humidity": 60}

四、关键技术特性解析

1. 上下文传递(Context Propagation)

核心价值:在多轮交互中保持状态连续性

- 客户端在每次请求中携带完整上下文(如用户 ID、对话历史)

- 服务端可在响应中修改上下文(实现状态机)

// Server 可返回新上下文

{"result": "...", "updated_context": {"selected_city": "北京"}}

2. 工具动态发现(Tool Discovery)

Client 启动时通过 /registry 接口拉取 Server 的工具清单:

// GET http://mcp-server/registry

{

"tools": [

{

"name": "get_weather",

"description": "查询城市天气",

"parameters": {

"city": {"type": "string", "required": true},

"unit": {"type": "string", "enum": ["celsius", "fahrenheit"]}

}

}

]

}

3. 安全控制(OAuth2 集成)

在工具执行前进行权限校验:

defweather_api(city: str, context: dict):

user_token = context.get("user_token")

ifnot validate_token(user_token, scope="weather:read"):

raise MCPError(code=403, message="无权访问天气服务")

五、对比传统方案:为什么选择 MCP?

| 能力 | MCP 方案 | 传统 Function Calling |

|---|---|---|

| 跨模型兼容 | ✅ 统一接口 | ❌ 每个模型需独立适配 |

| 工具热插拔 | ✅ 服务端动态注册 | ❌ 需重新部署模型 |

| 上下文管理 | ✅ 显式状态传递 | ❌ 依赖模型记忆,不可靠 |

| 调试支持 | ✅ 内置 Trace Viewer | ❌ 自行搭建日志系统 |

六、实战:快速验证 MCP 流程

1. 启动 Mock 服务

pip install fast-mcp

fast-mcp --tools demo_tools.py

2. 发起请求(cURL 示例)

curl -X POST http://localhost:8000/execute \

-H "Content-Type: application/json" \

-d '{

"tool_name": "get_weather",

"parameters": {"city": "上海"},

"context": {"user_id": "test"}

}'

3. 观察响应

{

"result": {"temp": 28, "condition": "sunny"},

"updated_context": {"last_city": "上海"}

}

七、协议演进方向(2025+)

- 多模态扩展:支持图像/音频作为工具输入输出

- 智能体协作:MCP Server 可嵌套调用其他 MCP Server

- 边缘计算:轻量化客户端运行在 IoT 设备

结语:MCP 不是简单的 RPC 协议,而是为 AI Agent 设计的 “工具协作语言”。其通过上下文传递、流式响应、动态注册等机制,为构建复杂智能应用提供了基础设施。

大模型算是目前当之无愧最火的一个方向了,算是新时代的风口!有小伙伴觉得,作为新领域、新方向人才需求必然相当大,与之相应的人才缺乏、人才竞争自然也会更少,那转行去做大模型是不是一个更好的选择呢?是不是更好就业呢?是不是就暂时能抵抗35岁中年危机呢?

答案当然是这样,大模型必然是新风口!

那如何学习大模型 ?

由于新岗位的生产效率,要优于被取代岗位的生产效率,所以实际上整个社会的生产效率是提升的。但是具体到个人,只能说是:

最先掌握AI的人,将会比较晚掌握AI的人有竞争优势。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

但现在很多想入行大模型的人苦于现在网上的大模型老课程老教材,学也不是不学也不是,基于此我用做产品的心态来打磨这份大模型教程,深挖痛点并持续修改了近100余次后,终于把整个AI大模型的学习路线完善出来!

在这个版本当中:

您只需要听我讲,跟着我做即可,为了让学习的道路变得更简单,这份大模型路线+学习教程已经给大家整理并打包分享出来, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

一、大模型经典书籍(免费分享)

AI大模型已经成为了当今科技领域的一大热点,那以下这些大模型书籍就是非常不错的学习资源。

二、640套大模型报告(免费分享)

这套包含640份报告的合集,涵盖了大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(几乎涵盖所有行业)

三、大模型系列视频教程(免费分享)

四、2025最新大模型学习路线(免费分享)

我们把学习路线分成L1到L4四个阶段,一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

全套的AI大模型学习资源已经整理打包,有需要的小伙伴可以微信扫描下方二维码,免费领取

为武汉地区的开发者提供学习、交流和合作的平台。社区聚集了众多技术爱好者和专业人士,涵盖了多个领域,包括人工智能、大数据、云计算、区块链等。社区定期举办技术分享、培训和活动,为开发者提供更多的学习和交流机会。

更多推荐

已为社区贡献18条内容

已为社区贡献18条内容

所有评论(0)