简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

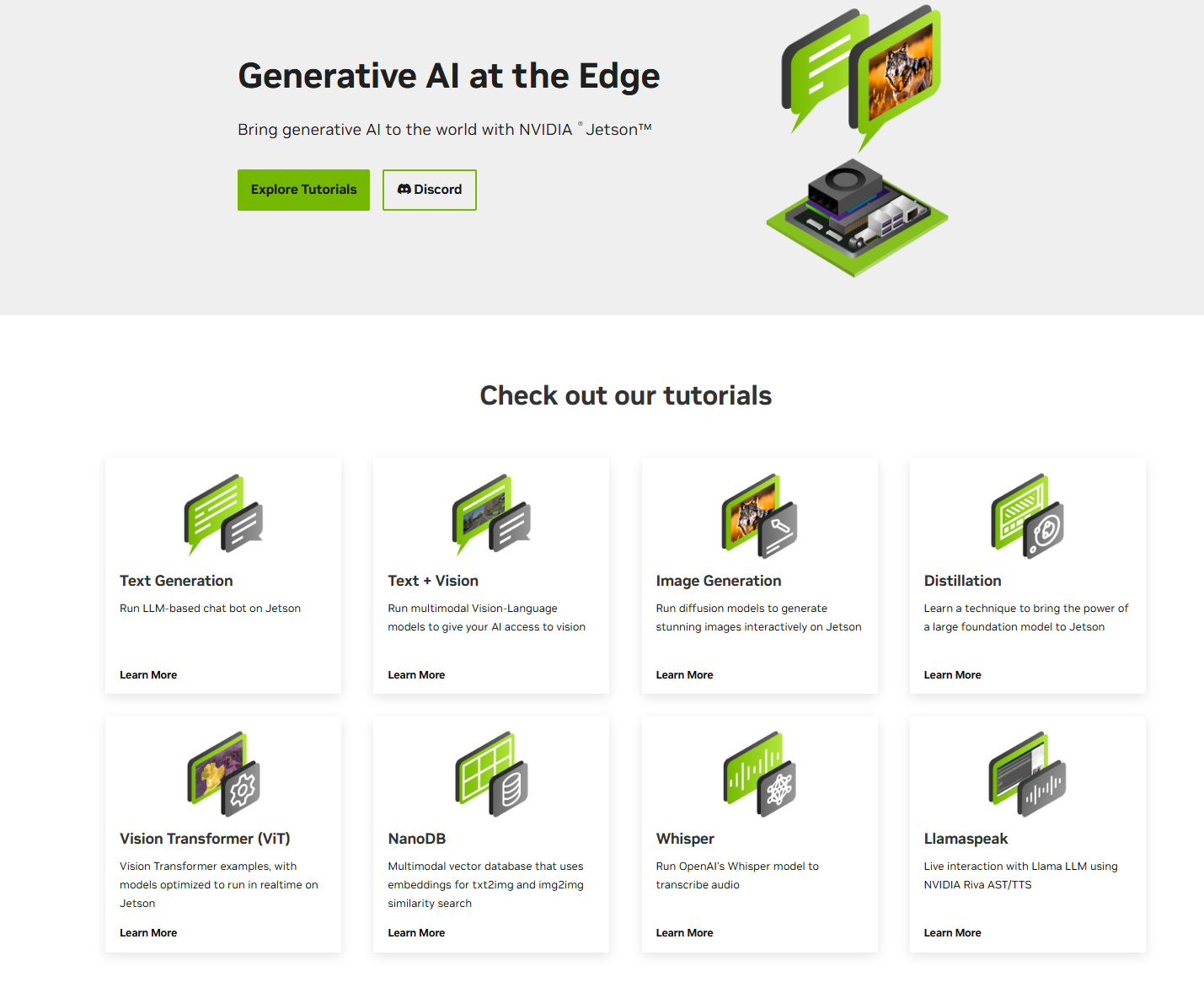

Nvidia Jetson Orin 适配大模型参考用例

在英伟达官网针对Jetson提供很多现有适配大模型方法,想学习的进入网站链接有参考适配步骤。

Nvidia Jetson Orin 适配大模型参考用例

在英伟达官网针对Jetson提供很多现有适配大模型方法,想学习的进入网站链接有参考适配步骤。

到底了

该用户还未填写简介

暂无可提供的服务

在英伟达官网针对Jetson提供很多现有适配大模型方法,想学习的进入网站链接有参考适配步骤。

在英伟达官网针对Jetson提供很多现有适配大模型方法,想学习的进入网站链接有参考适配步骤。