简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

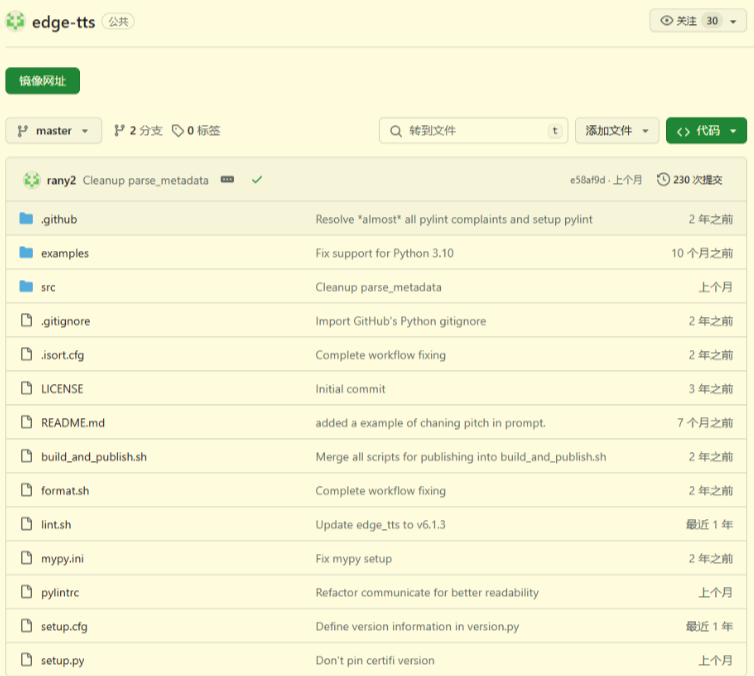

在本文中,我们将构建一个简单的系统,该系统能够接收文本输入,通过 Microsoft Edge 的文本到语音服务(Edge TTS)转换为语音,并将生成的语音数据以 Base64 编码的形式通过 WebSocket 传输给 Vue 客户端。我们将创建一个简单的 WebSocket 服务器,它将接收文本消息,使用 Edge TTS 转换为语音,并将结果以 Base64 编码的形式发送回客户端。在浏览

摘要: Qwen3-V2与Gemini 4o代表多模态领域的两种技术路线:前者专注高精度视觉解构(动态切片技术、GUI优化),擅长细节识别与坐标定位,适合自动化操作;后者作为全能实时枢纽,原生融合文本/音频/视频,强调整体语义与跨模态同步。实际应用中,Gemini 4o可作任务规划“大脑”,Qwen3-V2则充当“眼睛”与“手”,完成精准界面审计与操作。二者协同可构建高效多模态系统。

摘要: Qwen3-V2通过像素级视觉定位和思维链逻辑审计,为Harness测试框架提供了精准的多模态反馈能力。它能直接输出标准化坐标(Bounding Box),并推理UI元素状态,驱动自动化操作(如问卷填写)。这种视觉断言+自动化指挥的闭环,摆脱了对DOM的依赖,实现动态适应与零代码维护,标志着GUI Agent的未来方向——通过多模态对抗架构(如Gemini Pro生成+Qwen3-V2审计

AI智能体的进化之路:从工具到自主学习的数字员工 2026年AI应用正从简单对话转向具备自我进化能力的智能体(Agent)。本文剖析了实现AI自主进化的两大核心:持久化记忆和循环学习机制。智能体架构包含五大模块:感知层(LLM大脑)、技能库(肌肉记忆)、长短期记忆系统(知识储备)和自我反思算子(错误修正)。技术选型上,LangGraph因其循环状态机特性超越传统线性架构,形成"失败→修正

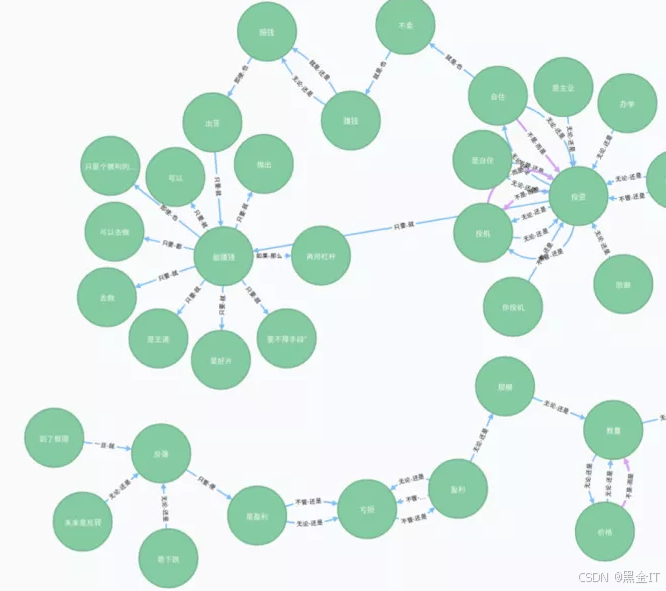

三元组抽取的方法有很多,包括基于规则的方法、基于模板的方法、监督学习方法(如条件随机场CRF、支持向量机SVM、深度学习方法等)。随着深度学习技术的发展,使用神经网络进行三元组抽取的方法越来越流行,如使用双向长短时记忆网络(Bi-LSTM)、卷积神经网络(CNN)或Transformer架构等。

通过上述步骤,我们成功地使用D3.js重新渲染了PlantUML生成的数据,并为其添加了实用的交互效果。这一过程不仅展示了D3.js在数据可视化方面的强大能力,也体现了PlantUML作为数据来源的便捷性。在未来的前端开发中,我们可以进一步拓展这种技术组合的应用场景。例如,在大型软件项目的架构展示中,通过实时更新PlantUML数据,并利用D3.js的动态渲染和交互功能,让开发团队能够更加直观地理

由于不小心开启了github双重身证验证,每次重新登录都验证身证很是麻烦。这边记录一下如何应对处理。并且开启后在国内解除非常的麻烦。按照网上的教程,扫码解除不成功。想换成手机来验证,结果找不到+86地区。要知道没有+86,我就不会用它了。不要被手机APP截图的已被锁定吓到了,是手机运行Authenticator后,它不让截屏。github双重身证验证与手机端app的Authenticator配合使

Pocketbase 是一个开源的实时后端服务器,内置了数据库、实时订阅、用户认证、RESTful API 等功能,而 MySQL 是一个广泛使用的关系数据库管理系统。

先从免费的网页版 Claude 用起,当你感觉到处理琐事力不从心时,花半小时部署好 Claude Code,再配合 Gemini Flash 做视觉输出。这套组合拳打通后,你一个人就是一个高效的内容生产团队。

本文揭示了AI视频生成领域"套壳"架构的核心技术,通过构建精密操作层将随机生成转变为可控工程。文章详细拆解了五大核心技术:语义扩容、视觉一致性约束、工作流节点化、自动审美评估和空间运动控制,并推荐ComfyUI作为最佳后端引擎。同时提供实战指南,包括API集成、服务器配置建议及成本分析,为开发者构建稳定高效的AI视频生产系统提供完整解决方案。这套方法能将"抽卡式&qu