简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

协方差(Covariance)和协方差矩阵(Covariance Matrix)是统计学与机器学习中**最基础、最核心的工具**之一。它们不仅揭示了变量间的隐藏关系,更是主成分分析(PCA)、投资组合优化、多元回归等高级技术的数学基石。本文将通过**零基础可懂的直观解释、手写公式推导、Python代码实战和工业级应用案例**,带你彻底吃透协方差与协方差矩阵。

用 pytorch 从零开始创建大语言模型(一):理解大型语言模型

本文提出RoboSplat方法,利用3D高斯溅射技术生成多样化的视觉运动示范数据,显著提升单次示范策略的泛化能力。通过直接操作3D高斯模型实现物体替换、姿态变换、光照编辑等5种增强技术,在六类场景中生成逼真示范。实验表明,该方法将平均成功率从传统二维增强的57.2%提升至87.8%。文章详细介绍了3D高斯变换方法、策略架构(结合ResNet-18和Transformer)及训练细节,并在真实环境中

在点云处理与图神经网络中,**Farthest Point Sampling (FPS)** 是一种常见且重要的下采样方法。它能够从大量的原始点云中,挑选出互相间距离最远的一批代表点,从而在保留全局几何结构的同时,大幅减少后续计算量。`torch_cluster` 库中提供了一个高效的 GPU 实现 `fps`,在代码中我们通常这样导入:

在深度学习中,有时需要创建一个所有元素都相同的张量,例如作为常数初始值或掩码。PyTorch 提供了 `torch.full` 接口,功能灵活且参数丰富。下面我们按模块逐一展开。

在深度学习中,我们经常需要从标准正态分布($\mathcal{N}(0,1)$)中采样,PyTorch 提供了非常灵活的接口 `torch.randn`。本文将从接口定义、参数详解、常见场景、示例及输出,到关键字参数的设计原理,一一展开。

在深度学习与科学计算中,我们经常需要在某个区间内生成等间隔的数值序列,比如采样时间轴、插值混合、位置编码、网格采样等场景。PyTorch 为此提供了一个高效便捷的函数——`torch.linspace`。本文将从函数签名、基本用法,到进阶参数和实战案例,详细讲解 `torch.linspace` 的原理与使用技巧,帮助你在项目中灵活运用。

在深度学习与科学计算中,往往需要沿某个维度追踪“前面所有元素的乘积”,比如几何序列计算、概率分布构建、模型门控/权重衰减等场景。PyTorch 提供的 `torch.cumprod` 函数可以一行代码搞定这一需求。本文将从函数签名、参数含义、基础用法,到进阶示例、典型应用场景,为你带来最全面的讲解,并附上丰富示例助你快速上手。

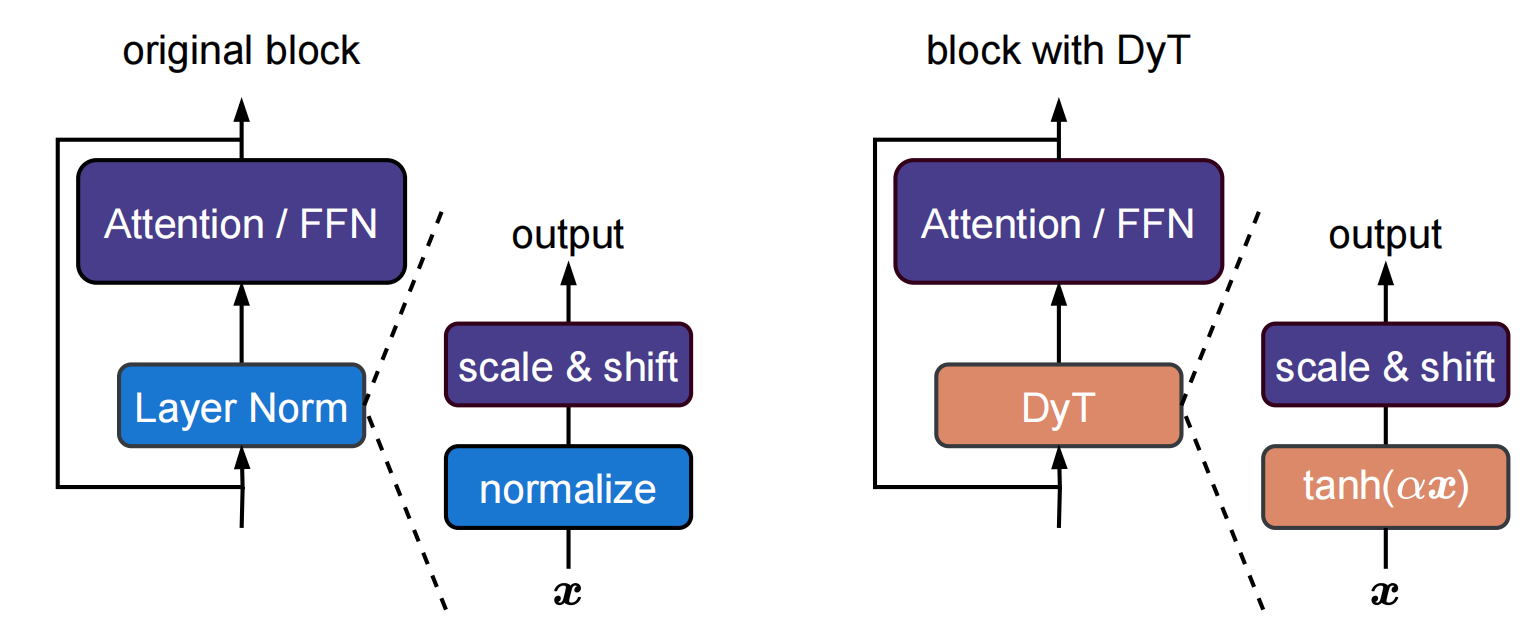

归一化层在现代神经网络中无处不在,并且长期以来被认为是必不可少的。本工作表明,通过一种非常简单的技术,不使用归一化的Transformer也能达到相同或更好的性能。我们提出了动态Tanh (Dynamic Tanh——DyT),一种逐元素操作$\text{DyT}(x)=\tanh(\alpha x)$,可作为Transformer中归一化层的直接替代。$\text{DyT}$的灵感来源于观察到T

在PyTorch的深度学习模型开发中,`nn.Identity()`是一个看似简单但功能强大的工具。它虽然不进行任何数学运算,但在实际开发中却能解决许多复杂问题。本文将深入解析`nn.Identity()`的作用、应用场景以及实际代码示例,帮助开发者更好地利用这一“隐形利器”。