简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

直接让 AI 回答问题(Zero-shot)往往效果不稳定,但微调模型又成本高昂、周期漫长。有没有折中方案?Few-Shot Learning(少样本学习)通过在 Prompt 中提供少量示例,就能显著提升模型准确率和一致性。本文将深入讲解 LangChain4j 的 Few-shot 实现技巧,从基础的示例拼接、到动态示例检索、再到 Token 优化策略。你将学会如何构建高质量的示例库,如何在客

Omnilingual ASR是由Meta AI 团队开发的一种创新的自动语音识别系统。它通过一个通用的转录模型,能够将超过1600种语言的口语转换为书面文本。该系统基于强大的自监督学习架构和大规模多语言数据集构建,能够在仅有少量标注数据的情况下实现对多种语言的高效识别。

Bee是由腾讯混元团队与清华大学联合推出的全栈开源多模态大模型解决方案,旨在通过提升数据质量来缩小开源模型与闭源模型之间的性能差距。该项目包含三大核心成果:首先是1500万规模的高质量双层CoT数据集Honey-Data-15M,它经过多步清洗和双层思维链扩充,覆盖多模态理解与生成任务,显著提升了数据的准确性和推理深度;其次是开源的数据增强工具HoneyPipe及DataStudio,为开发者提供

GLM-ASR是由智谱AI开发的开源语音识别模型系列,包括云端的GLM-ASR-2512和开源的GLM-ASR-Nano-2512。该系列模型基于深度学习架构,针对语音识别任务进行优化,不仅在理想环境下表现出色,更注重在复杂声学环境下的鲁棒性。GLM-ASR-Nano-2512采用1.5B参数,通过特定的训练策略,覆盖多噪声、多口音、低音量以及中文方言等复杂语音样本,使其在实际应用中表现出色。

GLM-TTS 是智谱 AI 开发的零样本语音合成系统,基于大型语言模型,支持零样本语音克隆和流式推理。该系统采用两阶段架构,结合 LLM 生成语音 Token 和 Flow Matching 模型合成波形。通过引入多奖励强化学习框架,GLM-TTS 在情感表达和语音自然度上显著优于传统 TTS 系统。

MedASR 是一款基于 Conformer 架构的医疗语音识别模型,拥有 105M 参数,经过约 5000 小时的医学语音数据预训练,涵盖放射学、内科、全科等多种医学专业领域的语音内容。它能够精准识别复杂医学术语和专业上下文,为开发者提供可定制化的基础模型,适用于医学口述转录、临床对话记录、多模态医疗应用开发等多种场景。

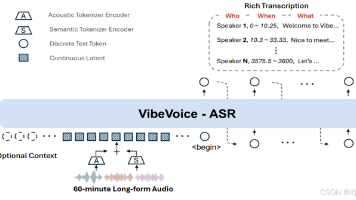

**VibeVoice-ASR是微软开源的90亿参数统一语音识别模型**,基于Qwen2 Decoder架构,采用64K token超长上下文窗口与7.5 Hz超低帧率语音分词技术,实现了ASR(自动语音识别)、说话人分离(Diarization)和时间戳标注(Timestamping)三大任务的端到端联合建模。该模型支持中英双语,可单次处理长达60分钟的连续音频,输出"Who-When-What

单用户对话系统很简单,但企业级应用需要支持成千上万用户同时交互,每个用户的对话历史必须严格隔离、重启不丢失。如何实现多用户记忆管理?如何选择合适的持久化方案?本文将深入讲解 LangChain4j 的 `@MemoryId` 注解实现用户隔离、`ChatMemoryProvider` 动态创建记忆实例、以及从内存到 MySQL/Redis 的多种持久化方案。你将学会构建支持高并发的多用户对话系统,

大模型擅长生成自然语言,但程序需要的是结构化数据。如何让 AI 返回 JSON、Java 对象而非自由文本?LangChain4j 提供了强大的结构化输出能力,能自动将非结构化文本解析为枚举、数值、日期、POJO 等 Java 类型。本文将深入讲解 `@Description` 注解的字段级语义说明、JSON Mode 的强制结构化输出、以及复杂嵌套对象的提取技巧。你将学会如何从简历中提取人员信息

传统的 AI 调用需要手动拼接 Prompt、发送 HTTP 请求、解析 JSON 响应,代码冗长且难以维护。LangChain4j 提供了革命性的声明式编程模型——AI Service,通过定义 Java 接口即可自动获得 AI 能力,无需手写实现类。本文将深入讲解 `AiServices.create()` 的动态代理原理,`@SystemMessage`、`@UserMessage`、`@V