简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

检索增强生成(RAG)通过从外部知识源检索相关信息,让大语言模型(LLM)能够对私有或未见过的文档集进行问答。但 RAG 无法回答面向整个文本语料的全局问题(如 “数据集中的核心主题是什么?”),因为这类问题本质属于 ** 查询聚焦摘要(QFS)** 任务,而非显式检索任务。而现有的 QFS 方法又无法扩展到常规 RAG 系统所索引的大规模文本量。为融合两种方法的优势,本文提出GraphRAG:一

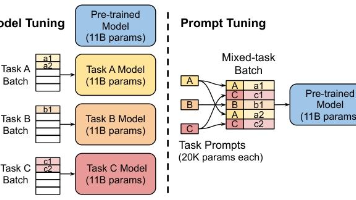

(论文:BitFit: Simple Parameter-efficient Fine-tuning or Transformer-based Masked Language-models)是一种稀疏的微调方法,它训练时只更新bias的参数或者部分bias参数。对于Transformer模型而言,冻结大部分 transformer-encoder 参数,只更新bias参数跟特定任务的分类层参数。

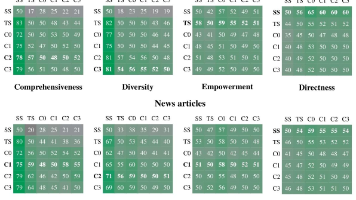

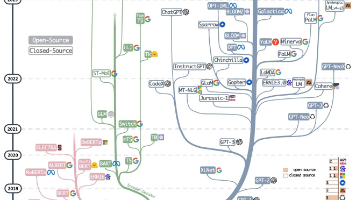

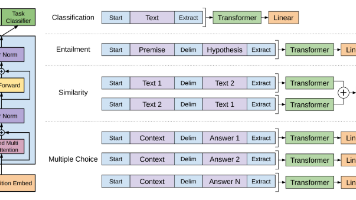

本文为在下游自然语言处理(NLP)任务中使用大语言模型(LLMs)的从业者与终端用户,提供了一份全面且实用的指南。我们将从模型、数据和下游任务三个维度,探讨 LLMs 的使用方法并分享相关见解。首先,我们将对当前主流的 GPT 类与 BERT 类大语言模型进行介绍和简要概述;其次,分析预训练数据、训练(微调)数据及测试数据对 LLMs 的影响;

(论文:BitFit: Simple Parameter-efficient Fine-tuning or Transformer-based Masked Language-models)是一种稀疏的微调方法,它训练时只更新bias的参数或者部分bias参数。对于Transformer模型而言,冻结大部分 transformer-encoder 参数,只更新bias参数跟特定任务的分类层参数。

作者使用最近提出的ELI5数据集来测试模型生成长自由格式答案的能力。我们发现BART比以前最好的工作高出1.2 ROUGE-L,但数据集仍然具有挑战性,因为答案仅由问题弱指定。

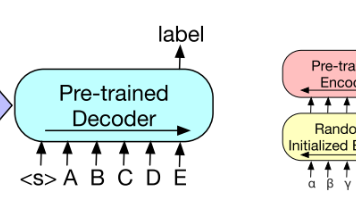

自然语言理解包括文本蕴涵、问题回答、语义相似度评估和文档分类等广泛的任务。尽管大量未标记的文本语料库丰富,但用于学习这些特定任务的标记数据很少,这使得判别训练模型难以充分执行。我们证明,通过在不同的未标记文本语料库上对语言模型进行生成式预训练,然后对每个特定任务进行判别性微调,可以实现这些任务的巨大收益。与以前的方法相反,我们在微调期间利用任务感知输入转换来实现有效的传输,同时需要对模型体系结构进

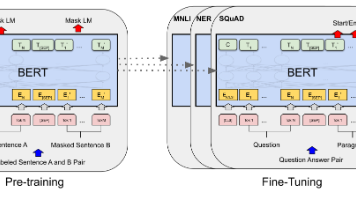

我们引入了一种新的语言表示模型BERT,它代表来自transformer的双向编码器表示。与最近的语言表示模型(Peters et al., 2018a;Radford et al., 2018)不同,BERT旨在通过在所有层中对左右上下文进行联合条件反射,从未标记的文本中预训练深度双向表示。因此,预训练的BERT模型可以通过一个额外的输出层进行微调,从而为广泛的任务(如问答和语言推理)创建最先进