简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

用户可以在页面配置公众号授权API、分类下载路径、Ollama服务、分类规则等,系统会调用Ollama服务配置的本地大模型,对选择的公众号的历史文章按照分类规则执行下载和分类任务,同时记录文章的标题、url链接等信息。

在这个连街边大爷都在聊 DeepSeek 的时代,你肯定听过 Transformer 这个词。它是现代大语言模型的心脏,是目前人类创造出来的最接近“赛博魔法”的架构。但如果你去翻论文,迎面而来的就是各种极其反人类的矩阵公式。其实,剥开数学的外衣,它的底层逻辑不仅极其优雅,而且充满了人类社会的常识。今天咱们就搬个小板凳,从最底层的深度学习知识出发,一路推演到那些千亿参数的大模型到底是怎么运转的。

本文介绍了如何通过LoRA微调技术对Qwen2.5_0.5B模型进行本地微调,并实现AI面试中的行为归纳任务。文章首先分析了当前AIGC技术在上下文长度和生成一致性方面的限制,随后详细描述了从模型下载、数据预处理到微调和本地部署的完整流程。通过使用PEFT工具和llama.cpp项目,成功将微调后的模型转换为gguf格式,并在本地环境中进行部署。最后,文章还提供了批量推理的脚本示例,展示了如何在实

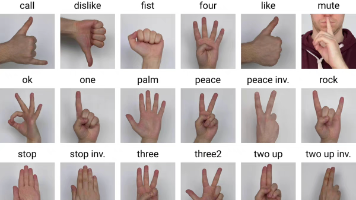

本系列文章旨在记录基于YOLOv8和Medipipe的手势识别系统的搭建过程,分为数据预处理、服务器训练、引入Mediapipe优化计算量及前端页面搭建四个部分。本文将重点介绍对开源HaGRID静态手势数据集的精简处理与数据增强。该数据集涵盖18类手势,原始数据集716GB。为适配YOLOv8训练并降低训练成本,本文抽取每类750张图片,构成13,500张的1.08GB精简数据集。随后,使用alb