简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

代码地址:github.com/deepspeedai/DeepSpeed不是只追求新增功能,而是同时关注性能、稳定性、兼容性和工程质量。这次更新中,既有面向分布式训练效率的优化,也有防止崩溃、泄漏和挂起的修复;既有对新版本 PyTorch 的适配,也有对 Attention、MoE、ZeRO-3、CPU offload 等关键路径的增强。对于实际生产环境而言,这样的版本升级往往比“单纯加功能”更

解决语言自动检测问题减少临时测试补丁让依赖链更干净代码地址:github.com/agno-agi/agnoAgno v2.6.9 表面上是一个常规小版本,实际上修复和优化的内容都非常贴近真实使用场景。审批可观测性增强PgVector 前缀搜索修复Claude 0 参数生效Gemini agent 工具调用修复指令层清理Python 3.12 兼容优化依赖升级带来的语言识别改善。

Ollama v0.12.7 是一次重要的迭代更新,不仅在模型资源方面进行了扩展(Qwen3-VL、MiniMax-M2),还引入了更贴近用户使用的功能(文件输入、思考等级调节)。此外,API 的增强、后端性能优化以及大量的 Bug 修复,都让该版本在稳定性、灵活性方面都有显著提升。对于需要大模型能力的开发者而言,v0.12.7 提供了更稳定、更强大的工具环境。

Ollama v0.11.4版本虽然在表面上是常规迭代更新,但其在工具调用、推理透明度和资源管理方面的改进,显著提升了平台的实用性和可靠性。在v0.11.4之前,Ollama处理工具调用时存在一个限制:当模型决定调用工具时,其响应消息要么只包含工具调用指令,要么只包含文本内容,无法同时包含两者。虽然v0.11.4版本主要聚焦于工具调用和推理优化,但值得注意的是,Ollama团队在近期已经发布了全新

随着2025年7月30日发布的v1.12.0版本正式上线,本次更新主要聚焦于API的手动更新支持以及客户端流处理的重构,这对Go生态中需要高效、稳定调用OpenAI服务的项目尤为关键。openai-go v1.12.0版本通过引入手动API更新机制和重构流处理模块,显著提升了SDK的灵活性和性能稳定性,为Go语言环境下的OpenAI开发提供了更强大和可控的基础设施。API的规范文件是SDK生成的基

2025年8月26日,Ollama团队正式发布了v0.11.7版本,这是一个重要的功能更新版本。本次更新的核心亮点在于全面支持DeepSeek-V3.1大模型,引入了混合思考模式(Hybrid Thinking)的控制能力,并推出了Turbo云端推理模式(预览版)以应对超大参数模型的硬件需求。此外,该版本还修复了多个前版本中存在的关键问题,包括CPU-only系统下的多模型加载问题、模型输出解析异

Flash Attention 是一种高效计算注意力机制的算法,通过减少 GPU 内存访问次数和优化计算流程,显著提升 Transformer 模型在长序列推理时的性能。它尤其适用于处理大上下文窗口(如 128K 甚至更长)的模型。Ollama v0.11.8 在性能、内存管理和用户体验方面带来了多项重要改进,特别是默认启用 Flash Attention、优化模型加载速度和GPU内存管理,使其更

本次v1.2.0版本不仅带来了全新的功能配置调整,更针对核心问题进行了关键修复,还优化了底层的发布流程,为开发者提供了更加稳定、灵活和高效的开发体验。openai-go项目自诞生起,便致力于以Go语言特有的简洁与高效,封装OpenAI丰富的接口能力,简化调用流程,降低集成门槛,提升响应性能,满足企业级和个人开发者的多样化需求。在本文中,我们将全面解析openai-go v1.2.0版本的更新亮点,

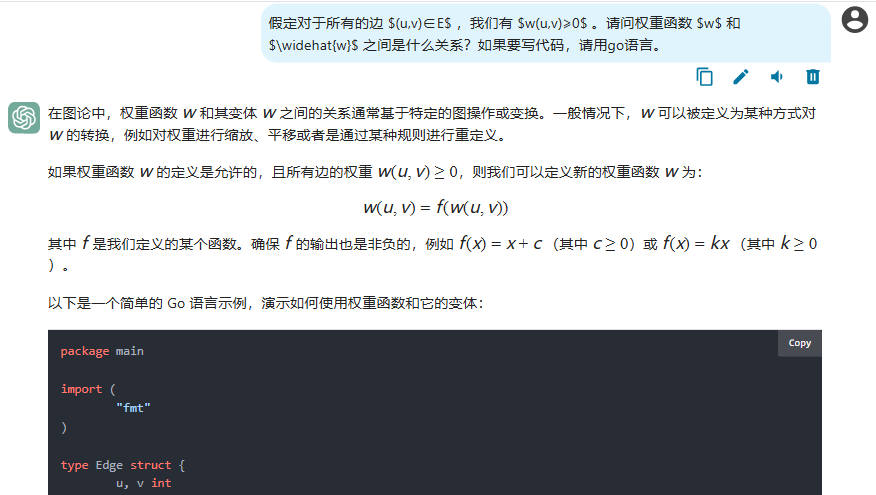

之间是什么关系?如果要写代码,请用go语言。chatgpt:chatgpt在图论中,权重函数 ( w ) 和其变体 ( \widehat{w} ) 之间的关系通常基于特定的图操作或变换。一般情况下,( \widehat{w} ) 可以被定义为某种方式对 ( w ) 的转换,例如对权重进行缩放、平移或者是通过某种规则进行重定义。如果权重函数 ( w ) 的定义是允许的,且所有边的权重 ( w(u,

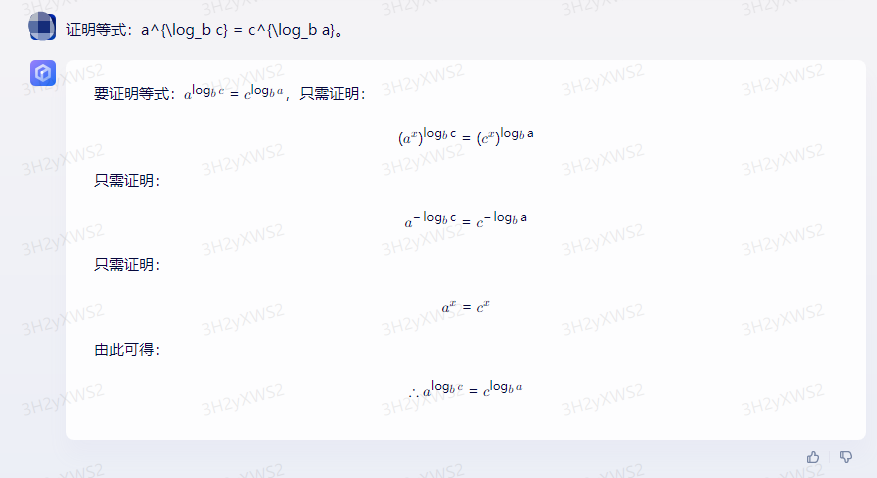

三、证明等式(3.19):\lg(n!= \omega(2 ^ n) 且 n!二、证明等式(3.16):a ^ {\log_b c} = c ^ {\log_b a}。综上所述,我们证明了等式。因此,我们证明了等式。