简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

它支持在Linux、Windows、macOS上管理 NVIDIA、AMD、Apple Silicon、昇腾、海光、摩尔线程等异构 GPU,覆盖 LLM、VLM、Embedding、Reranker、扩散图像、语音 STT/TTS 等多类型模型提供OpenAI 兼容 API 与可视化控制台,便于快速搭建企业级私有模型服务。项目采用Apache License 2.0,代码托管于 GitHub。

CPU >= 2 核内存 >= 4 GiB。

将 20.205.243.166 github.com写入保存即可!例如,20.205.243.166 github.com。到此,github可以访问!

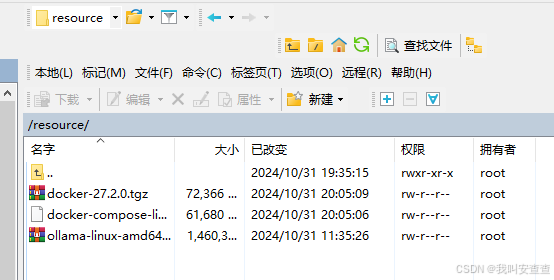

对于大多数现代Linux发行版,包括Ubuntu 20.04,推荐使用最新稳定版Docker CE(Community Edition)。当前最新的稳定版大约是20.x.x系列。链接: https://pan.baidu.com/s/1g-jLuJdNlEHWq1oHNhocng?通过网盘分享的文件:containerd.io_1.6.12-1_amd64.deb等3个文件。我的服务器Ubantu

非root用户没有超级权限,根据安装完毕会发现无法拉取镜像,或者每次运行docker都需要加上sudo,输入密码验证。

按照默认设置安装docker-desktop,千万不要自定义安装,会省去后面好多事儿。选择合适的版本下载docker,如图所示。根据自己的电脑配置去下载对于版本即可。我的电脑是64位amd。

想要让RAGFLOW利用GPU资源跑起来,可以选择docker-compose-gpu.yml启动。(但是官网启动案例是×86平台的不是NVIDIA GPU的,docker-compose-gpu.yml又是第三方维护,所以稍有问题)下面是修改后的完整docker-compose-gpu.yml文件,可以直接复制。

链接: https://pan.baidu.com/s/13vwYx18gGkQ4RdGuEHUToA?利用winSCP软件编辑/etc/systemd/system/docker.service。这里我的路径是/usr/docker,大家可以根据自己自定义安装。没有的话创建docker.service文件,然后将以下内容粘贴进去。由于加入环境变量中了,这里可以随意目录下运行该命令。注意:这里的可

如果看到 docker 在输出中,那么说明当前用户已经成功加入该组。从错误信息来看,尝试运行 Docker 容器时遇到了权限问题。3、重新启动系统或者重新登录以使更改生效。1、检查是否存在docker组。

是一个可扩展、功能丰富且用户友好的自托管 AI 平台,旨在完全离线运行。它支持各种 LLM 运行器,如 Ollama 和 OpenAI 兼容的 API,并内置了 RAG 推理引擎,使其成为强大的 AI 部署解决方案。