简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

深度学习之Transformer模型及原理学习篇(详细!)

Transformer 与 RNN 不同,可以较好地并行训练Transformer 本身是不能利用单词的顺序信息的,因此需要在输入中添加 Positional Encoding 位置编码,否则 Transformer 就是一个词袋模型了Transformer 的重点是 Self-Attention 结构,其中用到的 Q, K, V 矩阵通过线性变换得到。

深度学习之Swin Transformer学习篇(详细 - 附代码)

提出了一种新的vision Transformer,称为Swin Transformer,它可以作为计算机视觉的通用骨干。将Transformer从语言应用到视觉的挑战来自于这两个领域之间的差异,例如视觉实体规模的巨大差异以及与文本中的单词相比,图像中像素的高分辨率。为了解决这些差异,我们提出了一个分层的Transformer,它的表示是用移位窗口计算的。分层设计和移位窗口方法也被证明对所有mlp

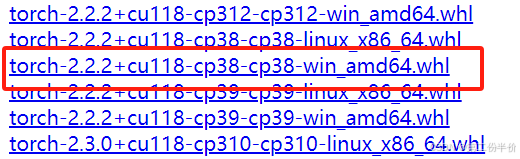

PyTorch离线版本安装(超详细版!)

首先需要下载Anaconda查看自己电脑的cuda版本:nvidia-smi。

到底了