简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

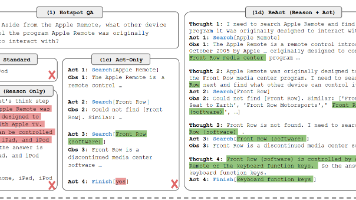

尽管大型语言模型在语言理解和交互决策任务中展现出卓越性能,但其推理能力(如思维链提示)与行动能力(如行动规划生成)此前主要被作为独立课题进行研究。本文探索以交错生成方式使大型语言模型同时产生推理轨迹与任务特定行动,从而增强二者的协同效应:推理轨迹辅助模型归纳、追踪和更新行动计划并处理异常情况,而行动使其能够与知识库或环境等外部源进行交互并获取额外信息。我们将名为ReAct的方法应用于多类语言与决策

随着对话代理的行为表现日趋拟人化,我们必须建立有效的描述框架,以高层次术语刻画其行为特征,同时避免陷入拟人化陷阱。本文凸显"角色扮演"的核心概念,通过该理论框架阐释对话代理行为,使我们能够借助熟悉的民间心理学术语进行论述,而无需将语言模型实际不具备的人类特性强加于它们。基于此方法,我们重点探讨对话代理行为中两个重要案例:表面性欺骗与表面性自我意识。

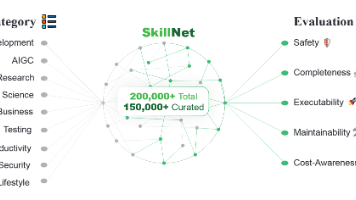

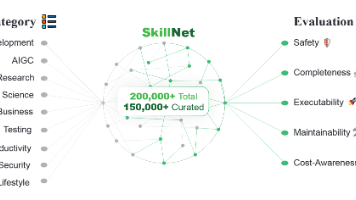

SkillNet:构建AI技能的结构化网络 摘要:本文提出SkillNet,一个用于创建、评估和组织AI技能的开放基础设施。针对当前AI智能体缺乏系统化技能积累机制的问题,SkillNet通过统一本体框架将异构技能结构化,支持从多种来源创建技能并建立丰富关联关系。该系统包含20万+技能的存储库、交互平台和Python工具包,采用五维评估标准(安全性、完整性等)确保技能质量。实验表明,在ALFWor

SkillNet:构建AI技能的结构化网络 摘要:本文提出SkillNet,一个用于创建、评估和组织AI技能的开放基础设施。针对当前AI智能体缺乏系统化技能积累机制的问题,SkillNet通过统一本体框架将异构技能结构化,支持从多种来源创建技能并建立丰富关联关系。该系统包含20万+技能的存储库、交互平台和Python工具包,采用五维评估标准(安全性、完整性等)确保技能质量。实验表明,在ALFWor

本文摘要: 本研究对40,285个公开智能体技能进行了数据驱动分析,揭示了Claude技能生态系统的现状与发展趋势。研究发现技能增长呈现爆发式特征,2026年1-2月间技能数量激增18.5倍,单日最高新增8,857项。技能内容集中在软件工程领域,长度呈重尾分布(中位数1,414词),90%技能控制在3,935词以内。分析发现生态系统存在显著同质化现象,技能冗余度高,供需匹配失衡。同时识别出非平凡安

本文摘要: 本研究对40,285个公开智能体技能进行了数据驱动分析,揭示了Claude技能生态系统的现状与发展趋势。研究发现技能增长呈现爆发式特征,2026年1-2月间技能数量激增18.5倍,单日最高新增8,857项。技能内容集中在软件工程领域,长度呈重尾分布(中位数1,414词),90%技能控制在3,935词以内。分析发现生态系统存在显著同质化现象,技能冗余度高,供需匹配失衡。同时识别出非平凡安

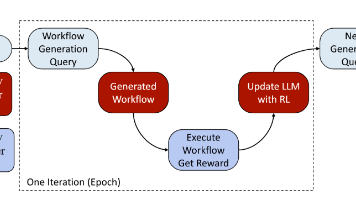

本文提出了AutoFlow框架,用于自动生成大型语言模型(LLM)代理的工作流,以解决复杂任务。传统人工设计工作流需要大量领域知识和精力,阻碍了代理的大规模部署。AutoFlow采用自然语言程序表示工作流,通过工作流优化程序迭代提升质量。框架提供两种生成方法:基于微调的方法针对特定任务优化LLM参数,基于上下文的方法则利用语境信息,适用于开源和闭源LLM。实验表明,AutoFlow生成的工作流优于

摘要——无人机在各个领域得到了广泛的应用,其对安全和隐私的侵犯引起了社会的关注。近年来,已经推出了几种用于无人机的检测和跟踪系统,但它们大多基于射频、雷达和其他介质。我们假设计算机视觉领域已经足够成熟,可以检测和跟踪入侵的无人机。因此,我们提出了一个可见光模式数据集,称为大连理工大学反无人机数据集,简称DUT反无人机。它包含一个总共10,000张图像的检测数据集和一个包含20个视频的跟踪数据集,包

有许多特征被认为可以提高卷积神经网络(CNN)的准确性。需要在大规模数据集上对这些特征的组合进行实际测试,并对结果进行理论上的验证。某些特征仅适用于特定模型和特定问题,或仅适用于小规模数据集;而一些特征,如批量归一化和残差连接,适用于大多数模型、任务和数据集。我们假设这些通用特征包括加权残差连接(WRC)、跨阶段部分连接(CSP)、跨小批量归一化(CmBN)、自对抗训练(SAT)和Mish激活函数

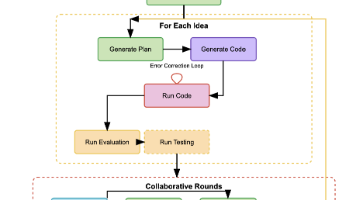

我们提出了“AI宇宙学家”,这是一个为自动化宇宙学/天文学数据分析与机器学习研究流程而设计的智能体系统。该系统实现了从想法生成、实验评估到研究成果传播的完整流程,模拟了通常由人类研究人员执行的科研过程。它通过规划、编码、执行、分析和综合等专业智能体的协同工作来开发创新性研究方法。与传统的自动化机器学习系统不同,“AI宇宙学家”能够生成多样化的实施策略,编写完整代码,处理执行错误,分析实验结果,并基