简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

在使用FastGPT的过程中,可能有的功能不符合自己的需求。如果使用docker部署没办法修改源码二次开发,所以需要本地通过源码部署。

在使用 vscode 编码 Python 时,选择合适的 Python 版本。

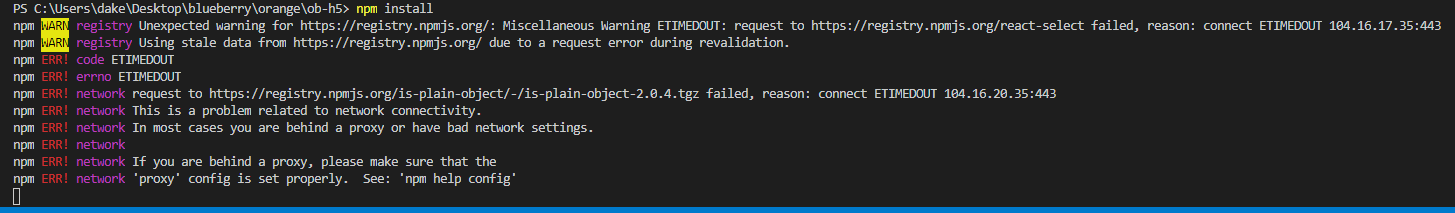

重装电脑系统后,使用npm install初始化项目依赖失败了,错误提示:‘proxy’ config is set properly…经过报错信息查询解决办法,最终找到了两个比较好的方案,在此总结一下,以便下次再遇到此类问题。

1 .结构2.参数与超参数sequence_lengthQ: 对于CNN, 输入与输出都是固定的,可每个句子长短不一, 怎么处理?A: 需要做定长处理, 比如定为n, 超过的截断, 不足的补0. 注意补充的0对后面的结果没有影响,因为后面的max-pooling只会输出最大值,补零的项会被过滤掉.num_classes多分类, 分为几类.vocabulary_size语料库的词典...

在使用 vscode 编码 Python 时,选择合适的 Python 版本。

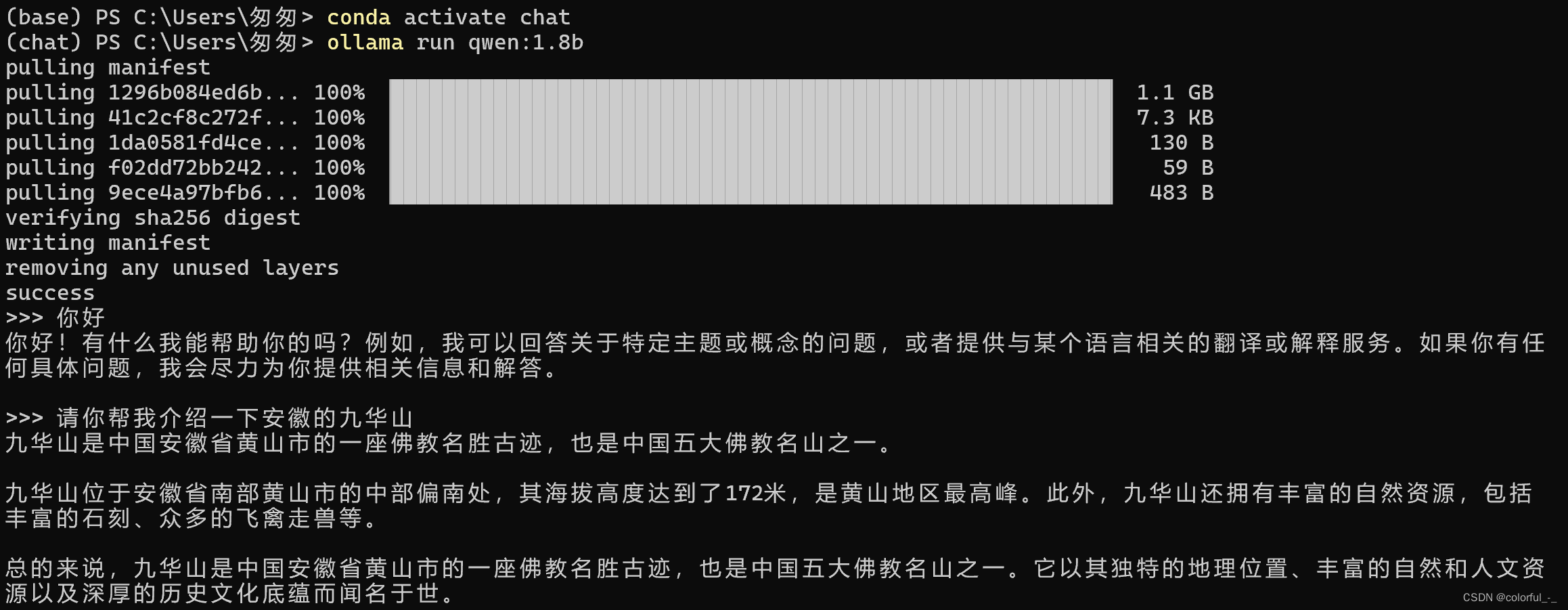

官网地址:Ollama 是一个基于 Go 语言开发的简单易用的。可以将其类比为(同基于 cobra (opens new window)包实现命令行交互中的 list,pull,push,run 等命令),事实上它也的确制定了类 docker 的一种模型应用标准,在后边的内容中,你能更加真切体会到这一点。在管理模型的同时,它还基于 Go 语言中的 Web 框架 gin (opens new win

OpenAI 接口管理 & 分发系统,支持 Azure、Anthropic Claude、Google PaLM 2 & Gemini、智谱 ChatGLM、百度文心一言、讯飞星火认知、阿里通义千问、360 智脑以及腾讯混元,可用于二次分发管理 key,仅单可执行文件,已打包好 Docker 镜像,一键部署,开箱即用.由于我的fastGPT使用的是docker部署的,而OneAPI直接下载的exe

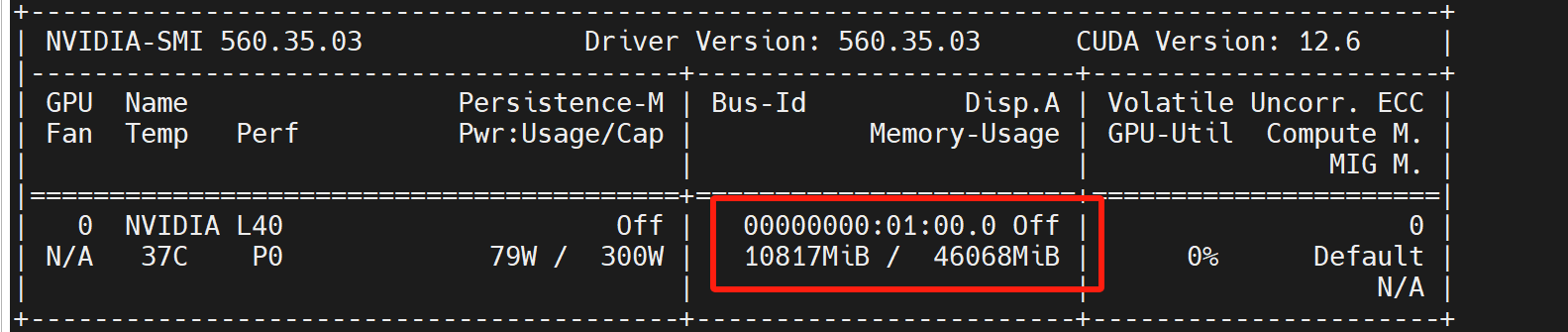

Ollama是一个支持在Windows、Linux和MacOS上本地运行大语言模型的工具。它允许用户非常方便地运行和使用各种大语言模型,比如Qwen模型等。用户只需一行命令就可以启动模型。主要特点跨平台支持Windows、Linux、MacOS系统。提供了丰富的模型库,包括Qwen、Llama等1700+大语言模型,可以在官网model library中直接下载使用。支持用户上传自己的模型。用户可

将Ollama下载的本地大模型配置到OneAPI中,并通过FastGPT调用本地大模型完成对话。

查询优化指的是旨在提高大型语言模型(LLMs)理解及回答查询的效率和质量的一系列技术,特别是在检索增强生成(RAG)场景中处理复杂查询时。通过改进用户的原始查询,这一过程带来了更加准确和上下文适当的响应,包括语义模糊、复杂需求以及查询与目标文档之间的相关性差异。为了提供完整且细致的响应,大型语言模型(LLMs)必须学会通过识别用户的意图来澄清查询,然后制定更针对性的搜索查询。查询消歧主要分为两种类