简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

什么是多层先验分布?所给定的先验分布中超参数难以确定时,可以对超参数再给出一个先验,第二个先验称为超先验。由先验和超先验决定的一个新先验就称为多层先验。简单来说,就是对你之前原本的先验分布上,再假设一层先验分布,这就是两层先验分布。(当然如果不嫌麻烦,可以无穷层的orz…)例:我们以一个例子来说明:设某产品的不合格率为θθ\theta,θθ\theta的先验为π1...

写在最前由于《An Introduction to Statistical Learning with R》课程论文需要我们进行对一些变量筛选方法与降维的方法进行综述,所以这里将分几个部分,将学到的一些变量筛选方法写在博客之中。写成一篇长博客看得比较吃力,写的也比较慢,所以这里慢慢一部分一部分的来写。综述高维统计问题来自科学研究和技术发展的多个领域,在科学与人文等不同领域中变得越来...

回顾前面我们介绍了图像的形态学操作中的腐蚀、膨胀、开运算、闭运算,这篇文章我们将继续介绍后面的形态学梯度与顶底帽变换这几种操作。同样,我们还是以可爱的小鸟来介绍。形态学梯度这种方法其实就是膨胀操作与腐蚀操作的差,便于寻找对象的轮廓。针对一些简单的二值图,或者灰度图可能比较好的提取其边缘,但如果当成一个边缘检测的方法,效果却不会很好。针对二值图与灰度图效果如下:...

数字图像发展历史数字图像处理的最早应用之一是在报纸业20世纪20年代初期,Bartlane电缆图片传输系统(纽约和伦敦之间海底电缆,经过大西洋)传输一幅数字图像所需的时间由一周多减少到小于3个小时。为了用电缆传输图像,首先要进行编码,然后在接收端用特殊的打印设备重构该图片。...

写在开始由于最近的学习需要对图像处理进行一系列的学习,从最基础的图像的基本知识到后面的图像处理的一些内容,再到最后衔接深度学习中的卷积神经网络进行一系列的博客攒写。这系列主要是从自己的想法出发,然后参考了冈萨雷斯的《数字图像处理》,以及众多百度文库、博客等内容写出来的,如有不足之处,还请大家批评指正。图像是什么?图像(image):是泛指照片、动画等等形成视觉景象的事物。计...

当我们需要储存 R 语言的数据文件时,通常会使用 save() 函数储存为 .rda 文件的格式,然后读取时再使用 load() 函数进行读取。通常情况下,这样做是完全不会有问题的,但最近遇到了一个之前未曾遇到过的很诡异的错误:Error: bad restore file magic number (file may be corrupted) -- no data loadedIn ad...

题目给定一个大小为 n 的数组,找到其中的众数。众数是指在数组中出现次数大于n/2n/2n/2的元素。你可以假设数组是非空的,并且给定的数组总是存在众数。示例 1:输入: [3,2,3]输出: 3示例 2:输入: [2,2,1,1,1,2,2]输出: 2...

I can’t open file name *.auxBy default (or design), the res documentclass does not create an auxiliary file since it executes\nofiles% resume’s don’t need .aux filesaround line 200. Modify...

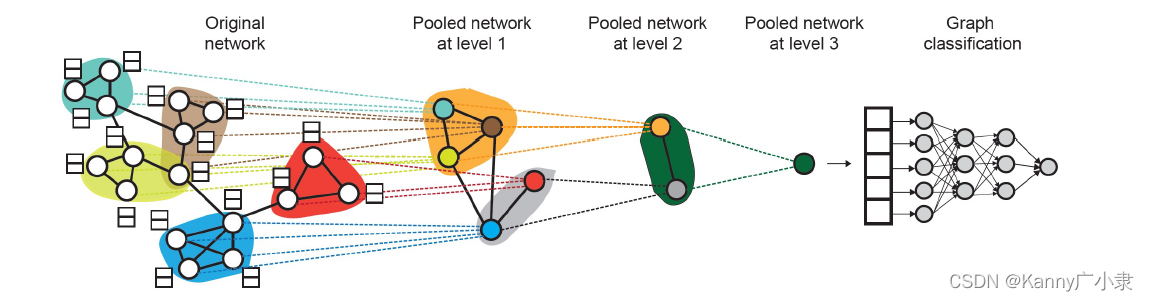

首先回顾一下整个GNN的结构,前面我们所介绍的都是红色框内所解决的任务。最终得到的节点嵌入结果,是一个关于每个在LLL层节点嵌入的集合:{hv(L),∀v∈G}\left\{\mathbf{h}_{v}^{(L)}, \forall v \in G\right\}{hv(L),∀v∈G}下面来我们来介绍图网络里,蓝色框中的预测任务(prediction head),其中包括:节点水平、边水平、图

Create a Lollipop chart:Color by groups and set a custom color palette.Sort values in ascending order.Add segments from y = 0 to dots. Change segment color and size.ggdotchart(dfm, x = “name”, y = “mp