简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

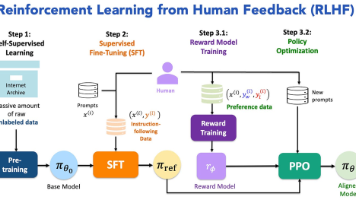

这不减少总延迟,但改善了交互体验。生成第二个token时,如果无缓存,要做L0+1->L0+2全序列计算,但有缓存,只需算新来的token,从长度1->2增长的那一点。为此,需要有监督指令微调 (Supervised Fine-Tuning, SFT):用一批“指令-正确回答”对示例,来再训练模型,使其学会在看到指令时输出期望的格式和内容。如果自己没有资源人工标注,可以采用替代方案:利用现有的指令

在这篇文章中,我们将循序渐进地阐述如何从零开始,构建一个融合对话助手、代码代理和任务代理的统一大模型应用平台。阅读完毕后,您将对“大模型是什么、如何预训练、如何对齐成为ChatGPT、如何产品化部署、如何做检索增强生成(RAG)与智能Agent、如何实现代码助手,以及如何搭建整个平台并做好上线治理”形成深刻且可实践的整体理解。

在当今信息爆炸的时代,知识工作者面临着前所未有的挑战。每天需要处理海量信息、跨平台协作、重复性任务和时间管理压力,而传统生产力工具往往只能提供"点状"解决方案,无法形成真正的闭环。工作方式的范式正在经历一场静默的革命——从"人操作软件"到"AI代理直接干活",从"对话应答"到"任务执行",从"被动工具"到"主动协作者"。这场变革不仅关乎效率提升,更深刻影响着知识工作者的角色定位、价值创造和职业发展

本文将手把手带您快速上手LlamaIndex,通过一个本地问答Demo体验其核心流程。目标是在几行代码内完成从文档加载、索引构建到查询问答的闭环,让您对LlamaIndex有直观认识。我将介绍安装配置步骤,运行一个“五行代码”的本地问答示例,并详细剖析示例代码的工作原理。通过本文,您将能够搭建起第一个简单的RAG应用,为后续深入学习各模块打下基础。

LlamaIndex作为连接大型语言模型与私有数据的中间层框架,解决了LLM无法直接访问企业文档、数据库等私有信息的痛点。其核心通过"检索+生成"机制,将原始数据转换为索引结构,使LLM能够查询外部知识库并基于检索结果生成准确答案。框架包含数据加载、文档切分、向量嵌入、索引构建、查询引擎等模块,形成完整的数据处理流程。与LangChain等流程编排框架不同,LlamaIndex

本文介绍了如何使用LangGraph构建一个"聊天计算器"工作流,演示了从定义工具、状态、节点到条件边的完整流程。文章对比了Graph API和Functional API两种构建方式:Graph API适合复杂决策流程,支持可视化调试和并行处理;Functional API则更轻量,便于现有代码集成和快速原型开发。通过具体示例,读者可以掌握LangGraph的核心概念,包括状

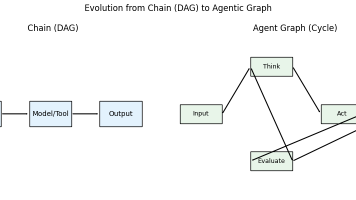

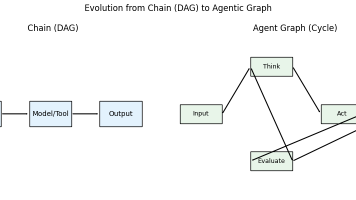

摘要 链式编排(Chain)是早期LLM应用框架的核心模式,通过线性或有向无环图(DAG)串联组件,适合简单静态任务。但其存在无法表示循环、分支控制困难、隐式状态管理等局限性,难以满足复杂代理系统的需求。智能代理本质上是具有循环与决策能力的图结构,需要动态处理LLM的不确定性、多Agent协作等场景。LangGraph等工具通过引入图结构、状态机和条件边,实现了代理所需的循环控制、动态流程和显式状

本章围绕 State 是 LangGraph 的核心与灵魂 展开,从工程实践角度深入剖析了为什么 Agent 系统真正的复杂度不在模型,而在状态设计。文章系统讲解了 LangGraph 选择 TypedDict + Annotated 的设计动机,解释了 State 的不可变性与累积更新机制,以及 reducer 在多节点并发场景下的关键作用。同时结合真实开发经验,总结了多节点共享状态的安全模式,

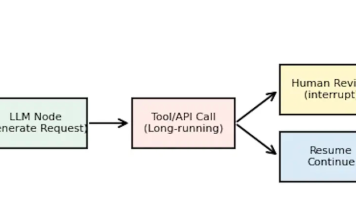

LangGraph框架专注于解决现实场景中的复杂流程问题,支持长流程执行、人机协同和多Agent协作。其核心优势包括:1)通过持久化检查点实现分钟级任务的可靠执行;2)提供interrupt/resume机制实现任意节点的人工干预;3)支持多Agent模块化协作,提升任务处理质量。典型案例涵盖金融合规审核、科研自动化等需要长时间运行或人工参与的流程,但不适用于简单对话场景。LangGraph通过状

摘要 链式编排(Chain)是早期LLM应用框架的核心模式,通过线性或有向无环图(DAG)串联组件,适合简单静态任务。但其存在无法表示循环、分支控制困难、隐式状态管理等局限性,难以满足复杂代理系统的需求。智能代理本质上是具有循环与决策能力的图结构,需要动态处理LLM的不确定性、多Agent协作等场景。LangGraph等工具通过引入图结构、状态机和条件边,实现了代理所需的循环控制、动态流程和显式状