简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

在深度学习当中常用的技术就是防止过拟合化的。在模型的训练阶段,让隐藏的神经元一部分工作,一部分不工作。(1)神经元工作与不工作的比例是在写程序的时候可以设置参数的。(2)把输入x通过修改后的网络前向传播,然后把得到的损失结果通过修改的网络反向传播。一小批训练样本执行完这个过程后,在没有被删除的神经元上按照随机梯度下降法更新对应的参数(w,b)。在做权重的调整的时候,只是对没有删除(工作的)的神经元

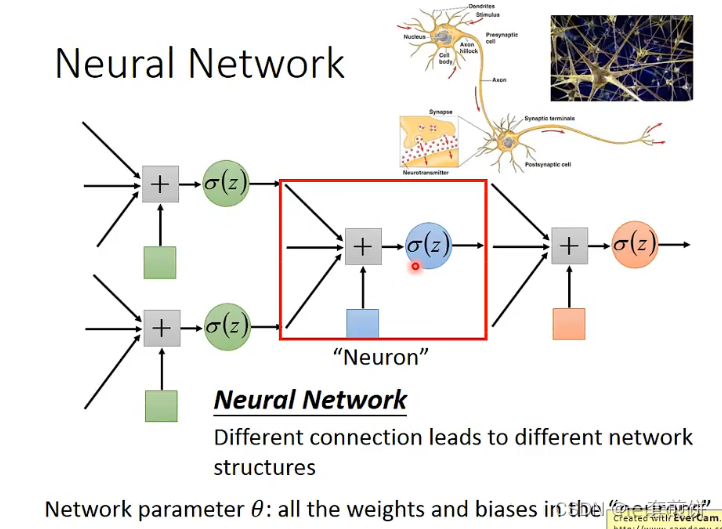

回顾深度学习的历史:深度学习的步骤:三步(大象放进冰箱)在上面的步骤当中:第一步是定义一个函数,其实就是一个Neural network。那这个Neural network是什么呢?我们把这个Logistic Regression前后连接起来,然后把一个Logistic Regression(逻辑回归)称之为Neuron(神经元),那我们就得到了一个Neural network。我们可以用不同的方

受限玻尔兹曼机:提取特征用的,两层的结构。可见层和隐藏层,可见层输入以后,通过权值和偏置的叠加,变成概率的计算,决定隐藏层出现什么样的数据。而隐藏层可以反过来重构可见层,一直以这样的规则继续下去。这个过程就是吉布斯采样,吉布斯采样是一个逐渐逼近玻尔兹曼分布,最终的理想结果是最终迭代的结果和预先训练好的向量,达到分类的目的。除了分类的用途,另一个用途是,因为隐藏层在不断的迭代过程中会逐渐在一个概率范

假设现在有一个分类器A,这个分类器A的作用是告诉一张图片是不是汉堡,那我想知道这个分类器A的效果好不好,应该怎么办呢?最简单的方法是将大量的样本放进到费雷其A当中,让他自己判断这些图片是不是汉堡。经过上面的过程就可以得到一张表格:实际上这张表格是非常庞大的。有成千上万的图片,当他的维度十分大的时候是没办法看出来的。现在就是用一种方法能够直观地表示实验结果,但是又不损失其中的信息,那看一下他的输出结

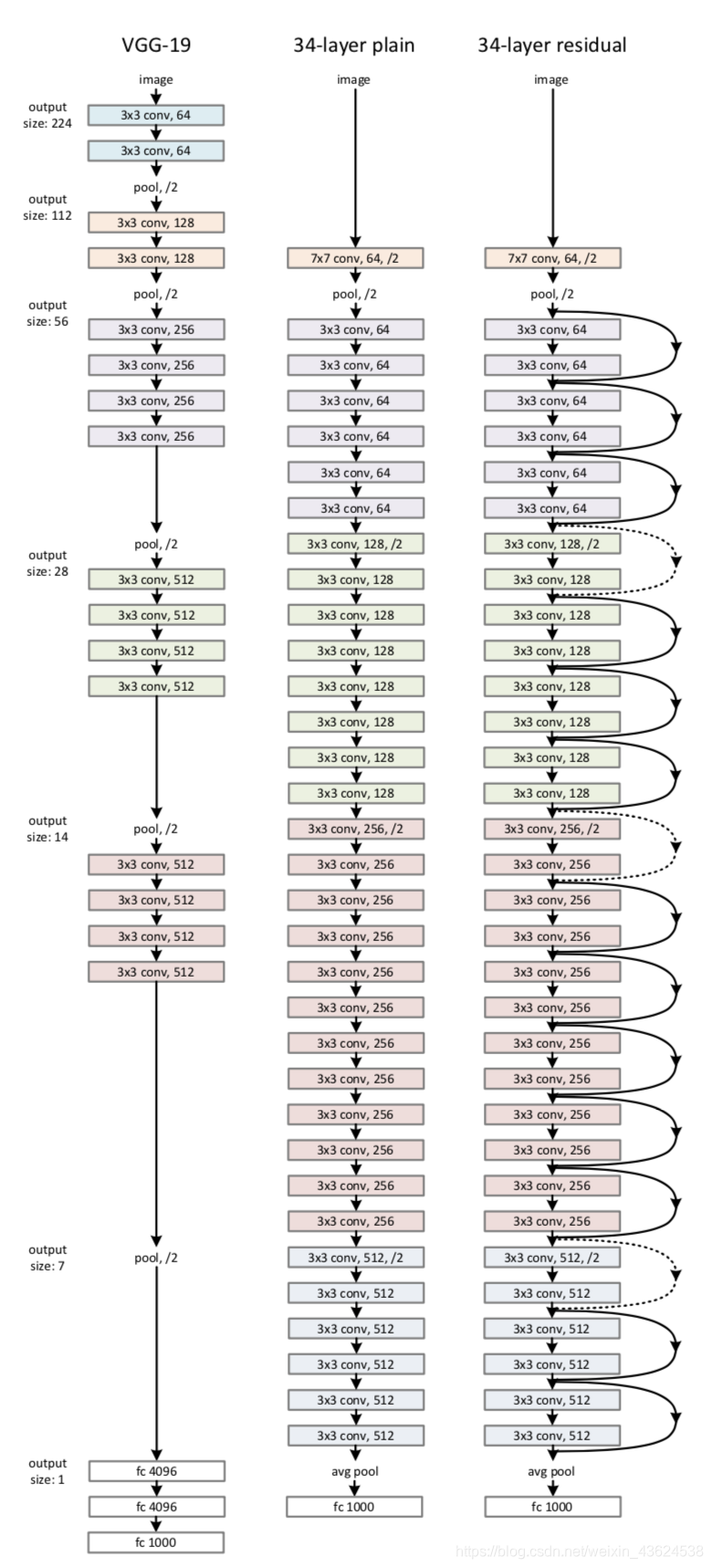

ResNet-34再34层的ResNet的结构简图当中:首先是卷积层,然后是池化层,有连接线的结构就是一个残差结构再这个34层的ResNet是由一系列的残差结构组成的。最后通过一个平均池化层以及一个全脸基层也就是输出层组成的。这个网络的结构十分简单,基本就是堆叠残差结构组成的。ResNet结构的一些亮点:超深的网络结构(突破了1000层)提出residual模块使用BN加速训练简单的堆叠卷积层和池

ResNet-34再34层的ResNet的结构简图当中:首先是卷积层,然后是池化层,有连接线的结构就是一个残差结构再这个34层的ResNet是由一系列的残差结构组成的。最后通过一个平均池化层以及一个全脸基层也就是输出层组成的。这个网络的结构十分简单,基本就是堆叠残差结构组成的。ResNet结构的一些亮点:超深的网络结构(突破了1000层)提出residual模块使用BN加速训练简单的堆叠卷积层和池