简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

很简单,以下代码即可:for name, param in mymodel.named_parameters():print(name)print(param.data)print("requires_grad:", param.requires_grad)print("-----------------------------------")输出示例:clientA.0.weighttensor

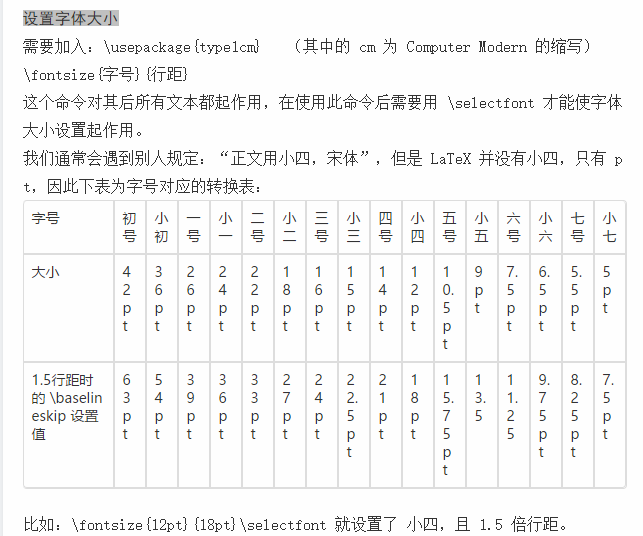

1. 设置字体居中、颜色及粗体,斜体\begin{center}{\color{blue}\textbf{balabala\hspace{1cm} balabala}\emph{balabala}}\end{center}设置字体大小:2. 空格的表示\, 表示空格\hspace{ 长度 } , 例如 \hspace{1cm}在数学环境中($........$ ...

Ubuntu默认是没有开启root账户登录选项的,想要在启动系统时用root账户登录系统,需要自己进行额外的设置。STEP 1首先设置root账户的密码。sudo passwd root执行命令后,首先输入当前账户密码,确认无误后,系统会提示Enter new UNIX password,这是root密码,自行设置。注意在Ubuntu的命令行中,输入的密码是不可见的,只需要输入之后回车即...

逻辑回归(logistic regression)逻辑回归(LR)可以看做线性回归(linear regression)的拓展,二者的区别是:逻辑回归的结果为0或1,即分类;线性回归的结果是连续值,即回归1。Binary LR本文重点在二分类逻辑回归,其一般形式为:y^=σ(z)=σ(xTw) .\hat{y}=\sigma(z)=\sigma(\boldsymbol{x^T}\boldsymbo

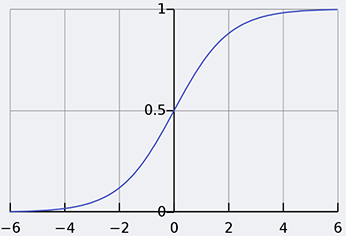

通常情况下,我们所说的Sigmoid函数定义如下:σ(x)=11+e−x=exex+1.\sigma(x)=\frac{1}{1+e^{-x}}=\frac{e^x}{e^x+1}.σ(x)=1+e−x1=ex+1ex.它的形状如下:导数如下:dσ(x)dx=σ(x)⋅(1−σ(x)).\frac{d\sigma(x)}{dx}=\sigma(x)\cdot (1-\sigma(x)).dxd

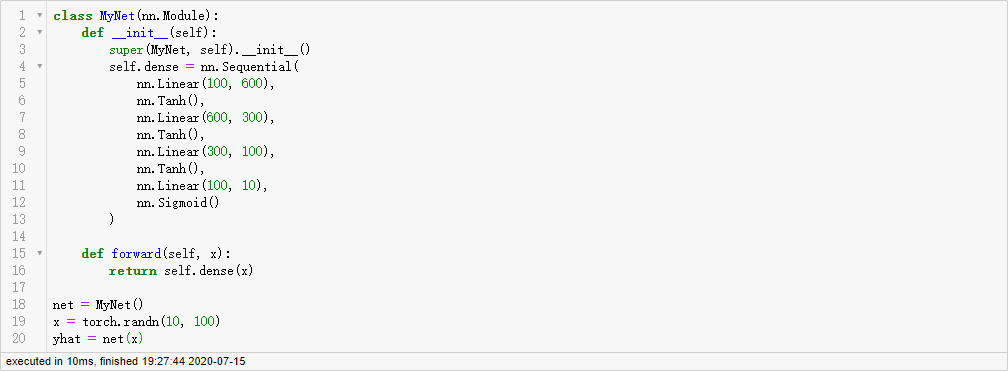

PyTorchViz包(https://github.com/szagoruyko/pytorchviz)可以用来方便地绘制PyTorch正向网络计算图和后传计算路径,本文讲解如何使用PyTorchViz包,主要参考网站包括:https://towardsdatascience.com/understanding-pytorch-with-an-example-a-step-by-step-tut

PyTorchViz包(https://github.com/szagoruyko/pytorchviz)可以用来方便地绘制PyTorch正向网络计算图和后传计算路径,本文讲解如何使用PyTorchViz包,主要参考网站包括:https://towardsdatascience.com/understanding-pytorch-with-an-example-a-step-by-step-tut

对数公式的换算,对于算法复杂度的推导非常重要。但是我总忘,这次特地总结一下常用的对数公式,以备后用。名称公式和差logαMN=logαM+logαN\log_\alpha MN=\log_\alpha M+log_\alpha NlogαMN=logαM+logαN换底公式logαx=logβxlogβα\log_\alpha x=\frac{\lo...