简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

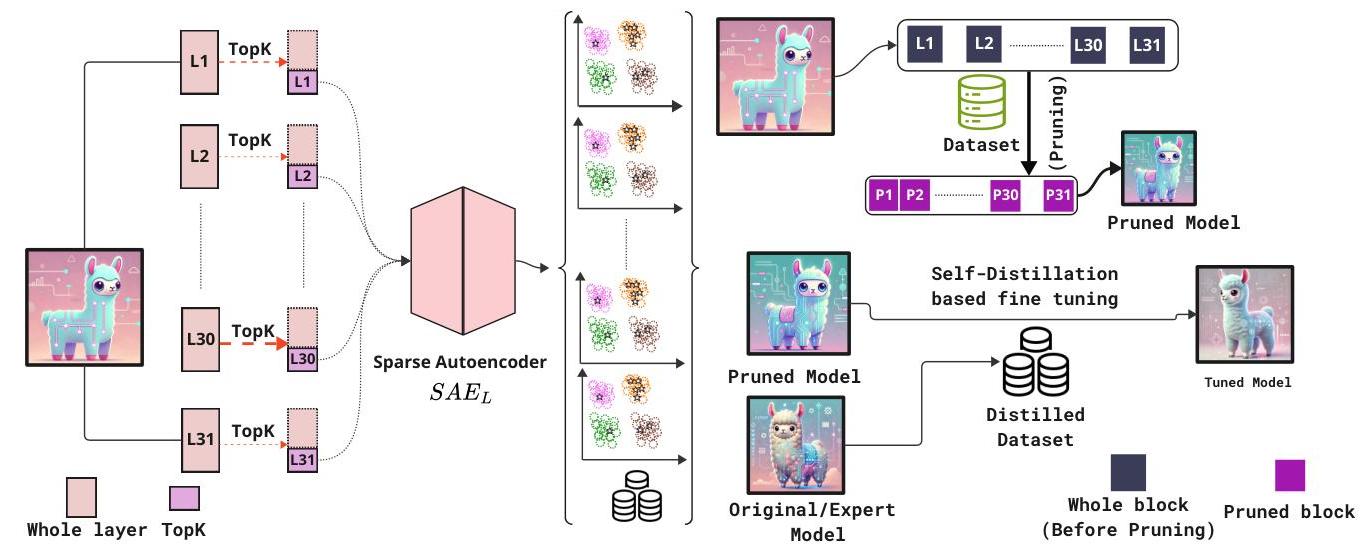

从头开始训练大语言模型(LLMs)需要显著的计算资源,这推动了开发更小、领域专用的LLMs的兴趣,这些模型既要保持效率又要具备强大的任务性能。中型模型如LLaMA (Touvron等人, 2023b;a) 已成为领域特定适应的起点,但当在专门的数据集上测试时,它们通常会遭遇准确性的下降。我们介绍了FineScope,这是一种从更大的预训练模型中提取紧凑、领域优化的LLM框架。

多模态大语言模型(MLLMs)在图表理解任务中展示了卓越的能力。然而,使用文本描述来解释图表往往会导致信息丢失,因为它无法完全捕捉图表中嵌入的密集信息。相比之下,将图表解析为代码提供了无损表示,可以有效地包含所有关键细节。尽管现有的开源MLLMs在图表理解任务中取得了成功,但在应用于图表到代码任务时仍面临两大挑战:(1) 生成代码的可执行性低且图表细节恢复不佳;(2) 缺乏大规模和多样化的训练数据

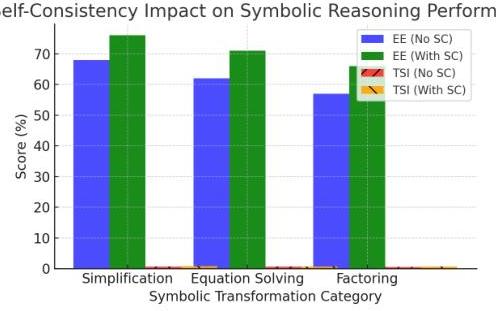

大语言模型(LLMs)已经展现出强大的数学推理能力,但仍然容易产生幻觉——即生成看似合理但实际上错误的陈述——尤其是在定理证明、符号操作和数值计算方面。尽管自我一致性(SC)已被探索作为提高LLMs事实性的一种方法,现有方法主要将SC应用于最终答案的选择,忽略了中间推理步骤的逻辑一致性。在本研究中,我们引入了一种结构化的自我一致性框架,旨在提高数学推理的可靠性。我们的方法在中间步骤和最终输出中强制

强化学习(RL)已被证明在微调大型语言模型(LLMs)方面非常有效,显著增强了它们在数学和代码生成等领域的推理能力。影响RL微调成功的一个关键因素是训练课程:即训练问题的呈现顺序。虽然随机课程作为常见的基线方法,但它们仍然次优;手动设计的课程通常依赖于启发式规则,在线过滤方法可能计算成本过高。为了解决这些限制,我们提出了自适应进化课程(SEC),这是一种自动课程学习方法,与RL微调过程同时学习课程

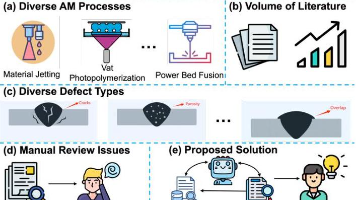

1{ }^{1}1康涅狄格大学机械、航空航天与制造工程学院,Storrs, CT 062692{ }^{2}2康涅狄格大学计算机科学学院,Storrs, CT 062693{ }^{3}3新泽西州立大学罗格斯分校机械与航空航天工程系,Piscataway, NJ 08854邮箱: hongyi.3.xu@uconn.edu本研究提出了一种新颖的多模态检索增强生成框架,利用从文献中检索到的信息(包括

为了提升大语言模型(LLMs)的数学能力,DeepMath团队启动了一项开源计划,旨在开发开放数学LLM并系统评估其数学创造力。本文代表了这一计划的初步贡献。尽管近年来数学LLM的发展主要强调推理技能,这在基础到本科水平的数学任务基准中得到了证明,但这些模型的创造能力却较少受到关注,且评估数据集仍然稀缺。为弥补这一差距,我们提出了数学创造力的评估标准,并引入了DeepMath-Creative,这

本文提出了一种全面评估大语言模型(LLMs)表格推理能力的基准TReB,包含26个子任务,覆盖6大核心技能(自然语言理解、表格理解、表格基本操作、表格计算操作、数据分析和高级数据分析)。针对现有基准在数据质量、推理模式和评估指标方面的不足,TReB构建了高质量数据集(含人工验证的5,000+表格问答对),支持三种推理模式(TCoT、PoT、ICoT),并设计了多维度评估指标。实验测试了20+先进L

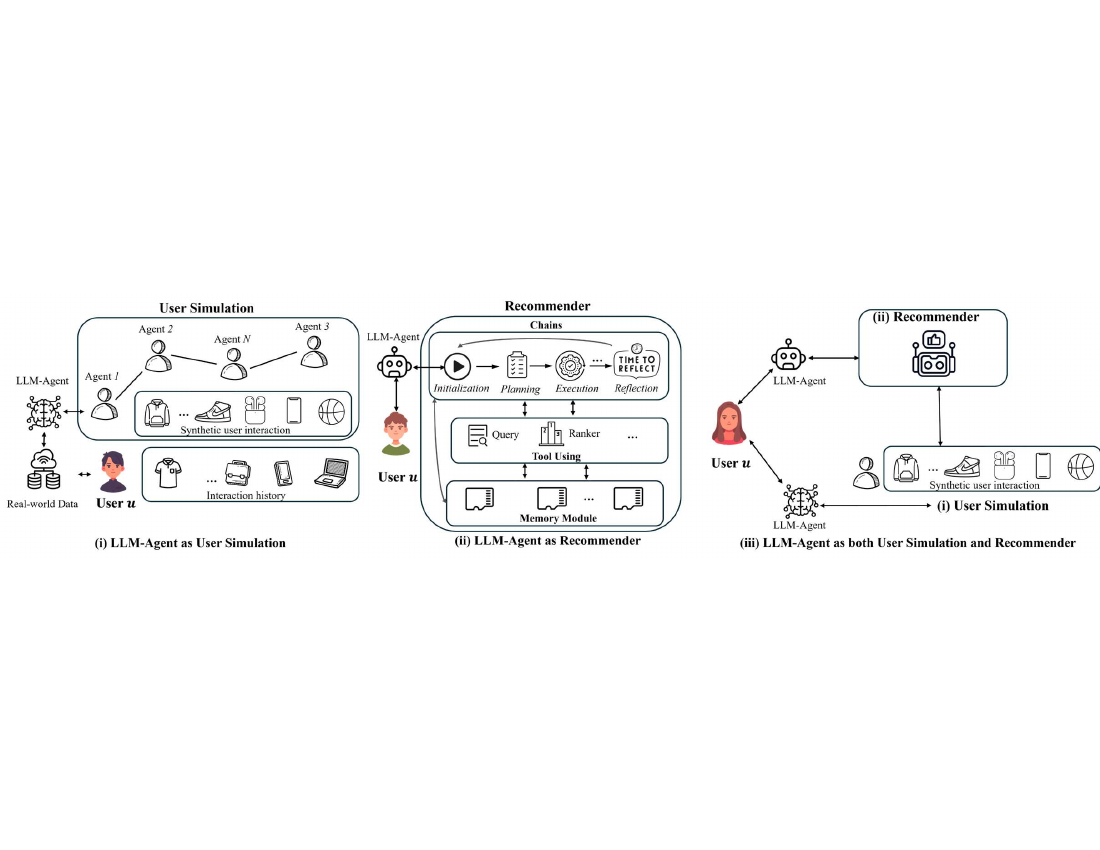

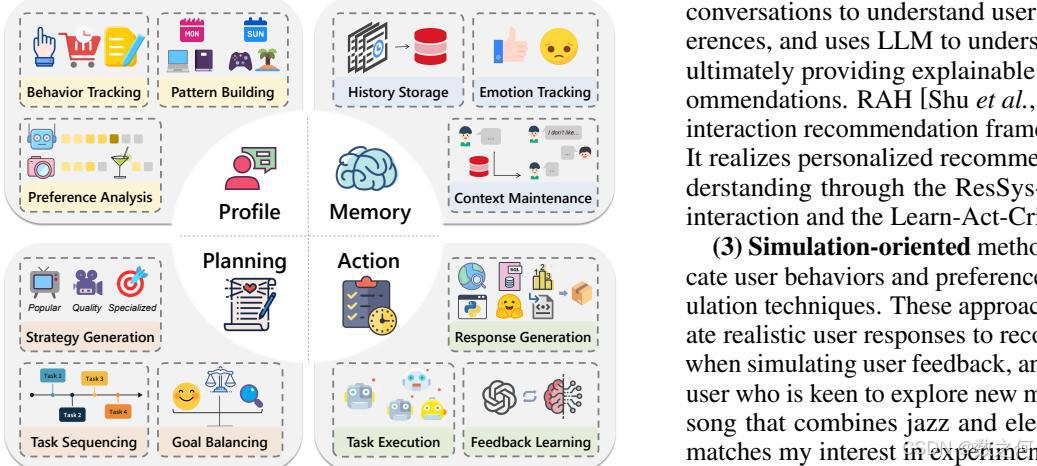

近期大语言模型(LLMs)的突破性进展催生了超越单一模型能力的代理型人工智能系统。通过赋予LLMs感知外部环境、整合多模态信息和与各种工具交互的能力,这些代理系统在复杂任务中表现出更大的自主性和适应性。这一演变带来了推荐系统(RS)的新机遇:基于LLM的代理型推荐系统(LLM-ARS)可以提供更加互动、情境感知和主动的推荐服务,可能重塑用户体验并拓宽推荐系统的应用范围。尽管早期结果令人鼓舞,但基本

推荐系统是许多在线平台的重要组成部分,但传统方法在理解复杂的用户偏好和提供可解释的推荐方面仍存在困难。基于大语言模型(LLM)的代理通过实现自然语言交互和可解释的推理,为推荐系统的研究提供了新的途径。本文系统地回顾了基于LLM的代理在推荐系统中的新兴应用。我们识别并分析了当前研究中的三个关键范式:(1)推荐导向的方法,利用智能代理增强基本的推荐机制;(2)交互导向的方法,通过自然对话和可解释的建议

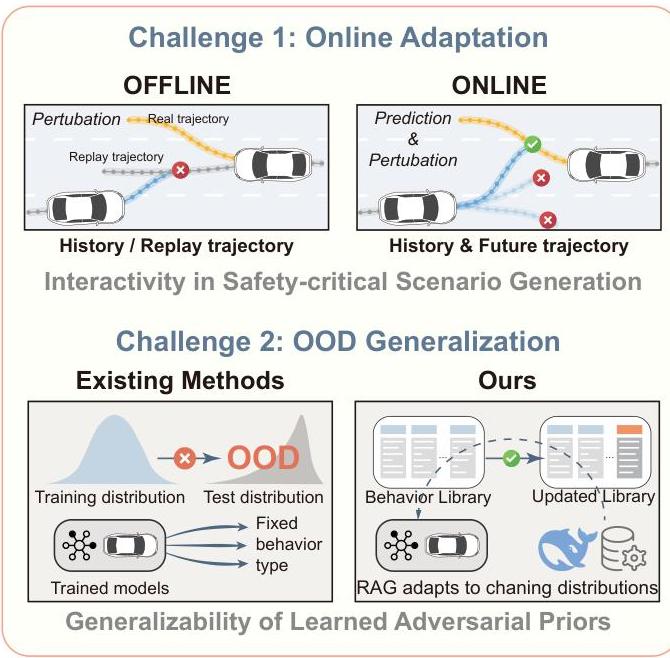

基于仿真的测试对于验证自动驾驶车辆(AVs)至关重要,但现有的场景生成方法要么过度拟合常见的驾驶模式,要么以离线、非交互的方式运行,无法暴露罕见的安全关键边缘案例。本文介绍了一种基于在线检索增强的大语言模型(LLMs)框架,用于生成安全关键的驾驶场景。我们的方法首先使用基于LLM的行为分析器从观察到的状态中推断背景车辆最危险的意图,然后查询其他LLM代理以合成可行的对抗性轨迹。为了缓解灾难性遗忘并