简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

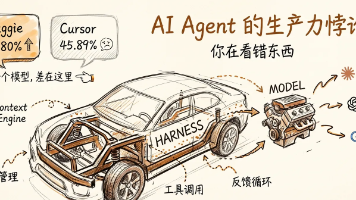

AI编程工具的性能差异更多取决于工程框架而非底层模型。研究表明,同一模型在不同框架下可产生6%的性能差距,关键在于ContextEngine系统——它负责代码检索、上下文管理和信息筛选。框架质量体现在三方面:上下文管理策略(防信息过载)、工具定义精度(减少歧义)、反馈循环完整性(自动验证修复)。LangChain案例显示仅优化框架即可让排名从30升至5。当前AI编程存在"生产力悖论&qu

很多 Go 安全事故不是因为开发者不知道“最佳实践”,而是因为他们误以为 Go 的语言安全会延伸到业务语义安全。本文用两层模型拆开这个误区:第一层是 Go 已经替你兜住的语言和工具链安全,第二层是必须由开发者自己守住的业务边界。文章用 8 组 PoC 和 gosec 扫描数据说明:真正高危的问题,几乎都发生在第二层。

《AI黑话解码:当老朋友戴上新口罩》一文揭示了当前AI领域术语爆炸现象的本质——大部分新名词只是传统软件工程概念的"换马甲"版本。文章通过三层结构解析AI黑话:1) 重点剖析Prompt/Context/Harness工程、Skills、MCP等10个核心概念的技术本质;2) 提供30+辅助术语速查词典;3) 分类评估各术语的学习价值。作者指出,AI术语激增源于模型厂商营销、工

Hermes 根本不需要"击败"OpenClaw。它在做一件更聪明的事。

Go语言插件系统的设计困境与替代方案 摘要:本文深入分析了Go语言插件系统的根本缺陷,指出其静态编译模型与动态加载机制的本质冲突。通过实测数据对比了5种扩展方案(原生plugin、yaegi解释器、wazero WASM、go-plugin RPC等)的性能与代价,揭示最快方案往往伴随致命缺陷。文章提出反直觉观点:大多数场景并不需要真正的插件系统,配置热更新可通过配置中心实现(延迟<10ms

本文从简单的Go语言TCP echo服务器示例出发,探讨了从基础实现到生产可用服务器的三个关键进阶层次:连接管理、协议设计和性能调优。在连接管理层面,文章分析了goroutine的内存成本、CLOSE_WAIT连接泄漏问题及TIME_WAIT的解决方案;在协议设计层面,重点阐述了TCP粘包现象的成因及应对策略。通过实测数据和实际案例,作者揭示了网络编程中常见的陷阱和优化方向,为开发者提供了从&qu

本文从简单的Go语言TCP echo服务器示例出发,探讨了从基础实现到生产可用服务器的三个关键进阶层次:连接管理、协议设计和性能调优。在连接管理层面,文章分析了goroutine的内存成本、CLOSE_WAIT连接泄漏问题及TIME_WAIT的解决方案;在协议设计层面,重点阐述了TCP粘包现象的成因及应对策略。通过实测数据和实际案例,作者揭示了网络编程中常见的陷阱和优化方向,为开发者提供了从&qu

Go插件系统的设计困境与替代方案 本文深入分析了Go语言在插件系统设计上的根本性缺陷。Go官方plugin包存在不可卸载、版本强耦合、平台限制等8项严重问题,其根本原因在于Go的静态编译模型与动态加载机制存在本质冲突。作者通过实测数据对比了5种扩展方案:原生plugin调用(1-3ns)、yaegi解释器(370ns)、wazero WASM(30ns)和go-plugin RPC(30-50μs

AI Agent架构升级的临界点信号 当单Agent系统出现以下五个信号时,可能需要考虑拆分为多Agent架构: 提示词膨胀:系统提示超过4000token且60%以上是工具描述和冲突规则 工具打架:工具间功能重叠导致决策犹豫,调用准确率明显下降 上下文挤爆:固定开销占用过多注意力资源,影响核心任务执行 调试地狱:问题定位时间超过开发时间,难以复现多环节bug 角色分裂:同一Agent需要同时承担

《AI黑话解码:当老朋友戴上新口罩》一文揭示了当前AI领域术语爆炸现象的本质——大部分新名词只是传统软件工程概念的"换马甲"版本。文章通过三层结构解析AI黑话:1) 重点剖析Prompt/Context/Harness工程、Skills、MCP等10个核心概念的技术本质;2) 提供30+辅助术语速查词典;3) 分类评估各术语的学习价值。作者指出,AI术语激增源于模型厂商营销、工