简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

近期国内AI领域迎来多项重要突破:阿里推出万亿参数推理模型Qwen3-Max-Thinking,性能媲美国际顶尖大模型;DeepSeek开源OCR 2,首创"因果流"视觉推理技术,文本识别准确率提升3.73%;月之暗面开源多模态模型Kimi K2.5,支持视觉输入和Agent集群协作;腾讯混元图像3.0开源,跻身全球最强开源图生图模型。同时,OpenAI发布科研协作平台Pris

文章目录CNN发展1. AlexNet2. VGG3. GoogleNet4. Inception5. ResNet6. Xception7. ShuffleNet8. SENet9. CNN总结10. CNN在NLP的应用CNN发展1. AlexNet卷积核一定越大越好吗?-- 小卷积核分组卷积首先在在AlexNet中出现,还用到一些非常大的卷积核,比如11×11、5×5卷积核,先前的观念是:卷

文章目录CNN1. CNN基本结构2. 卷积和通道2.1 分组卷积(Group Convolution)2.2 Convolution VS Group Convolution2.3 Group Convolution的用途2.4 Depthwise Convolution && Pointwise Convolution && Depthwise Separabl

文章目录1. CNN1.1 基本结构1.2 CNN 网络1.2.0 卷积和通道1.2.0.1 分组卷积(Group Convolution)1.2.0.2 Convolution VS Group Convolution1.2.0.3 Group Convolution的用途1.2.0.4 Depthwise Convolution && Pointwise Convolution

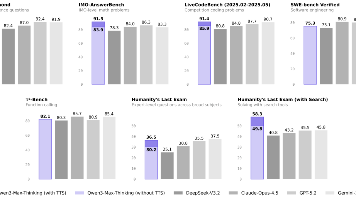

得益于 VisCPM 的跨语言泛化技术,在中英双语多模态能力的基础上,MiniCPM-Llama3-V 2.5 仅通过少量翻译的多模态数据的指令微调,高效泛化支持了德语、法语、西班牙语、意大利语、俄语等 30+ 种语言的多模态能力,几乎覆盖了所有一带一路的国家,意味着全球上百个国家的数十亿人口,都能与 MiniCPM-Llama3-V 2.5 丝滑交互。OCR 技术进一步打磨,复杂推理与多模态识别

BGE 不仅性能综合卓越,多次大幅刷新 BEIR、MTEB、C-MTEB 等领域内主流评测榜单,而且始终秉持彻底的开源开放的精神,“模型、代码、数据” 向社区完全公开。经过训练,Pixtral-12B 既能理解自然图像,也能理解文档,在各种多模态基准测试中取得了领先的性能,超越了许多大模型。在训练方面,Rhymes AI 共分为四个阶段,先用文本数据进行预训练,再引入多模态数据,接着是长序列的训练

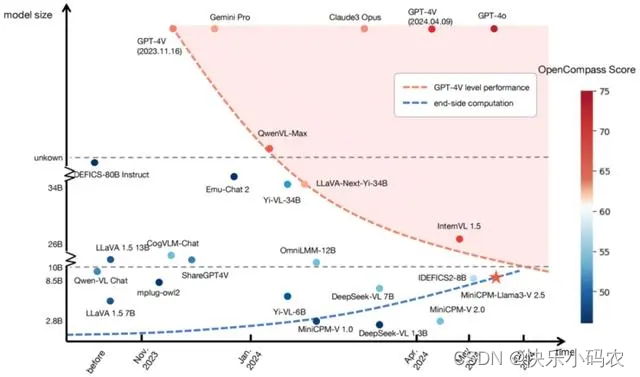

来自谷歌、 UCLA 的研究者提出了一种通过程序搜索发现深度神经网络训练的优化算法,来自论文《Symbolic Discovery of Optimization Algorithms》。通过数千TPU小时的算力搜索并结合人工干预,得到一个更省显存且速度更快的优化器 Lion(EvoLved Sign Momentum),其在图像分类、图文匹配、扩散模型、语言模型预训练和微调等诸多任务上做了充分的

清华大学开源全球首个多智能体AI教学框架OpenMAIC,实现一键生成沉浸式课程。该平台支持上传文档或输入主题自动生成包含PPT、测验等完整课程内容,并配备AI教师和同学进行互动教学。OpenMAIC特别强调个性化学习体验,可应用于从专业课程到儿童科普等多种场景,支持多语言和语音交互。其核心目标是解决在线教育的三大痛点:因材施教、互动陪伴和教师减负。项目开源后迅速引发广泛关注,用户可通过简单操作直

整个周末,一个叫做 Clawdbot 的AI智能体突然爆火。被它顺带带火的,还有 Mac mini。

近期国内AI领域迎来多项重要突破:阿里推出万亿参数推理模型Qwen3-Max-Thinking,性能媲美国际顶尖大模型;DeepSeek开源OCR 2,首创"因果流"视觉推理技术,文本识别准确率提升3.73%;月之暗面开源多模态模型Kimi K2.5,支持视觉输入和Agent集群协作;腾讯混元图像3.0开源,跻身全球最强开源图生图模型。同时,OpenAI发布科研协作平台Pris