简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

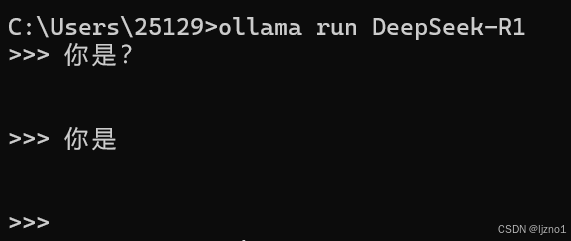

90%用户的电脑配置低,那要怎么本地部署化deepseek R1呢,如果你的DeepSeek只在CPU和内容中运行(显存占用很低)。或者是你不知道如何在本地部署DeepSeek,那么本篇文章将帮助你解决这个问题。本地部署后的特点是无需联网、使用丝滑、完全免费,从此告别服务器繁忙。下面以本人AMD普通显卡Radeon 780M本地部署DeepSeek R1为例,1. Ollama部署Ollama是一

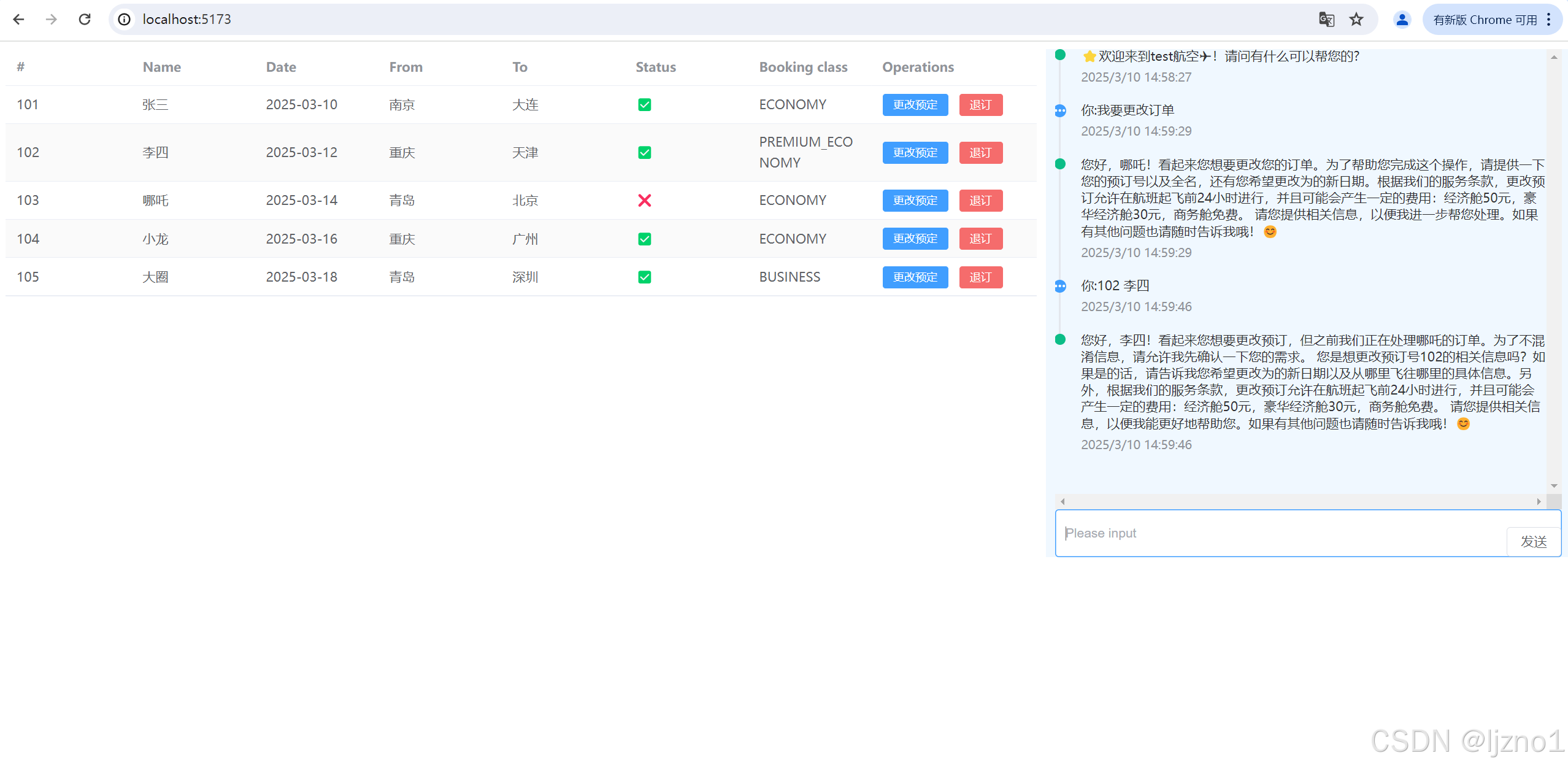

model_name='D:/AI/pro/modelscope/BAAI/bge-large-zh-v1___5' cache_folder=None model_kwargs={} encode_kwargs={} query_instruction='为这个句子生成表示以用于检索相关文章:' embed_instruction='' show_progress=False。找到相应的id对应

文档结构感知分块:网页3的SemanticRAG方案强调按医疗文档章节结构拆分(如按"诊断依据-治疗方案"分段),并保留层级标题作为元数据,生成阶段通过标题关联确保逻辑连贯。- 表格语义重构:将医疗报告中的表格转换为"行标题: 值"的键值对格式(如"空腹血糖: 7.8mmol/L"),避免传统分块导致的表头与数据分离问题。- 对慢性病随访数据,按时间轴组织检索结果,通过时间编码器(如TimeBER

90%用户的电脑配置低,那要怎么本地部署化deepseek R1呢,如果你的DeepSeek只在CPU和内容中运行(显存占用很低)。或者是你不知道如何在本地部署DeepSeek,那么本篇文章将帮助你解决这个问题。本地部署后的特点是无需联网、使用丝滑、完全免费,从此告别服务器繁忙。下面以本人AMD普通显卡Radeon 780M本地部署DeepSeek R1为例,1. Ollama部署Ollama是一

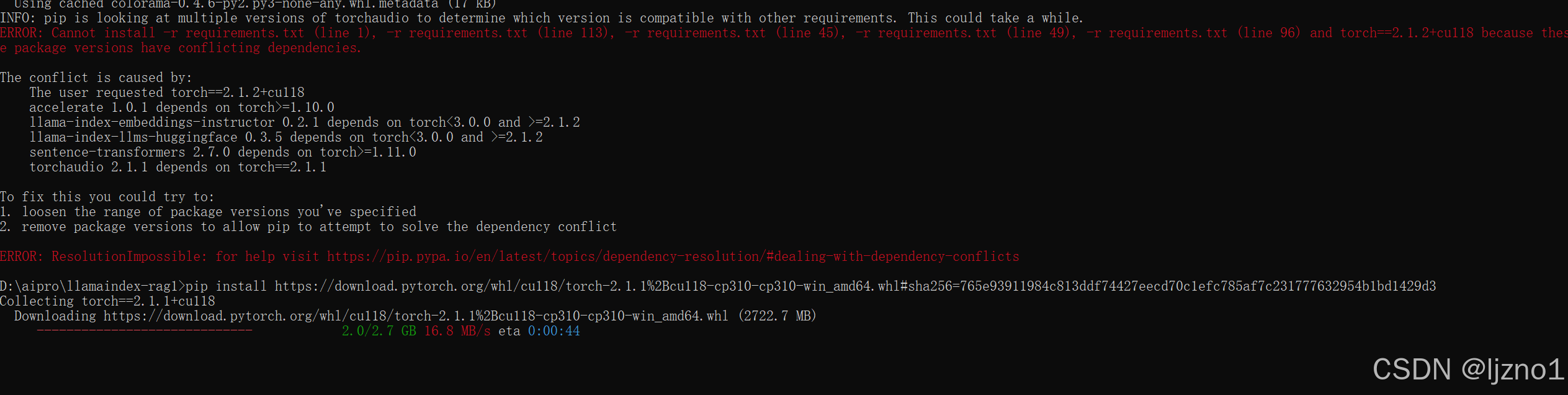

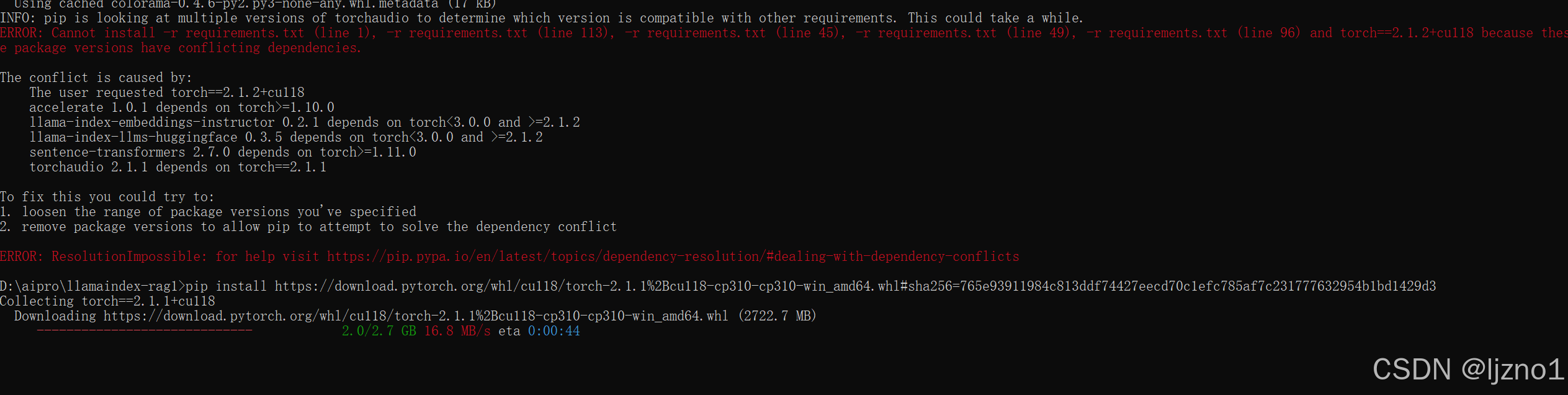

具体来说,某些包(如 accelerate, sentence-transformers, torchaudio 等)对 torch 的版本有不同的要求,导致无法同时满足所有依赖。torch>=2.1.2:确保与 llama-index-embeddings-instructor 和 llama-index-llms-huggingface 兼容。torch==2.1.1+cu118:这个版本可以

下载好后进入下载目录,执行pip install triton-2.1.0-cp310-cp310-win_amd64.whl。你是不是在找window版本的triton-2.1.0?进来往下看吧,免费版来了!triton官方只提供了Linux版本,本人试了多个版本都不行,试试。

使用了 `VectorStore` 和 `SearchRequest`,表明项目集成了向量数据库,用于语义搜索和检索增强生成(RAG, Retrieval-Augmented Generation)。- 使用了 `ChatClient` 和 `PromptChatMemoryAdvisor` 等组件,表明项目集成了 Spring AI 框架,用于构建聊天机器人功能。- 使用了 `Flux`,表明项

具体来说,某些包(如 accelerate, sentence-transformers, torchaudio 等)对 torch 的版本有不同的要求,导致无法同时满足所有依赖。torch>=2.1.2:确保与 llama-index-embeddings-instructor 和 llama-index-llms-huggingface 兼容。torch==2.1.1+cu118:这个版本可以

90%用户的电脑配置低,那要怎么本地部署化deepseek R1呢,如果你的DeepSeek只在CPU和内容中运行(显存占用很低)。或者是你不知道如何在本地部署DeepSeek,那么本篇文章将帮助你解决这个问题。本地部署后的特点是无需联网、使用丝滑、完全免费,从此告别服务器繁忙。下面以本人AMD普通显卡Radeon 780M本地部署DeepSeek R1为例,1. Ollama部署Ollama是一