简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

vs2013中的Qt5插件从Qt Project Settings中没有能引入QWebEngineView和QWebChannel的模块,我们可以在vs2013中手动加入。附加包含目录:(QTDIR)\include\QtWebEngineWidgets,(QTDIR)\include\QtWebEngineWidgets, (QTDIR)\include\QtWebChannel附加依赖项

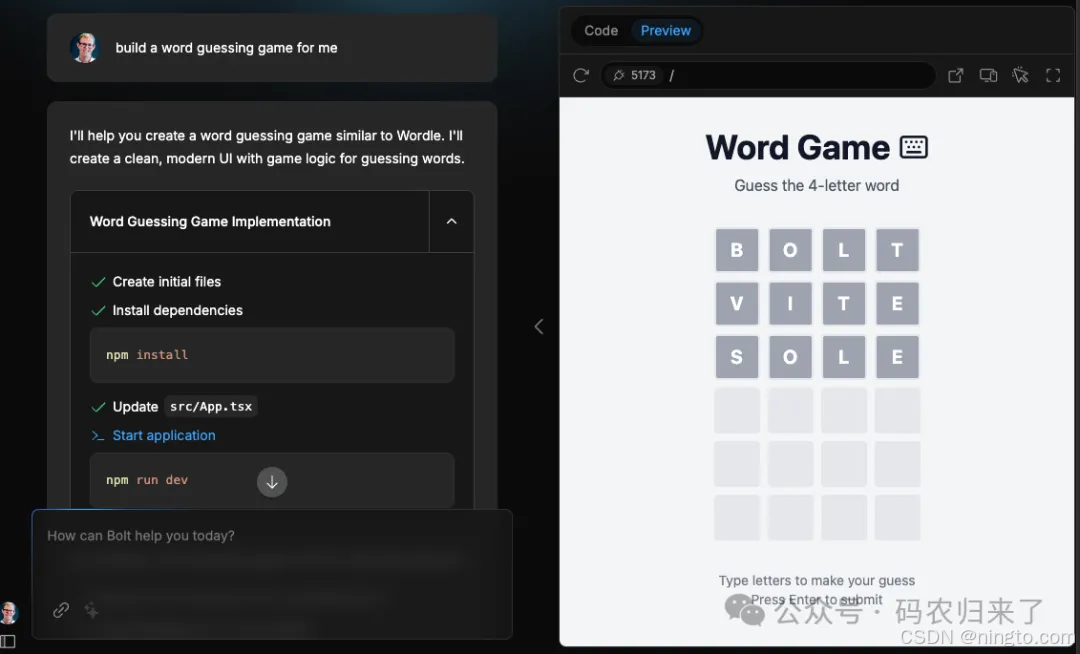

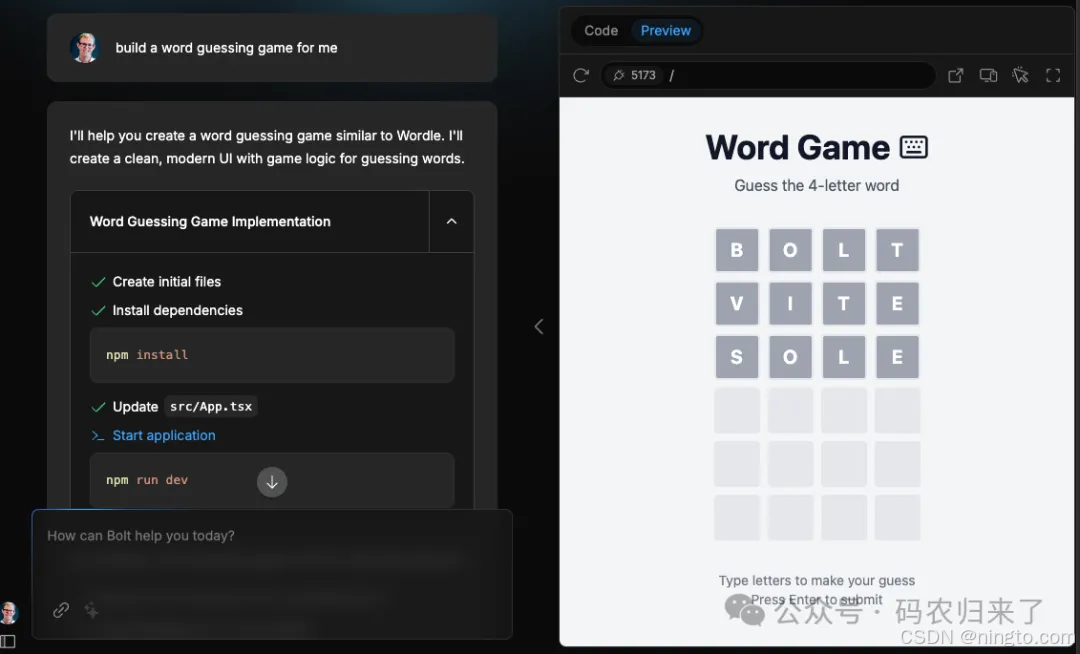

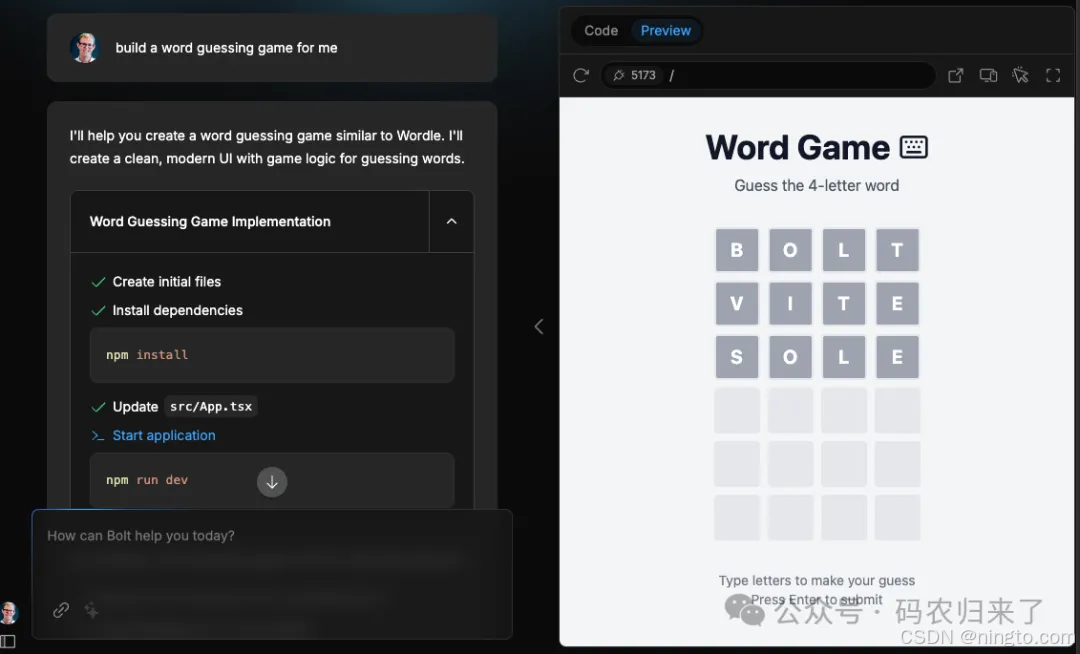

大型语言模型不仅受限于幻觉问题——它们从根本上缺乏对自身能力的认知,这使得它们在执行自己并不完全理解的任务时过于自信。虽然"氛围编程"拥抱了AI快速生成解决方案的能力,但真正的进步在于能够承认模糊性、寻求澄清并认识到自身局限的模型。模型开发的步伐已经有所放缓,一些人对最新的GPT4.5表示失望。然而,过度关注AGI竞赛和基准性能让我们看错了方向。大型语言模型(LLMs)最广为人知和理解的弱点是它们

大型语言模型不仅受限于幻觉问题——它们从根本上缺乏对自身能力的认知,这使得它们在执行自己并不完全理解的任务时过于自信。虽然"氛围编程"拥抱了AI快速生成解决方案的能力,但真正的进步在于能够承认模糊性、寻求澄清并认识到自身局限的模型。模型开发的步伐已经有所放缓,一些人对最新的GPT4.5表示失望。然而,过度关注AGI竞赛和基准性能让我们看错了方向。大型语言模型(LLMs)最广为人知和理解的弱点是它们

大型语言模型不仅受限于幻觉问题——它们从根本上缺乏对自身能力的认知,这使得它们在执行自己并不完全理解的任务时过于自信。虽然"氛围编程"拥抱了AI快速生成解决方案的能力,但真正的进步在于能够承认模糊性、寻求澄清并认识到自身局限的模型。模型开发的步伐已经有所放缓,一些人对最新的GPT4.5表示失望。然而,过度关注AGI竞赛和基准性能让我们看错了方向。大型语言模型(LLMs)最广为人知和理解的弱点是它们

windows系统中,需要vs2010+sp1或vs2012才支持。1.线程的创建C++11线程类std::thread,头文件include首先,看一个最简单的例子:void my_thread(){puts("hello, world");}int main(int argc, char *argv[]){std::thread t(my_threa

#pragma once#includestd::wstring hanzi2pinyin(const std::wstring &hanzi, const std::wstring &separator = L"");std::wstring retrievePinyin(wchar_t word);#include "hanzi2pinyin.h"#include

windows下一般建的是控制台应用程序,由于使用的库都是跨平台库的,所以移植起来也比较轻松。问题:msvcprtd.lib(MSVCP90D.dll) : error LNK2005: "public: __thiscall std::basic_string解决方法(alglib表示你使用的某一个库):This is more of a conflict between alg

C++程序有时候要读写XML文件, 这里介绍一个读写XML文件的库——Libxml2。主页:http://xmlsoft.org/index.html入门教程很详细的:http://jianlee.ylinux.org/Computer/C/libxml.html#sec11读取节点内容的话用XPath方式比较好,要问XPath与Libxml2库之间的关系,有个很形象的比喻:那就是

用过Qt的QHBoxLayout,QVBoxLayout再看flex布局有很多相似之处,特别要注意的是flex属性是flex-grow, flex-shrink 和 flex-basis的简写,默认值为0 1 auto,后面两个是可以省略的。当一个容器没有显示出来时要注意它应该设置宽高或者flex值是不是大于0。<!DOCTYPE html><html lang="en"><head>

每次调试运行都要先打开main.go然后在菜单里点击Run->Start Debugging或者F5比较麻烦,主要是每次都要定位了main.go文件,这样当我编辑完其他文件后,都要切换一下才能运行。下面增加一下Launch.json配置就可以直接点击左侧的debug按钮运行了,在Launch菜单下的Add Configuration,内容如下:{// Use IntelliSense to