简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

该项目解决了AI游戏中的三个关键问题:1) 通过引入类似DND的检定系统,用难度等级、属性和技能计算检定值,结合随机骰子产生四种结果(大成功/成功/失败/大失败),避免了AI随意迎合玩家;2) 重构世界观设计,将剧情分割为预设阶段并预制NPC,从而控制剧情长度和走向;3) 改进信息权重分配。项目已发布在GitHub,展示了改进后的效果截图和关键代码实现(包括属性检定函数和世界观阶段管理系统)。这些

本文介绍了一个实现AI间对话功能的实验性应用。通过设计两个核心类:Character类用于定义角色属性和对话方法;ChatBetweenAI类作为协调器管理多角色对话流程。Character类包含角色名称、提示词、对话历史等属性,并提供与其他角色交互的chat_to方法。ChatBetweenAI类支持多轮对话、历史修改、数据导入导出等功能,并记录token消耗情况。该系统通过维护对话历史和修改日

根据模型的数学原理进行简单的代码自我复现以及使用测试,仅作自我学习用。模型原理此处不作过多赘述,仅罗列自己将要使用到的部分公式。如文中或代码有错误或是不足之处,还望能不吝指正。

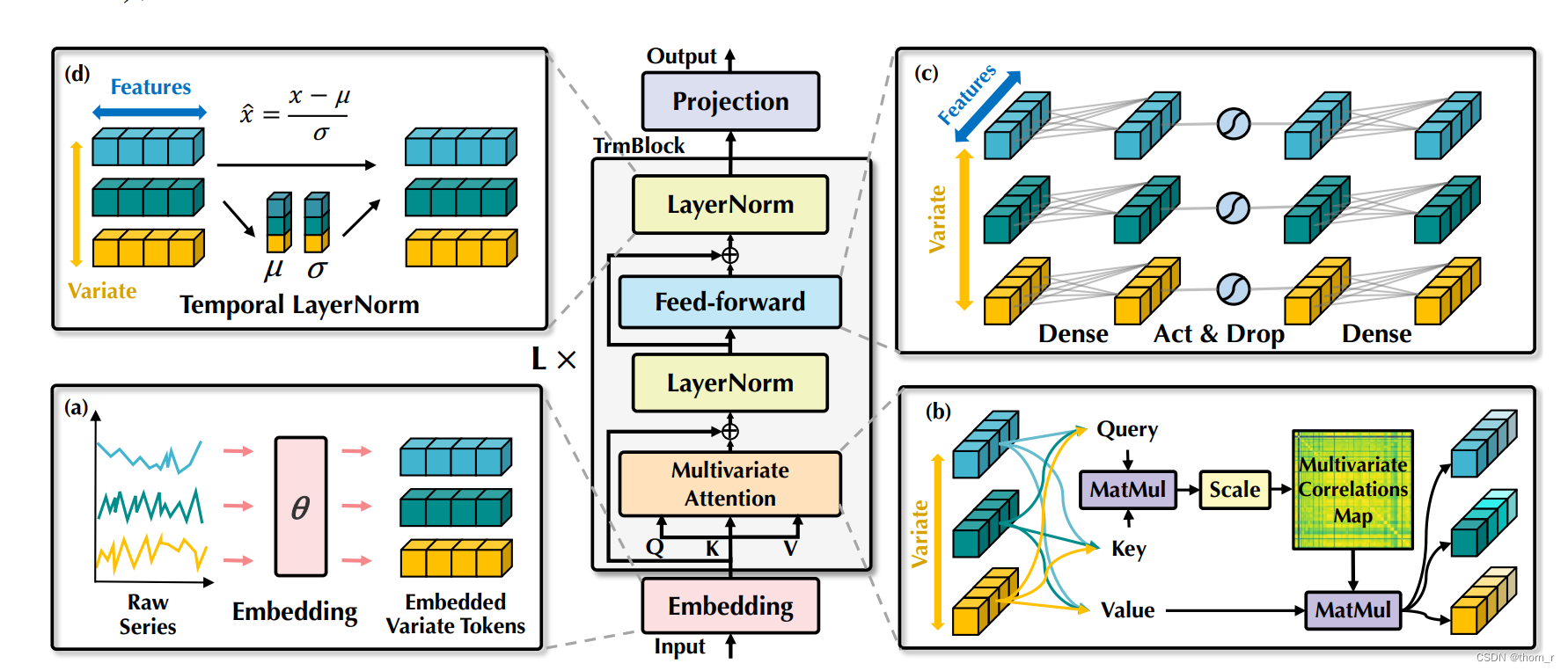

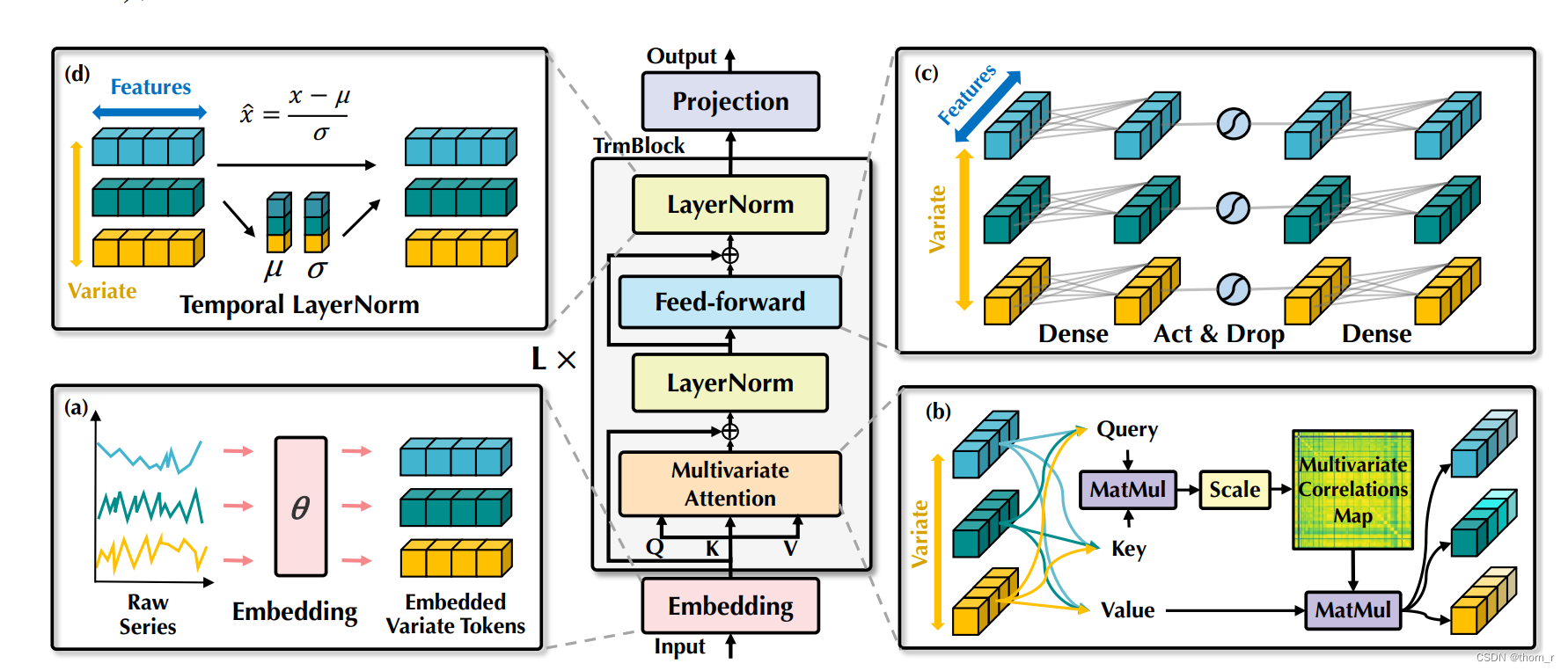

本文反思了为什么Transformer模型在时间序列预测的问题上没有传统的线性模型效果好。文章作者认为,Transformer并非不适合于时间序列预测任务,而是以往的研究者没有“正确使用”Transformer。在没有大改Transformer模型的情况下,通过将输入Embedding的进行转置,使得自注意力层与前向层所提取的特征进行了互换,经过试验发现无论是预测效果还是模型可解释性都大大提高了,

根据模型的数学原理进行简单的代码自我复现以及使用测试,仅作自我学习用。模型原理此处不作过多赘述。GRU属于RNN的一类,使用门控在一定程度上抑制了梯度消失的问题。在实际实现时,由于没有精力在数学层面上进行优化,这里使用梯度裁剪以及LayerNormalization以避免梯度爆炸以及过拟合。

摘要:本文介绍了一个基于MCP架构的AI角色扮演游戏系统设计。游戏采用服务端-客户端架构,服务端实现游戏核心逻辑和AI决策接口,客户端负责交互和渲染。系统包含动态世界观、NPC自治生态、"自我值"机制等创新设计,支持多世界切换、NPC交互、战斗等玩法。文章详细阐述了技术实现方案,包括API设计、AI决策流程和数据处理方法,同时指出了当前面临的NPC对话一致性、AI行为控制等技术

本文反思了为什么Transformer模型在时间序列预测的问题上没有传统的线性模型效果好。文章作者认为,Transformer并非不适合于时间序列预测任务,而是以往的研究者没有“正确使用”Transformer。在没有大改Transformer模型的情况下,通过将输入Embedding的进行转置,使得自注意力层与前向层所提取的特征进行了互换,经过试验发现无论是预测效果还是模型可解释性都大大提高了,

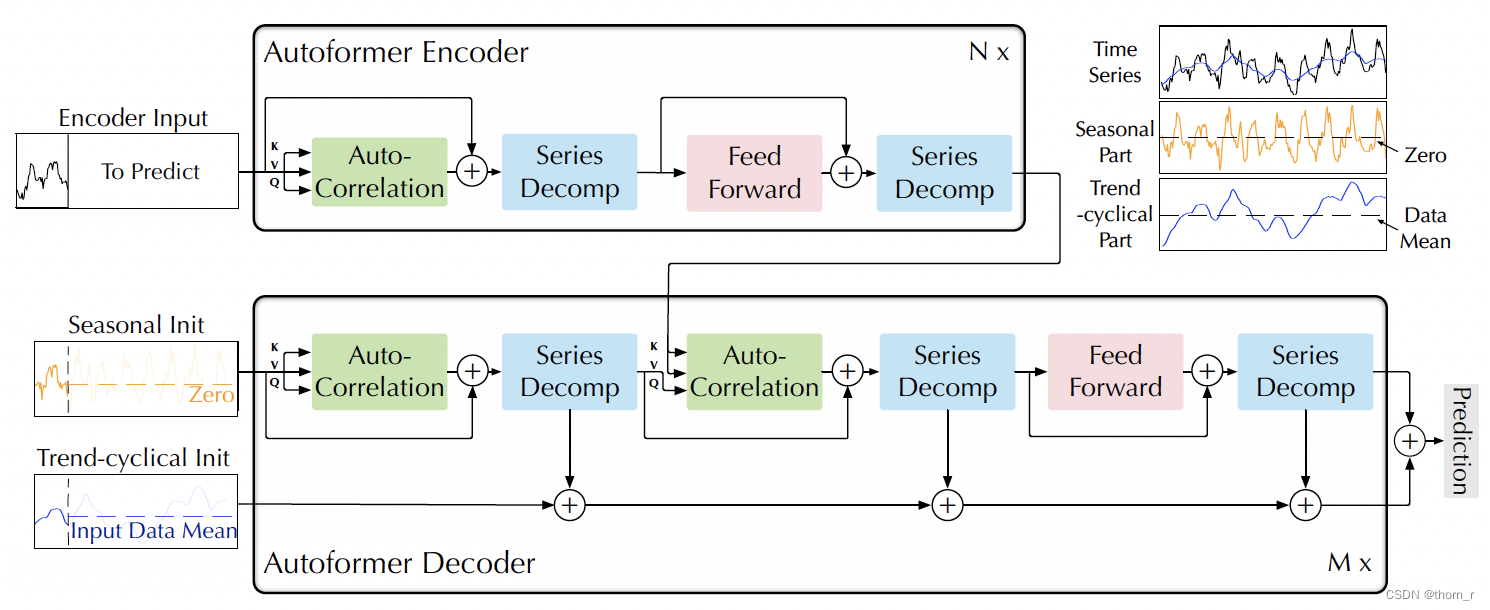

原本想要和之前一样写作“代码复现”,然而由于本人一开始对于Autoformer能力理解有限,参考了一定的论文中的源代码,写着写着就发现自己的代码是“加了注释版本”的源代码,故而只能是源代码的浅读,而非复现。

根据模型的数学原理进行简单的代码自我复现以及使用测试,仅作自我学习用。模型原理此处不作过多赘述。GRU属于RNN的一类,使用门控在一定程度上抑制了梯度消失的问题。在实际实现时,由于没有精力在数学层面上进行优化,这里使用梯度裁剪以及LayerNormalization以避免梯度爆炸以及过拟合。

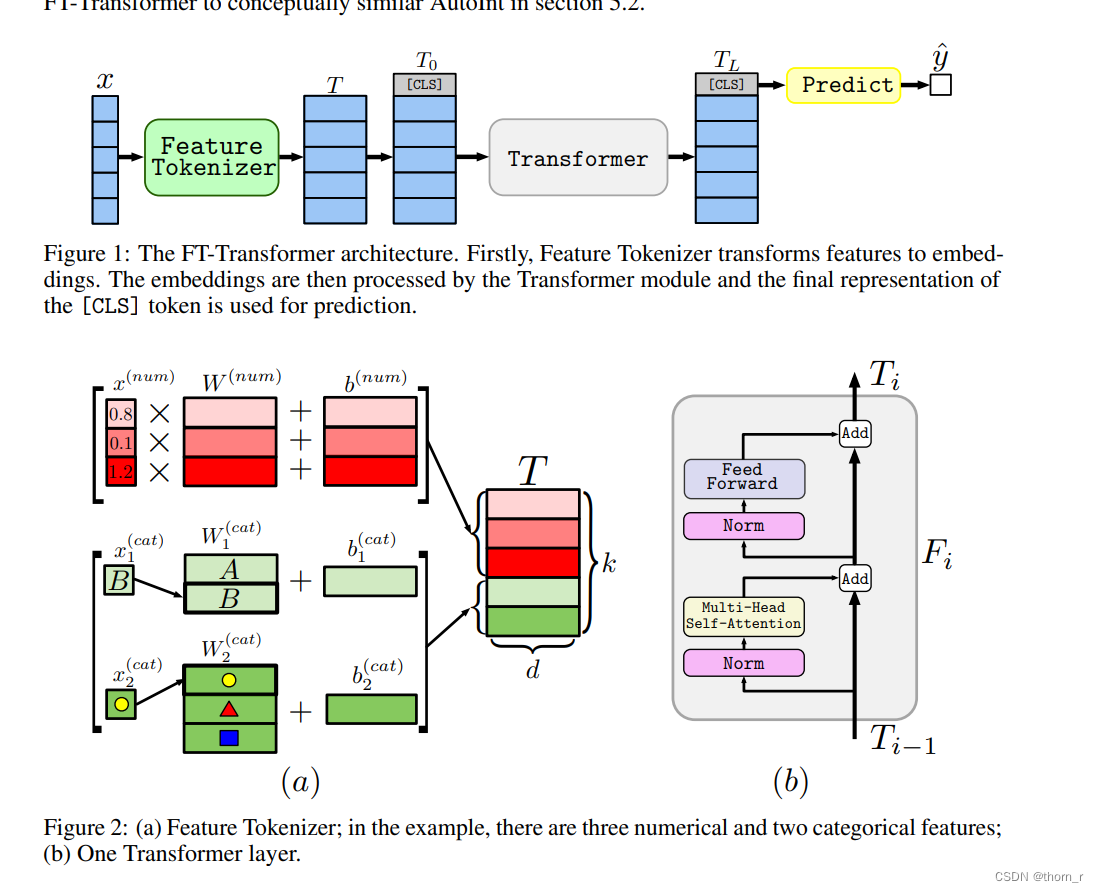

现有的关于表格数据做深度学习的模型层出不穷,但是作者认为,由于在真实使用模型时有着不同的基准以及实验场合,这些提出的模型没有被很好地比较。因此,论文作者在论文中对各类模型进行了综述,并且自身提出了一个对Transformer作简单改进的模型:FT-Transformer,最终将ResNet-like类模型、Transformer-like类模型以及其他MLP模型在不同的数据集上训练、对比效果,最终