简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文系统解析了大模型开发中的四个核心概念:FunctionCall(原子执行单元)、Tools(可调用功能集合)、MCP(统一调用协议)和Skill(业务能力封装)。文章通过定义解析、特点对比和实际案例,阐明四者的层级关系与适用场景:FunctionCall实现底层操作,Tools整合相关功能,MCP标准化调用流程,Skill封装完整业务。强调四者应协同使用而非互相替代,并指出常见误区。开发时应根

本文介绍了如何使用阿里ModelScope平台和LLaMAFactory框架微调大语言模型Qwen3-4B。主要内容包括:1)在ModelScope免费实例中配置环境;2)准备包含身份信息和问答的中英文数据集;3)配置训练参数(如学习率、训练轮数等);4)下载Qwen3-4B模型并进行LoRA微调;5)测试微调后模型效果;6)将微调权重合并到基础模型中。整个流程耗时约15分钟,最终模型能准确回答关

本文介绍了微调后大模型的部署方法:1. 使用llama.cpp将HF格式模型转换为GGUF格式;2. 通过llama.app以CLI或Server模式部署模型;3. 尝试ollama部署遇到Qwen3模型不兼容问题;4. 演示了将GGUF模型上传至ModelScope平台并下载的完整流程。文章提供了从模型转换到实际部署的具体操作指南,重点介绍了llama.cpp工具链的使用方法。

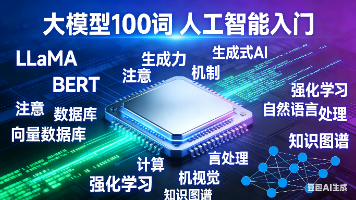

【摘要】本文系统梳理了大模型领域的100个核心术语,基于B站视频《一小时从函数到Transformer》P7章节内容整理。词汇表严格遵循视频讲解顺序,涵盖基础理论(函数、符号主义/连接主义)、技术架构(Transformer、RLHF)、模型类型(GPT、Llama)、应用生态(RAG、智能体)及开发工具(Pytorch、CUDA)等全维度知识。每个词条均附原视频释义,如"涌现"

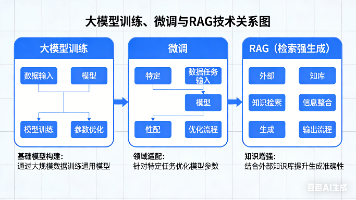

本文对比分析了大模型训练、微调和RAG三大技术的核心差异与应用场景。训练从零构建通用大模型,成本高周期长;微调通过参数优化适配特定领域,需标注数据;RAG通过外部知识库增强生成,灵活可追溯。当前主流采用"轻微调+RAG"混合架构,兼顾领域适配性和知识实时更新。建议企业根据资源与需求选择技术路径,优先考虑RAG和轻量微调,结合模型量化实现高效部署。三大技术互补共生,混合应用可最大

Ollama+DeepSeek+AnythingLLM 搭建本地智能体