简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

WaveNet 是DeepMind 提出的一种深度学习声码器,2016 年 9 月的一篇论文中进行了概述[1],旨在能够直接从原始音频数据生成语音。WaveNet 最初是为了改进传统的文本到语音(TTS)系统的语音质量提出的,其采用卷积神经网络生成音频波形,实现了比传统方法更自然的声音。WaveNet 的主要挑战在于需求巨大的计算资源,这使得它在实际应用中受到了限制。

深度学习技术已经在语音、图像、视频、文本等领域应用广泛,其和强化学习的结合使得基于深度学习的大模型能力更是上升一个台阶。因而用在腿足机器人的运动中枢上也不足为奇,但是和电子化格式的语音、图像、文本而言,机器人的运动姿态涉及到真实的物理世界,要符合物理规律和宏观力学定律。

深度学习是人工智能的子集,深度学习模仿人脑处理数据的神经通路,将其用于决策、检测对象、识别语音和翻译语言。它从非结构化和未标记的数据中学习,无需人工监督或干预。深度学习通过使用人工神经网络的层次结构来处理机器学习,人工神经网络的构建类似于人脑,神经元节点在网络中连接。虽然传统的机器学习程序使用线性数据分析,但深度学习的分层功能允许机器使用非线性方法处理数据。Keras vs Tensorflow

开源情感TTS技术主要分为四类:基于参考音频的风格迁移(如VITS)、基于文本提示的生成(如Bark)、基于离散标签的控制(如Tacotron2改进模型)和基于扩散模型的风格建模(如StyleTTS2)。各类方法需要不同的数据集支持:风格迁移需多说话人数据集(LibriTTS、VCTK)和情感数据集(ESD、RAVDESS);文本提示生成依赖富文本标注数据(NonverbalTTS、AudioCa

近年来,深度学习推动了文本转语音(TTS)技术的显著进步,能够生成高度逼真且可控的语音。高质量、大规模且多样化的数据集是训练先进TTS模型的基础。TTS数据集需要包含音频-文本校对、时间对齐、元数据等,以捕捉语音的细微差别。数据集的构建涉及语言学、信号处理和数据科学,是TTS系统开发的核心环节。数据增强策略如噪声注入、音高变换等,可提高模型泛化能力。数据预处理中的采样率统一、文本规范化和声学特征提

ALSA下音频架构ALSA是什么

写在前面的话: 本人发现有三家网站转载了本人文章,除了xilinx(赛灵思)中文社区有联系我转载事宜,请未通知我的网站将转载信息注视在文章开篇,谢谢~!本篇是AXI DMA在linux下使用的例子。包括PL端设计,基于vivado 2015.4,petalinux 2016.1,基于linux 4.4内核。1.PL端设计:PL端设计包括四个AXI DMA IP,它们分别和zyn

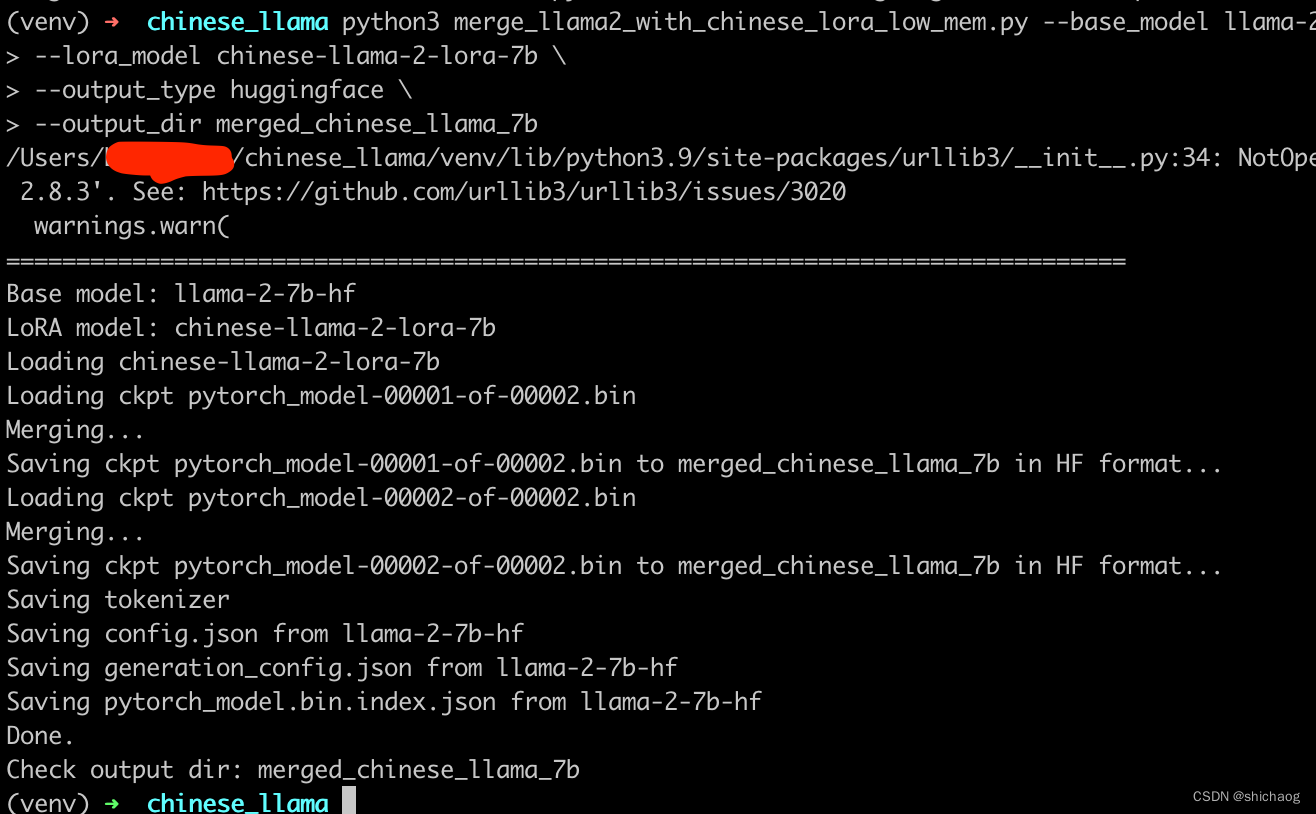

在《》一文中已经扩充好了中文词汇表,接下来就是使用整理的中文语料对模型进行预训练了。这里先跳过预训练环节。先试用已经训练好的模型,看看如何推理。

近年来,深度学习推动了文本转语音(TTS)技术的显著进步,能够生成高度逼真且可控的语音。高质量、大规模且多样化的数据集是训练先进TTS模型的基础。TTS数据集需要包含音频-文本校对、时间对齐、元数据等,以捕捉语音的细微差别。数据集的构建涉及语言学、信号处理和数据科学,是TTS系统开发的核心环节。数据增强策略如噪声注入、音高变换等,可提高模型泛化能力。数据预处理中的采样率统一、文本规范化和声学特征提