简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

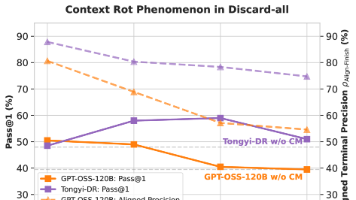

AgentSwing:长时Web Agent上下文管理的自适应路由方法 本文针对长时Web Agent在复杂搜索任务中面临的"上下文腐烂"问题,提出了一种创新的自适应路由方案。传统方法如保留最近N轮、摘要压缩或全部丢弃等静态策略,在效率和精度之间存在固有矛盾。AgentSwing通过并行执行多种上下文管理策略,并前瞻性地评估各分支的未来表现,实现了动态最优策略选择。实验表明,该

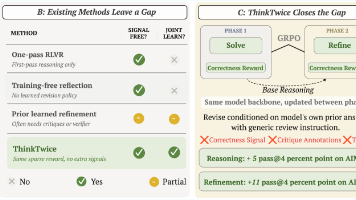

你有没有碰到过这种情况——让模型做完一道数学题后,再让它"检查一下自己的答案",结果它不但没改对,反而把原来对的答案给改错了?这个问题其实挺普遍的。GPT-5.2在AIME 2024上做refinement的时候,pass@4从90.0%降到了86.7%——你没看错,越检查越差。模型的self-refinement(自我纠错)一直是个悖论:我们希望模型能"三思而后行",但现实是它经常"三思而后废"

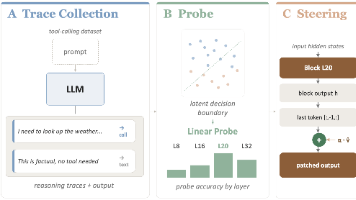

论文摘要(≤150字) 研究发现推理模型在生成思维链前已做出决策。通过线性探针检测发现,模型在未输出任何token时(pre-gen状态)隐藏层即可高精度预测最终工具调用决策(AUROC>0.9)。激活引导实验显示,干扰预决策信号可使7-79%样本反转决策,而模型的思维链会为新决策"合理化"而非抵抗。这表明链式推理(CoT)可能更多是决策的事后解释而非真实推理过程,对依赖

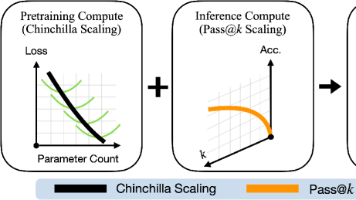

文章摘要:当推理预算纳入考量,过度训练小模型才是最优解 传统Chinchilla法则认为每个参数应对应约20个token,但最新研究发现这一法则已过时。威斯康星大学和斯坦福的研究表明,当考虑推理阶段的计算开销(如多次采样)时,过度训练小模型才是数学上的最优解。他们提出的T² Scaling Laws将模型大小、训练token数和推理采样次数联合优化,证明在相同总算力下,过度训练的小模型配合多次采样

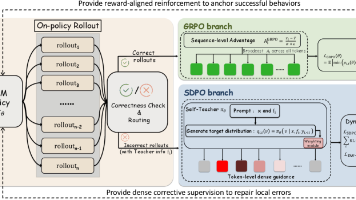

LLM 后训练(post-training)中,GRPO 和 SDPO 各有软肋:GRPO 信号太粗(sequence-level reward 广播到每个 token),SDPO 长时间训练会崩溃(self-teacher 信号退化)。SRPO 的核心idea是按样本正确性做路由——答对的样本用 GRPO 做奖励强化,答错的样本用 SDPO 做 token 级纠错蒸馏,再加一个熵感知的动态加权来

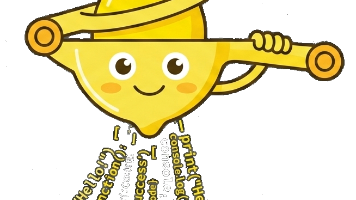

Squeez摘要(145字) 这篇论文提出Squeez方法,解决Coding Agent工具输出冗余问题。通过训练2B小模型,在工具输出进入Agent前精准裁剪无关内容。实验表明: 高效裁剪:在11,477样本的benchmark上,砍掉92%输入token的同时保持0.86召回率 超越大模型:比Qwen 35B零样本表现高11个百分点 实用价值:覆盖27种工具类型,特别擅长处理type_chec

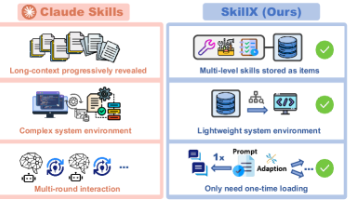

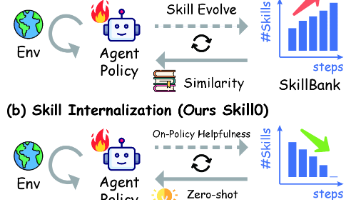

SkillX 提出了一套全自动的技能知识库构建框架,核心思路是把 Agent 的执行轨迹分层蒸馏为三级技能(规划技能、功能技能、原子技能),然后通过迭代精炼和探索性扩展不断丰富这个技能库。关键效果:在 Qwen3-32B 上,BFCL-v3 的 Avg@4 从 53.67 涨到 63.67,AppWorld 从 27.68 涨到 35.12。更有意思的是,弱模型可以直接用强模型提炼出的技能库,实现

《Skill0:通过上下文强化学习实现技能内化》摘要 浙江大学与美团联合团队提出Skill0框架,创新性地解决了当前LLM Agent技能增强中存在的三大痛点:检索噪声、token开销高和技能未真正内化。该方法采用三步走策略:首先对技能进行任务类别分组,然后通过视觉化上下文强化学习训练模型,最后采用动态课程逐步减少技能依赖直至零样本推理。实验表明,在ALFWorld任务中,Skill0比标准RL基

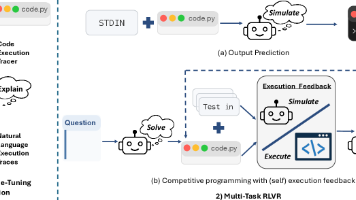

本文提出了一种让代码模型"脑内编译"的新方法,通过自然语言执行轨迹监督训练和强化学习,使模型能够在不实际执行代码的情况下预测程序输出。实验表明,该方法显著提升了模型预测代码执行结果的准确率,其中7B模型预测准确率从34%提升至75.5%,超过许多更大规模的模型。在竞赛编程任务中,该方法将pass@1从49.0%提升至63.2%,接近真实执行的上限65.3%。这一突破解决了代码模

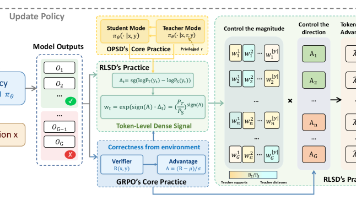

RLSD:融合自蒸馏与强化学习的token级信用分配新方法 这篇论文提出RLSD方法,巧妙结合了自蒸馏的细粒度信号与强化学习的可靠方向指引。针对GRPO方法在token级信用分配上的不足,以及OPSD存在的特权信息泄露问题,RLSD通过让环境奖励决定更新方向、自蒸馏差异决定更新幅度,实现了更精准的token级优化。实验表明,在Qwen3-VL-8B模型上,RLSD在5个多模态推理基准上平均准确率达