简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

最近30天在HF和ollama有2190次模型下载,4月发布G1f

2024年7月19日,RWKV 开源基金会宣布正式向全球开源 RWKV-6-World-14B 模型。RWKV-6-World-14B 是迄今最强的稠密纯 RNN 大语言模型。

Ollama现已支持RWKV7-G1和RWKV-7-World模型系列,用户可通过简单命令安装并运行这些模型。操作步骤包括下载Ollama、安装后运行指定模型命令,支持对话模式切换和上下文管理。推荐使用RWKV7-G1系列模型,还提供了RWKV Chat应用作为替代选择。用户可访问RWKV中文官网和社区获取更多资源与支持。

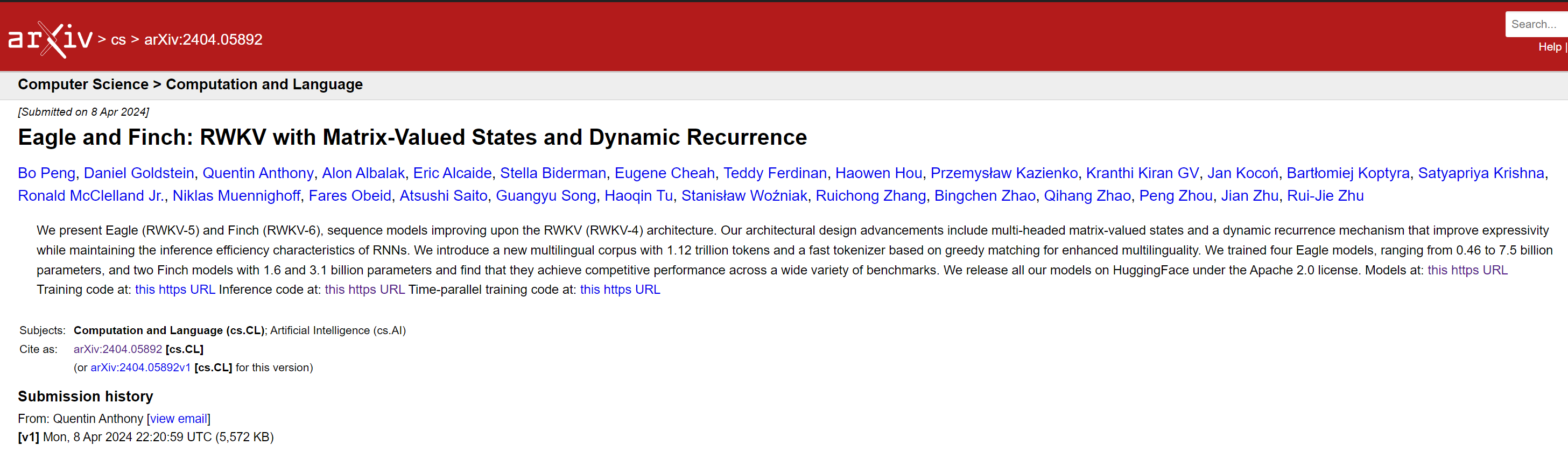

RWKV 新架构:Eagle (RWKV-5) 和 Finch (RWKV-6),在 RWKV-4 架构的基础上进行了改进

2025年2月22日,RWKV在上海漕河泾举办了主题为《RWKV-7与未来趋势》的开发者大会。来自全国各地的开发者、行业专家和技术创新者齐聚一堂——从知名高校实验室到前沿创业团队,现场涌动的创新能量印证了RWKV-7的优秀性能和深远意义。在RWKV开发者大会期间,有多位来自学界、企业及RWKV开源社区的嘉宾为开发者带来深度分享,现场观众与嘉宾热烈互动。

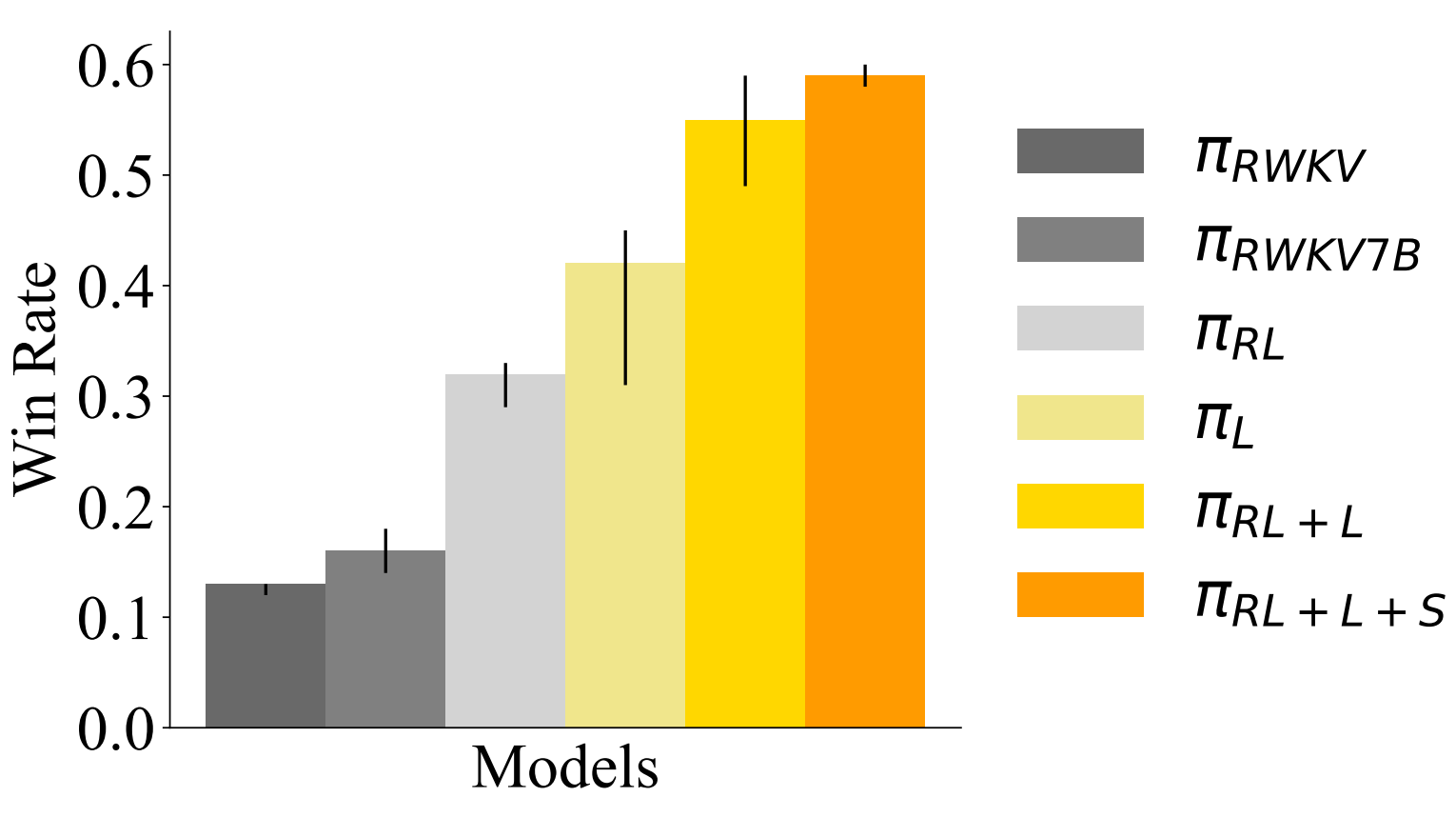

近日 RWKV 生态新增来自海外名校的两项工作:Stanford(斯坦福大学)团队的 RWKV 多智能体研究,和 UVa(弗吉尼亚大学) 团队的 RWKV 端侧优化研究。

Ollama现已支持RWKV7-G1和RWKV-7-World模型系列,用户可通过简单命令安装并运行这些模型。操作步骤包括下载Ollama、安装后运行指定模型命令,支持对话模式切换和上下文管理。推荐使用RWKV7-G1系列模型,还提供了RWKV Chat应用作为替代选择。用户可访问RWKV中文官网和社区获取更多资源与支持。

PENG Bo发表关于大模型的认知的观点,同月发布RWKV7+ROSA完成数字颠倒任务Demo

在 Uncheatable Eval 超越 Qwen3 14B。近期也更新了 1B 和 3B 模型。

2025年8月,RWKV社区迎来多项重要进展:模型方面,开源发布RWKV-7s 0.1B版本,并启动了13.3B大模型的训练,在三分之一进度时MMLU测试已达63.21%。学术研究取得突破,5篇新论文发表于IEEE TCCN、Interspeech等顶级期刊会议,涵盖4G/5G服务预测、语音识别、骨签匹配、图像超分辨率等多个领域。社区还参与了全球互联网大会,展示了RWKV技术的最新应用成果。这些进