简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

当文档被添加到知识库之后,文件会被切分为若干个片段,然后这些片段会交给嵌入模型进行处理,当使用DeepSeek进行问答的时候,会查询相关的文本片段,一并交给DeepSeek处理。另外,知识库的文档如果在云上,对于数据比较敏感的人和公司来说可能是个隐患,这时候搭建一个本地的知识库就尤为重要了。然后在“知识库”,选择“添加”,添加自己的知识库,并且在嵌入模型,选择刚才配置的bge-m3。然后回到对话界

企业对算力的需求,促进了算力平台的发展,天罡智算平台(https://www.tiangangaitp.com)就是其中的佼佼者:提供弹性GPU算力,灵活选择GPU类型和数量,按需动态使用,打破固定时长租期的束缚,只需为实际使用的资源付费。除了算力,还提供镜像、存储服务等一系列配套服务,并对完成实名认证的企业客户,提供4090 GPU 50个卡时的免费使用优惠。然而,进入第三季度后,租赁报价开始出

企业对算力的需求,促进了算力平台的发展,天罡智算平台(https://www.tiangangaitp.com)就是其中的佼佼者:提供弹性GPU算力,灵活选择GPU类型和数量,按需动态使用,打破固定时长租期的束缚,只需为实际使用的资源付费。据悉,2026年后规划的昇腾920(或称910D)将采用“矩阵 + 向量 + 线程 + CCU”复合架构,增强对稠密与稀疏张量运算、矩阵计算及高速通信的支持,从

点击5090或4090卡的图片,在页面的右侧,会显示5090或4090卡的详情,当前支持按照卡时计费,根据实际使用量,先使用后付费。根据您的算力需求量,一个容器支持挂载1、2、4、8个5090或4090卡。在天罡智算的官网(https://tiangangaitp.com/gpu-market)完成注册和登录后,点击菜单“弹性GPU”,在弹性GPU的页面,就可以看到5090卡和4090卡。- 《G

企业对算力的需求,促进了算力平台的发展,天罡智算平台(https://www.tiangangaitp.com)就是其中的佼佼者:提供弹性GPU算力,灵活选择GPU类型和数量,按需动态使用,打破固定时长租期的束缚,只需为实际使用的资源付费。RTX 4090 所采用的 Ada Lovelace 架构与数据中心 H100/H200 属同一代技术,配备第四代 Tensor Core 和光流加速器,在 F

该白皮书指出,全球数字技术智能化、泛在化变革之际,鸿蒙智能体是重大创新成果。它构建起 “以人为中心” 的操作系统新范式,借分布式架构与原子化服务,实现跨终端、场景的智能协同。通过开源 OpenHarmony,联合超 5000 家伙伴打造全球第三大智能终端生态圈,保障国家数字主权安全可控。其框架 HMAF 涵盖智能体全新交互,像系统级入口、小艺系统智能体入口等;升级智能体协议,定义交互规范;当下,超

学弟更夸张,之前用笔记本跑7B参数的对话模型,生成一段200字回答要等10秒,用4090跑直接压缩到1.5秒,连说“早知道有这好事,之前熬夜调参都能少掉点头发”。更省心的是环境配置——之前租其他平台的卡,光装PyTorch、CUDA驱动就折腾1小时,这次打开实例一看,常用的深度学习框架全预装好了,连StableDiffusion、LLaMA2的基础镜像都有,选好镜像开机就能跑代码,我学弟用它跑图像

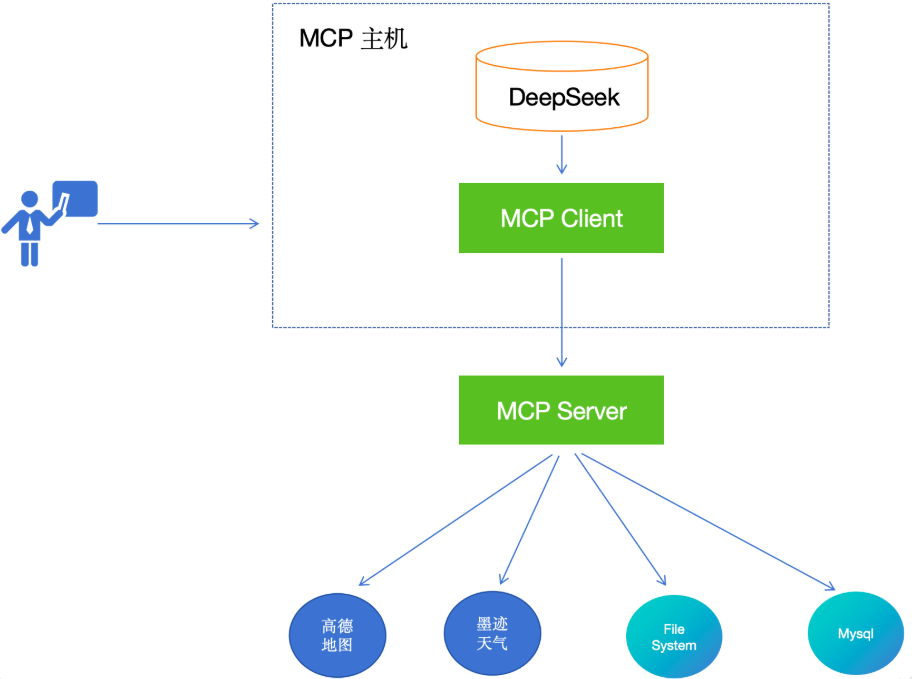

DeepSeek已经支持了MCP,今天这篇文章,我就给大家介绍一下,在Cherry Studio客户端里面使用MCP服务,让DeepSeek不但只会“动口”,而且也会“动手”。通过这些例子,可以发现,MCP的确可以让大模型调用各种工具,解决了大模型“只能动嘴不能动手”的难题,扩展了大模型的能力,让大家距离拥有一个贴身的全能AI助手又近了一步。在对话界面的下方,点击“MCP服务器”的图标,然后点击“

这种探索的价值在于,它没有回避“国产算力暂时不及国际顶尖”的现实,而是用“适配+优化”的思路解决当下问题——就像R2面临的“算力不达标”,或许不用非要等进口芯片供应恢复,通过天罡智算这类平台对国产算力的深度挖掘,再结合算法协同技术,也能找到性能与资源的平衡点。算力不够,算法来补。但熟悉AI行业的人都知道,这种“不满意”背后藏着更现实的困境——毕竟去年DeepSeekR1能出圈,核心原因就是它精准适

中国信通院发布的此报告极具价值。在发展概述方面,智能体作为人工智能高阶应用形态,能感知、决策、执行,正重塑创新生态,推动人工智能原生应用建设。关键技术上,它通过多模态交互等技术,破解大模型 “有脑无手” 困局,MCP、A2A 等通信协议降低系统集成复杂性。产业应用中,智能体从探索走向场景深耕,如制造业预测性维护、金融业实时风控等场景已验证其价值。免费完整版报告可至天罡智算官网(https://ti