简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

在深度学习模型的训练过程中,参数初始化往往被视为决定模型“生死”的第一步。不合理的初始化策略极易引发梯度消失、梯度爆炸或模型输出NaN等顽疾,导致模型无法收敛。本文立足于2026年深度学习工业界的最新实践标准,深入剖析PyTorch框架下Transformer等大模型的参数初始化核心机制。文章不仅系统梳理了Xavier、Kaiming等经典初始化方法的数学原理与适用场景,更重点解读了如何利用PyT

CIFAR-10是一个经典的图像分类数据集,包含60,000张32×32彩色图像,分为10个类别(如飞机、汽车、鸟类等)。数据集分为50,000张训练图像和10,000张测试图像,常用于机器学习模型的开发和评估。PyTorch提供了CIFAR10类,支持自动下载和图像预处理,通过transform参数可将PIL图像转换为模型所需的Tensor格式,并进行数据增强(如随机翻转、裁剪等)。该数据集因图

机器学习分类任务中,精确率、准确率和召回率是核心评估指标。准确率衡量整体预测正确率,适用于均衡数据;精确率关注预测正类的可靠性,强调减少误报;召回率评估查全能力,注重减少漏报。三者各有侧重,F1分数则综合了精确率和召回率。以癌症检测为例,即使准确率高,仍需关注召回率(避免漏诊)和精确率(减少误诊)。不同场景应选择合适的指标进行评估。

本文介绍了使用神经网络预测二手手机价格区间的分类问题。首先通过数据分析确定20个特征参数与4个价格区间(0-3)的关系,然后构建了一个包含批量归一化、ReLU激活和Dropout正则化的三层全连接网络模型。模型采用PyTorch实现,包含128和256个节点的两个隐藏层,最终输出4个类别的预测结果。文中详细展示了数据预处理、模型架构设计和参数初始化过程,并提供了模型结构可视化方法。该方案通过分类而

在NLP实战中,很多初学者习惯用 Jieba 或简单的空格切分来处理英文文本,这不仅不符合英文分词规范,还会导致后续模型效果大打折扣。本文以构建汉译英机器翻译数据为目标,系统总结了使用 NLTK 进行英文预处理的正确方式与深度实践。文章从 NLTK 的核心能力出发,重点解决了 punkt_tab 离线下载时的各类报错(从 getaddrinfo failed 到 punkt_tab 无法读取),深

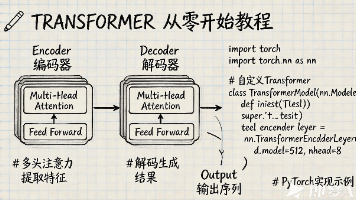

本文深入解析了 Transformer 模型在代码实现中的关键易混点:明确区分了编码器-解码器词嵌入层需要独立(因词汇表不同),而位置编码通常共享(因位置是通用数学概念)的核心原理。文章进一步结合 PyTorch,从零手写了 nn.Sequential 容器解析、多头注意力、子层连接等所有组件,并最终搭建出可直接运行的完整 Transformer 模型,适合作为深度学习底层实现的学习参考。

GRU简介:门控循环单元 GRU(Gated Recurrent Unit)是一种改进的循环神经网络,通过门控机制动态控制信息流动,解决了传统RNN的长期依赖问题。其核心特点包括: 门控机制:使用更新门和重置门选择性地保留或遗忘信息,增强模型记忆能力。 简化结构:相比LSTM,GRU合并细胞状态和隐藏状态,减少参数数量,提升计算效率。 应用场景:适用于自然语言处理、语音识别、时间序列预测等任务,在

循环神经网络(RNN)是一种专为处理序列数据设计的神经网络,通过引入循环连接使网络具有"记忆"能力。RNN的核心思想是利用隐藏状态传递历史信息,适用于自然语言处理、语音识别、时间序列预测等场景。与传统前馈神经网络不同,RNN能够处理输入数据间的时序依赖关系。但RNN存在梯度消失和梯度爆炸问题,难以学习长期依赖关系,这促使了LSTM、GRU等改进模型的出现。RNN虽然逐渐被Tra

全连接神经网络的输入输出通常为二维张量(batch_size × num_features),相当于处理表格数据(行=样本,列=特征)。虽然PyTorch的nn.Linear支持更高维输入(最后一维需匹配in_features),但基础场景下建议保持二维形式。图像/文本等非表格数据需先展平为二维。初学者应始终保留batch维度,避免使用一维输入。 "维度"在不同语境下含义不同:

摘要:nn.SmoothL1Loss是一种结合L1和L2优点的回归损失函数,对异常值鲁棒且处处可导。数学上,当误差小于beta(默认1.0)时采用平方项(L2),否则采用绝对值项(L1)。输入需为相同形状的浮点张量,输出可通过reduction参数控制。特别强调,"logits"仅适用于分类任务,回归任务中应称模型输出为"预测值"。代码示例展示了损失计算和梯