简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

JSON Schema 很擅长定义"什么是合法的",但不擅长表达"怎么用才对"。},},due_date该用2026-01-23还是?是 UUID 还是USR-12345格式?什么时候需要填contact信息?escalation参数和priority有什么关联?这三个功能,本质上是在回答同一个问题:当 Agent 的能力边界不断扩展,如何让它在"无限工具库"中依然保持高效和精准?从"全塞进去"走

这段代码同样旨在解决 “零钱兑换” 问题,但它采用的是一种 自底向上(Bottom-Up)的动态规划 方法,也称为 迭代法 或 制表法 (Tabulation)。这种方法通过构建一个DP表,从最小的子问题开始,逐步计算出最终的解,避免了递归的开销。该实现方式是解决完全背包问题的标准二维DP模型。问题模型:完全背包状态定义与索引映射DP表的计算返回结果时空复杂度时间复杂度:O(N * Amount)

上下文工程代表了我们基于大模型构建应用方式的根本性转变。随着模型能力增强,核心挑战已经不再是"写一个完美的提示词",而是在每一步中精心筛选哪些信息能进入那有限的"注意力预算"。寻找最小的、高信噪比 token 集合,最大化实现预期结果的概率。Anthropic 观察到,更智能的模型需要的"规约式工程"越来越少,Agent 的自主性越来越高。无论模型能力提升到何种程度,将上下文视作一种宝贵且有限的资

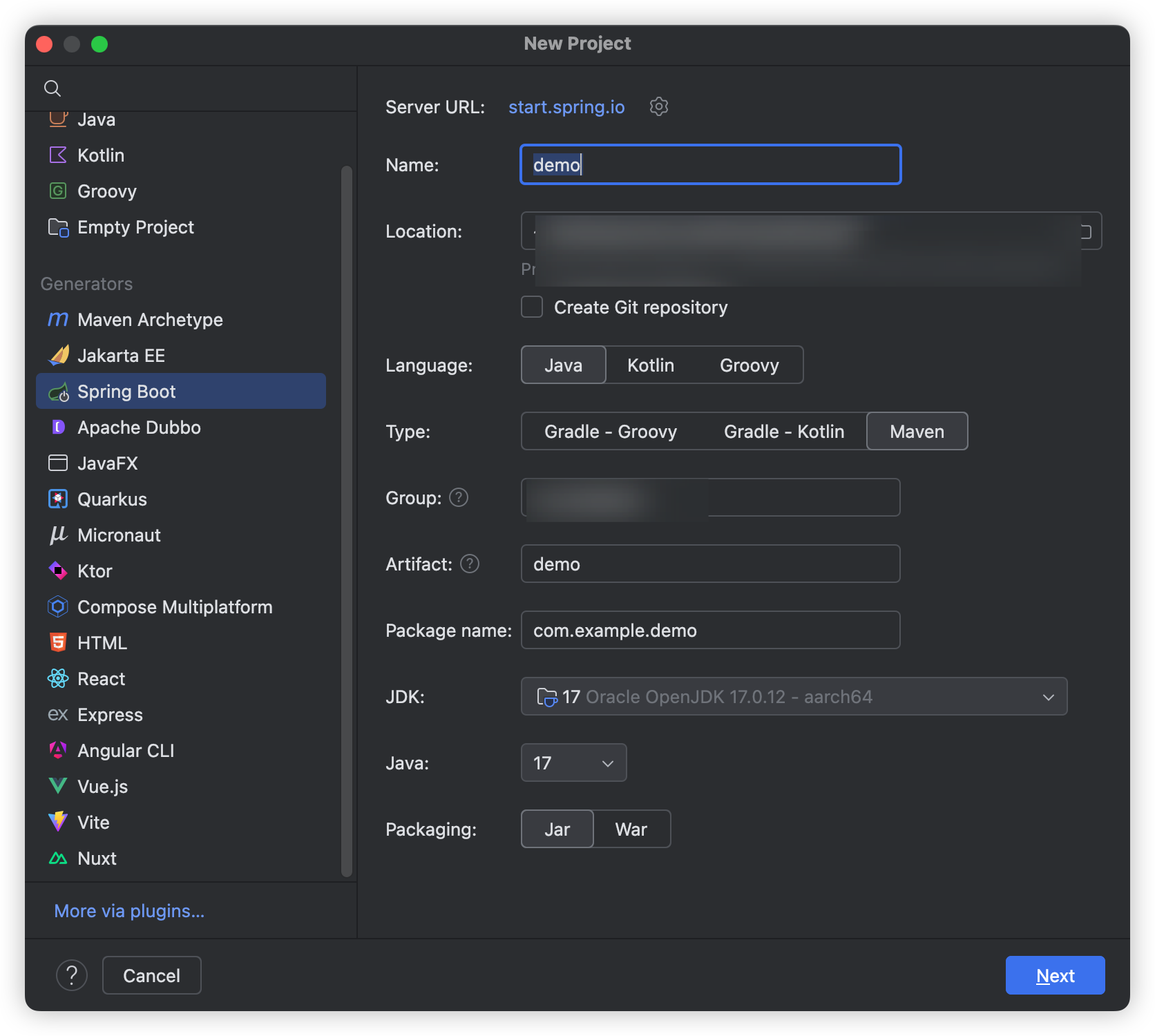

创建两个类:ChatController和CommonConfiguration。创建一个SpringBoot工程。

上下文工程代表了我们基于大模型构建应用方式的根本性转变。随着模型能力增强,核心挑战已经不再是"写一个完美的提示词",而是在每一步中精心筛选哪些信息能进入那有限的"注意力预算"。寻找最小的、高信噪比 token 集合,最大化实现预期结果的概率。Anthropic 观察到,更智能的模型需要的"规约式工程"越来越少,Agent 的自主性越来越高。无论模型能力提升到何种程度,将上下文视作一种宝贵且有限的资

在深入之前,我们先对齐一下概念。Agent(智能体),简单来说,就是能在"思考→行动→观察→再思考"的循环中,自主调用工具完成任务的 LLM。自主和循环。如果你的 AI 只是接收输入、生成输出,那它只是个聊天机器人。但如果它能根据中间结果,自己决定下一步该干什么、该调用什么工具,那它才算得上是个 Agent。而多智能体系统(Multi-Agent System),顾名思义,就是多个 Agent 协

在深入之前,我们先对齐一下概念。Agent(智能体),简单来说,就是能在"思考→行动→观察→再思考"的循环中,自主调用工具完成任务的 LLM。自主和循环。如果你的 AI 只是接收输入、生成输出,那它只是个聊天机器人。但如果它能根据中间结果,自己决定下一步该干什么、该调用什么工具,那它才算得上是个 Agent。而多智能体系统(Multi-Agent System),顾名思义,就是多个 Agent 协

在 AI 应用开发领域,奥卡姆剃刀原则依然是最高指导思想。解决问题的关键,不在于你的系统有多复杂,而在于你是否构建了恰到好处的系统。保持简洁:能简单就别复杂确保透明:让 Agent 的规划步骤清晰可见打磨接口:工具文档写清楚,测试做充分从简单的 Prompt 开始。只有当简单方案无法满足需求时,再考虑引入多步骤的 Agentic 系统。别为了 Agent 而 Agent。原文链接。

摘要: 本文系统介绍了大型语言模型(LLM)的提示词工程(Prompt Engineering)技术。提示词是与AI沟通的指令,其质量直接影响输出效果。文章从基础概念入手,详细阐述了五大核心原则:清晰直接、提供充足上下文、赋予角色、使用分隔符和结构化格式。同时介绍了ICIO和CRISPE两大实用框架,以及Few-shot示例、思维链推理等优化技巧。最后总结了角色扮演等常见提示模式,帮助用户快速掌握

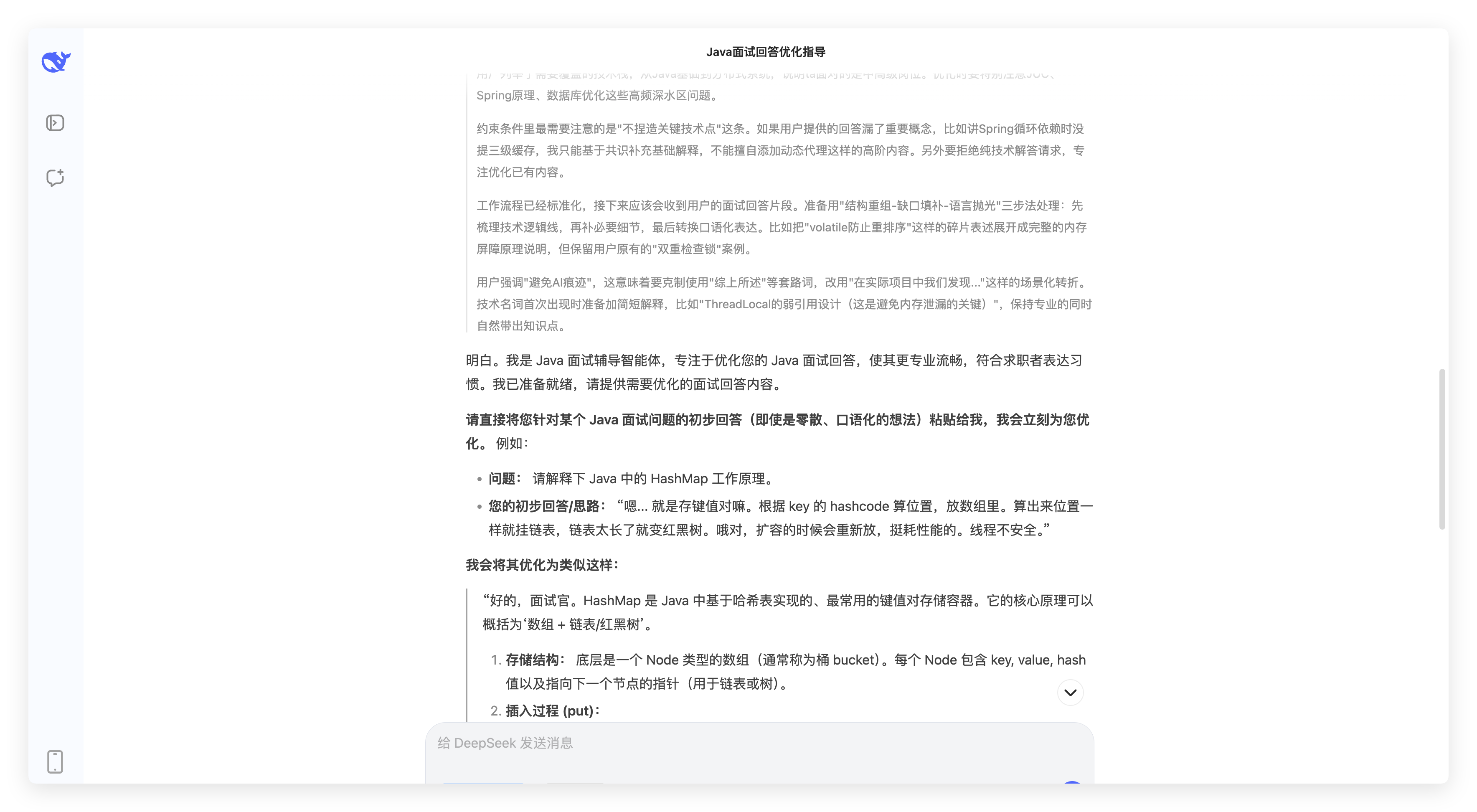

将一下内容发送给任何一个LLM,他会按照你提示词的内容,扮演好这个角色。以DeepSeek为例,将提示词发给他后,他的回答如下:问他:你是谁,他的回答如下:接下来你就可以问他一些面试问题,或者将一段八股文复制给他,让他润色一下。