简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

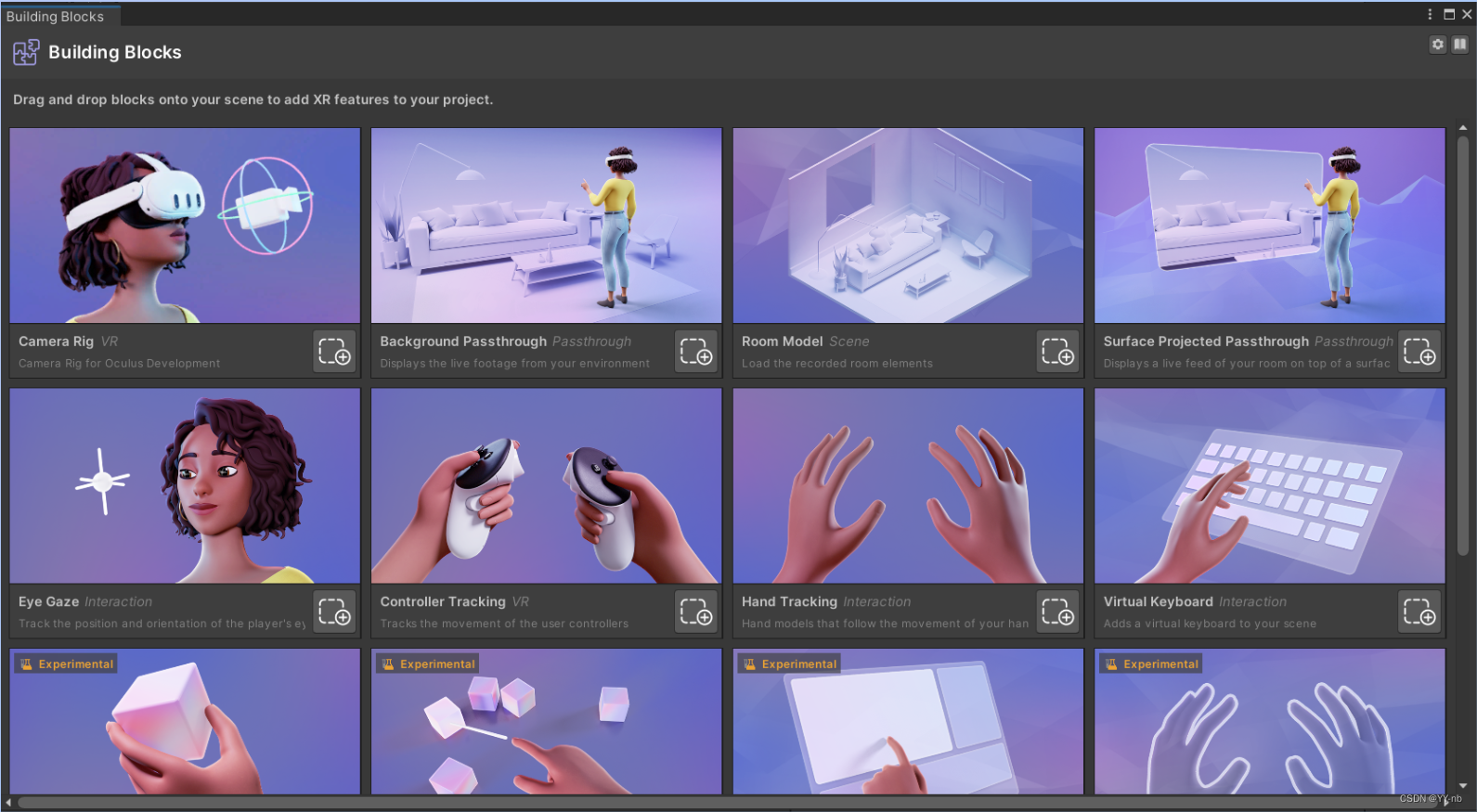

这期教程我将会介绍 Unity Meta XR SDK 中提供的快捷配置开发工具分别是 Building Block,Quick Action 和 OVRCameraRigInteraction。使用快捷开发工具能够快速地配置出 SDK 中的一些功能,省下了手动配置的时间,能够大大地加快开发速度,降低开发难度。

课程内容:• 眼动 + 手追交互• Poke 手指点触• 近距离抓取物体• 双手缩放物体• 物体高亮效果• 物体阴影效果• 交互事件

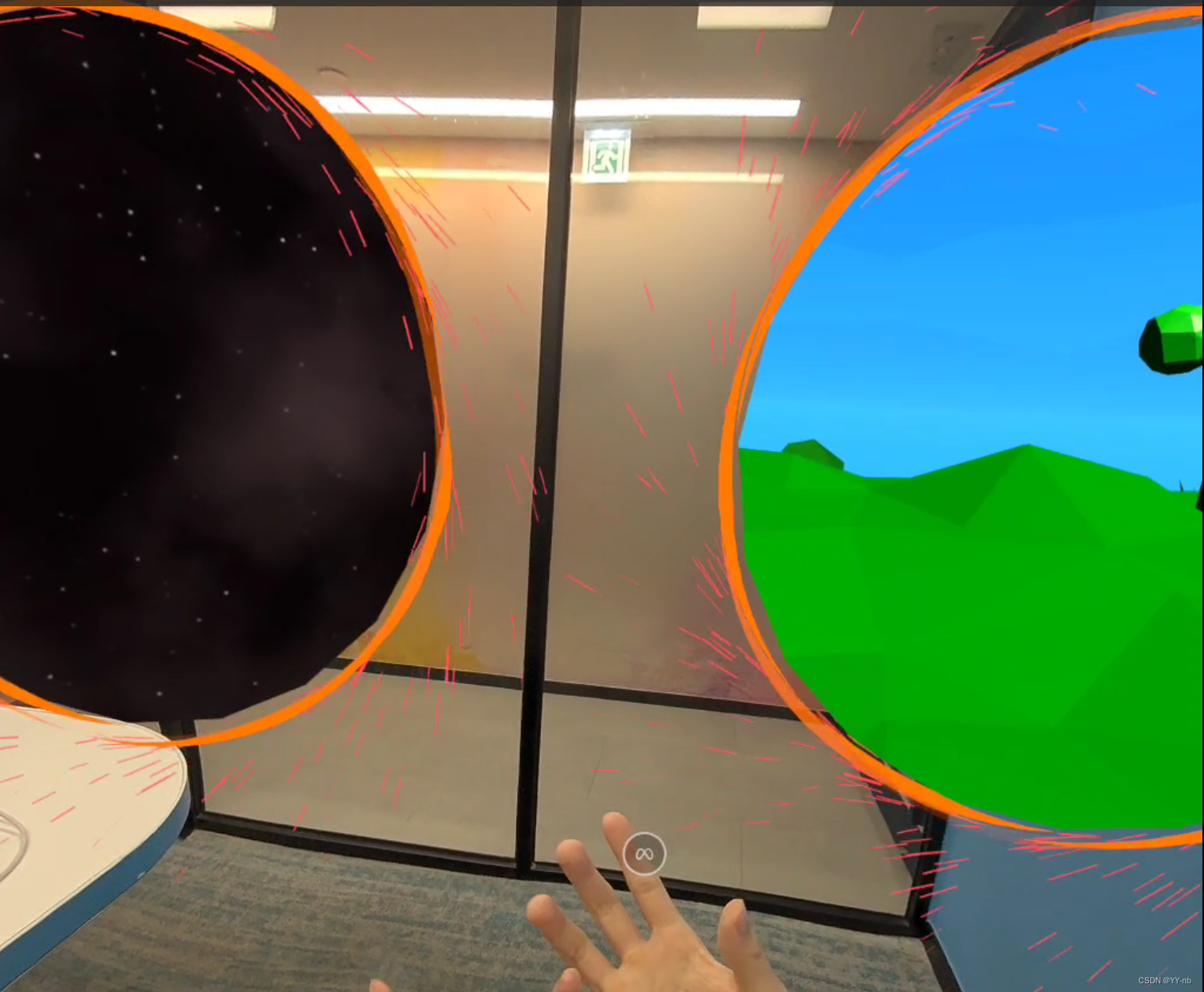

这期教程我将介绍如何使用 Stencil Test 模板测试,来制作可以在虚拟与现实之间穿梭的 MR 传送门。在上一期制作虚拟门窗的教程中,我们介绍了一种 Depth Only Shader,它能够让物体不显示颜色,但是能够参与到深度测试中。而这期教程,我们会介绍另外一种 Shader,也是能实现在现实中透视出一块虚拟区域的效果。这种 Shader 叫做 Stencil Shader,它与 Ste

本篇教程将会利用 OpenXR 和 XR Interaction Toolkit 搭建一个简单的 VR 场景。最终实现的效果是开发者将 VR 头显和电脑进行串流后,能通过头显看到 Unity 中的场景,并且头部、手柄的位移和转动也能准确定位。

在之前的教程中,我们成功实现了用手柄来控制手部模型的姿势。这篇博客,我们一起来实现通过手柄控制人物的转向和移动。最终实现的效果:转动右手柄摇杆可以进行转向,转动左手柄摇杆可以进行移动,并且人物可以上楼梯。

最终实现的手部动画:按下手柄的 Trigger 键让大拇指和食指做出捏合的动画,按下手柄的 Grip 键让整只手做出抓握的动画。了解原理后也可以自定义手部动画和手柄按键的对应关系,做出适合自己需求的手部动画。

在 VR 的交互中,与 UI 进行交互是很常见的功能。本篇教程,我将介绍如何在 VR 世界中用射线进行 UI 的交互。最终实现的效果:手部射线(一开始是看不见的)对准 UI 时,会显示一条指向 UI 的射线。按下手柄的 Trigger 键,能与可交互的 UI(如 Button,Toggle,Slider 等)进行互动。

交互一般需要两个对象:一个是可交互的对象(Interactable),一个是发起交互的对象(Interactor,一般是玩家自己)。本系列教程中的传送功能也是交互的一种方式,可传送的地面是可交互的对象,手部发出的传送射线是发起交互的对象。而这篇教程将要介绍的是如何在 VR 世界中直接用双手与物品进行交互,此时物品是可交互的对象,手是发起交互的对象。

本篇教程将会利用 OpenXR 和 XR Interaction Toolkit 搭建一个简单的 VR 场景。最终实现的效果是开发者将 VR 头显和电脑进行串流后,能通过头显看到 Unity 中的场景,并且头部、手柄的位移和转动也能准确定位。

这篇教程将会介绍如何用 Meta XR SDK,自定义交互事件触发时执行的逻辑。最后会实现一个功能:用手指点击 UI 按钮后,在前方召唤一把剑。