简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

主包近期收集了字节大模型算法岗面试中涉及到的手撕代码真题,来源覆盖xhs、某乎、CSDN、🐮客等各大平台,力求做到不重复不遗漏,希望给27届备战找实习秋招的uu们一个复习的抓手。如有遗漏,欢迎在评论区留言补充~

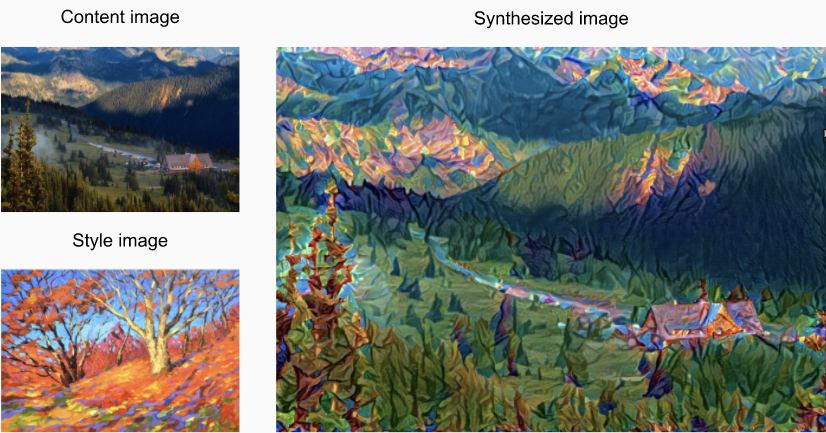

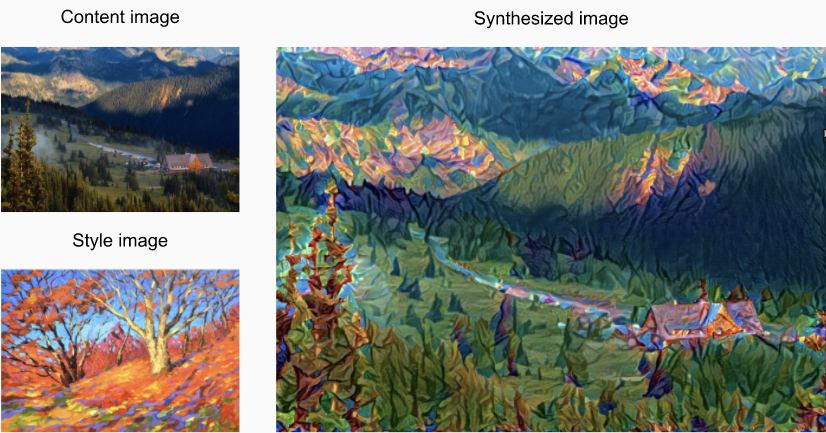

本文是对李沐Dive to DL《动手学深度学习》第二版13.12节风格迁移的源码详解,整体由Jupyter+VSCode完成,几乎所有重要代码均给出了注释,一看就懂。需要的同学可以在文末链接处下载原文件。话不多说,我们开始。图1中的内容图像为本书作者在西雅图郊区的雷尼尔山国家公园拍摄的风景照,而风格图像则是一幅主题为秋天橡树的油画。最终输出的合成图像应用了风格图像的油画笔触让整体颜色更加鲜艳,同

字节大模型算法岗面试真题解析与备战策略 近期整理的字节大模型算法岗面试真题涵盖Transformer架构、强化学习训练、推理加速、多智能体系统、多模态模型等核心领域。面试风格以深挖原理+工程实践+前沿动态为主,重点考察: Transformer:Attention机制、MHA/GQA优化、Decoder-only架构设计; RL对齐:PPO/DPO/GRPO流程对比、奖励函数设计与调优; 推理加速

解决pytorch报错——RuntimeError: Expected to have finished reduction in the prior iteration before starting a new one. This error indicates that your module has parameters that were not used in producing lo

一、程序及函数1.引导脚本ex7_pca.m%% Machine Learning Online Class%Exercise 7 | Principle Component Analysis and K-Means Clustering%%Instructions%------------------------------------------------------------%%This

西电计科大数据方向机器学习课程复习笔记

一、程序及函数1.引导脚本ex3.m%% Machine Learning Online Class - Exercise 3 | Part 1: One-vs-all%Instructions%------------%%This file contains code that helps you get started on the%linear exercise. You will need

本文用matlab实现了计算机视觉中的6大基础图像变换操作,包括:1. 水平、垂直镜像2. 图像缩放3. 平移4. 旋转5. 仿射6. 透视clear;close all;img= imread('C:\Users\HP\Desktop\lena.bmp');[m,n] = size(img);subplot(1,3,1);imshow(img);title('原始图像');% ---------

Andrew Ng在他的机器学习课程中讲述bp神经网络时,并没有深究这算法背后的推导过程,只是给了我们一个大体的执行步骤,实现了这个算法但却不知道这个算法背后的原理是件很痛苦的事。在看了知乎、csdn、简书后发现有很多人采用矩阵求偏导之类的推导步骤。诚然,这么干可以使公式变得很紧凑,在编程时也能有效减少代码行数,提高运行效率,但是矩阵形式的推导有两个小小的不足: 1. 矩阵、向量的求导、求偏

本文是对李沐Dive to DL《动手学深度学习》第二版13.12节风格迁移的源码详解,整体由Jupyter+VSCode完成,几乎所有重要代码均给出了注释,一看就懂。需要的同学可以在文末链接处下载原文件。话不多说,我们开始。图1中的内容图像为本书作者在西雅图郊区的雷尼尔山国家公园拍摄的风景照,而风格图像则是一幅主题为秋天橡树的油画。最终输出的合成图像应用了风格图像的油画笔触让整体颜色更加鲜艳,同