简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

关于需要下载的环境和具体的包参考【①录制imu的rosbag②标定①连续时间②离散时间对于离散时间的白噪声= 连续时间的白噪声 * 频率的平方根对于离散时间的随机游走 = 连续时间的随机游走 / 频率的平方根使用imu_utils得到的白噪声(white_noise)和随机游走(random_walk)单位有问题,这些参数实际上是离散时间的,但认为是连续时间的。(参考【】中matrin的回复)。这

目录一、OpenCV的 ORB特征二、手写ORB特征一、OpenCV的 ORB特征1.Keypoint类opencv中Keypoint类的默认构造函数为:CV_WRAP KeyPoint() : pt(0,0), size(0), angle(-1), response(0), octave(0), class_id(-1) {}pt(x,y):关键点的点坐标; size():该关键点邻域直径大小

一、手写高斯牛顿法三个步骤:1、先根据模型生成x,y的真值,并在真值中添加高斯分布的噪声2、使用高斯牛顿法进行迭代3、求解高斯牛顿法的增量方程增量方程的推到过程图片来源 该公式等同于133页6.41式Σ 是 高斯噪声的方差CMakeLists.txtcmake_minimum_required(VERSION 3.0)project(ch6)set(CMAKE_BUILD_TYPE Release

ceres实现BAg2o实现BA

一、首先理解运动方程和观测方程(1)运动方程: x表示相机的位姿,每个时刻位姿记为x1, x2...... xk,构成了运动的轨迹。uk 是传感器的输入;wk 是噪声,假设噪声服从高斯分布。运动方程的意义是: k-1 到 k 时刻,机器人位姿x 是如何变化的。 SLAM中的定位问题就是估计 x的值。区分位姿和位置:位姿代表位置和姿态。任何一个刚体在空间坐标系(OXYZ)中,可以用位置和姿态来精确、

回环检测

一、直接法的提出1.特征点法的缺点:①关键点的提取和描述子的匹配非常耗时。②忽略了特征点以外的所有信息。一张图像的像素有几十万,特征点只要几百个。③相机有时会运动到特征缺失的地方,比如白墙,或者空荡的走廊。这些场景特征点数量明显减少。④由于只提取特征点,因此通过特征点法只能重构出稀疏地图。2.解决这些缺点的思路:①保留特征点,但只计算关键点(必须是角点),不计算描述子。使用光流法跟踪特征点的运动,

本文介绍了 Point-LIO:一种具有高带宽和鲁棒性的 Lidar-Imu 里程计,能够估计极为激烈的机器人运动。Point-LIO有两个关键创新。第一个创新是逐点 LIO 框架,该框架在每个LiDAR点测量时更新状态。该框架允许极高频率的里程计输出,显著增加了里程计带宽,从根本上消除了帧内运动畸变。第二个创新是采用随机过程增强的运动学模型,模型将IMU测量作为输出。这个新的建模方法使得在激烈运

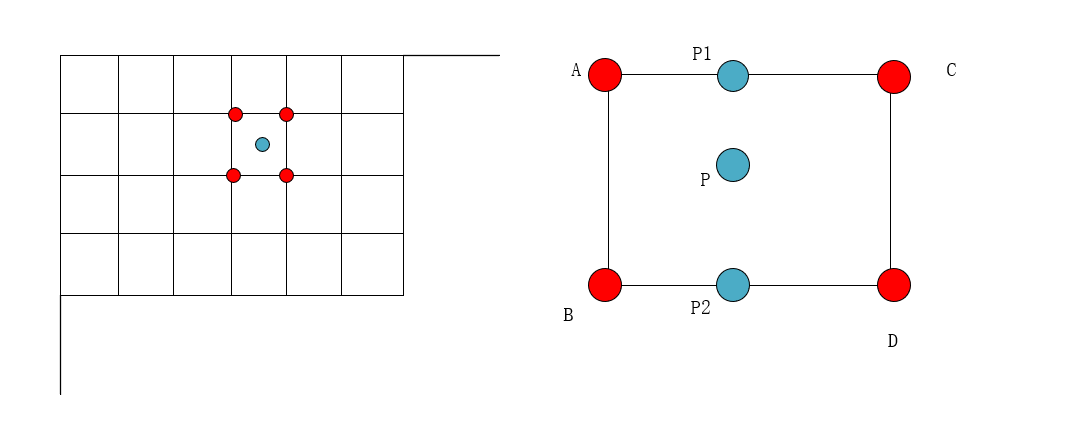

对于float类型的像素,使用双线性插值方法求灰度。如下图所示,求P点灰度时找到附近的四个。设P(x+xx,y+yy),P1(x+xx,y), P2(x+xx,y+1)(int函数和floor函数区别:int函数返回的值是整型,floor函数返回值是浮点型。坐标的像素点A(x,y) B(x,y+1)C(x+1,y) D(x+1,y+1),双线性插值就是在x、y轴进行了三次单线性插值。这里的xx和y

opencv 中相机标定calibrateCamera() 接口的实现,总结如下:(1. 因为镜头畸变的影响比较小,首先假定相机是理想无畸变的,根据闭式解来计算初始的相机内参;2. 估计相机位姿,也就是求解相机外参,opencv使用solvePnP来实现,支持迭代和 P3P 等多种算法求解;3. 应用最小二乘求解实际的径向畸变系数(4. 根据求解的内外参对objectPoints进行重投影,应用全