简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

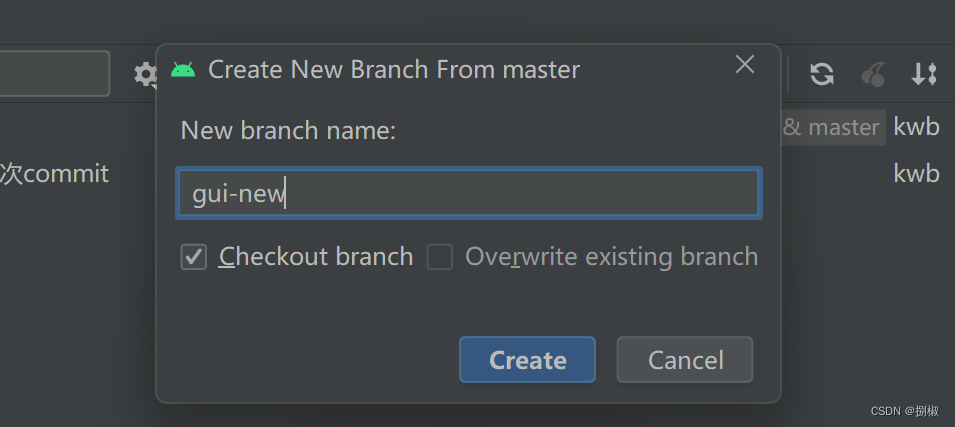

创建、查看、删除、合并分支等操作。

1. pandas读写数据操作1.1 to_csv()相关参数path:路径,可以是相对路径也可以绝对路径。只填写文件名则为相对路径sep:分隔符,如果不写默认为 “,”。header:是否保留列名,0 为不保存,默认为 True。index:是否保留行索引,0 为不保存,默认为 True。columns:保留某列或者某些列数据。na_rep:替换空值,如果不写,默认是空。float_format

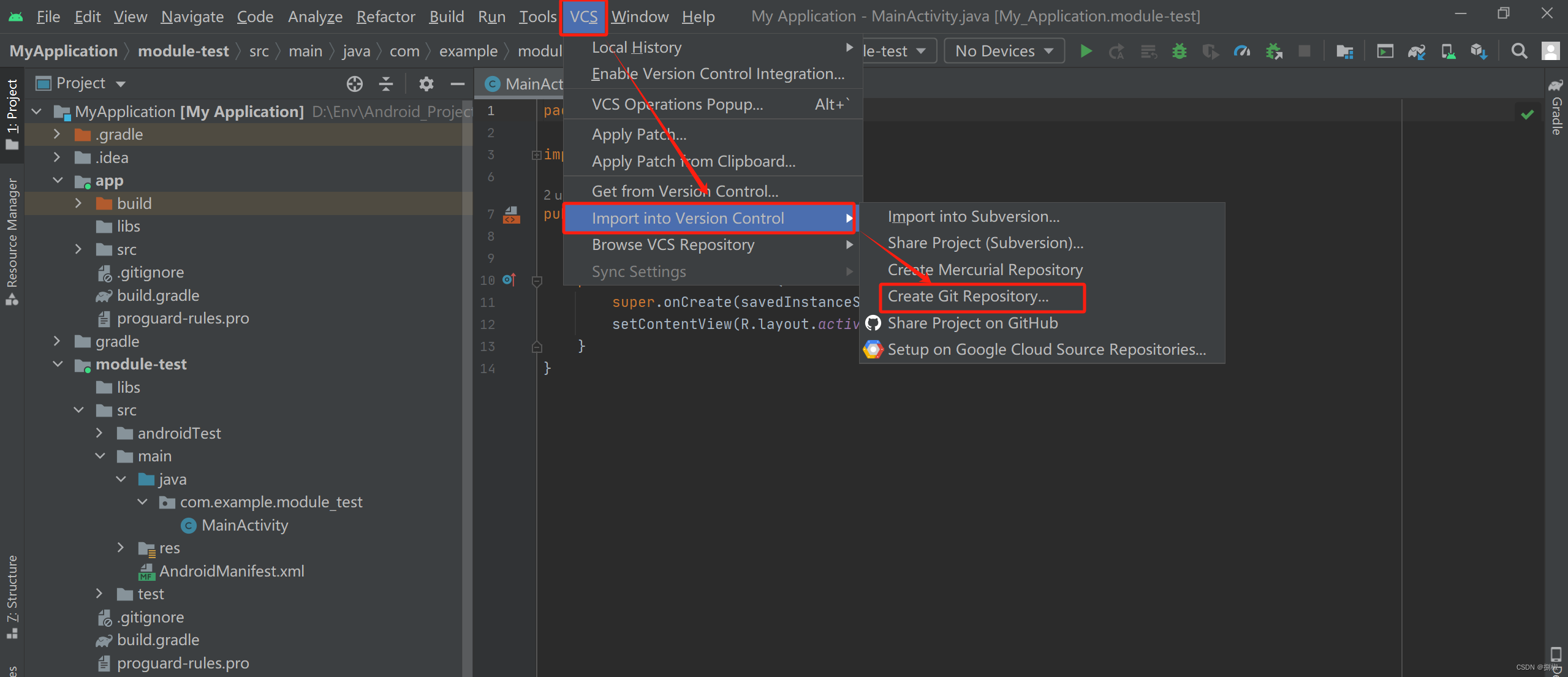

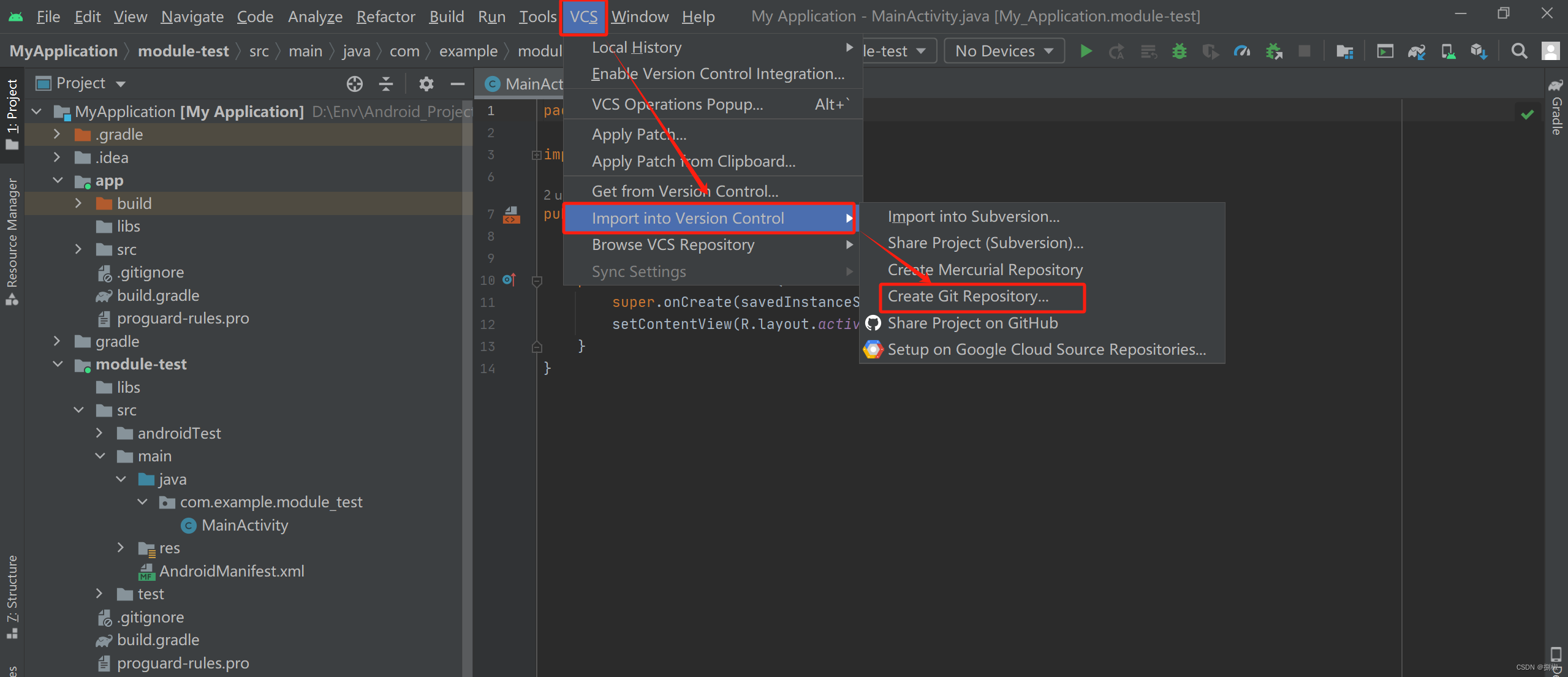

【代码】Android Studio开发工具学习之Git远程仓库拉取与推送。

这里写目录标题1. np.linspace()2. np.ceil() ,np.floor()1. np.linspace()np.linspace() 主要用于生成等差数列,相关参数如下:start:起始点stop:终止点 【包含】num : 生成start和stop之间num个等差间隔的元素,默认50,endpoint :生成等差间隔为 (stop - start)/num 的元素,默认为Tr

文章转自:刘建平Pinard:强化学习(一)模型基础 ,在此向作者表示由衷的感谢。前言从今天开始整理强化学习领域的知识,主要参考的资料是Sutton的强化学习书和UCL强化学习的课程。这个系列大概准备写10到20篇,希望写完后自己的强化学习碎片化知识可以得到融会贯通,也希望可以帮到更多的人,毕竟目前系统的讲解强化学习的中文资料不太多。第一篇会从强化学习的基本概念讲起,对应Sutton书的第一章和U

文章转自:刘建平Pinard:强化学习(十六)深度确定性策略梯度(DDPG),在此向作者表示由衷的感谢。前言在强化学习(十五) A3C中,我们讨论了使用多线程的方法来解决Actor-Critic难收敛的问题,今天我们不使用多线程,而是使用和DDQN类似的方法:即经验回放和双网络的方法来改进Actor-Critic难收敛的问题,这个算法就是是深度确定性策略梯度(Deep Deterministic

【代码】Android Studio开发工具学习之Git远程仓库拉取与推送。

这里写目录标题1. np.linspace()2. np.ceil() ,np.floor()1. np.linspace()np.linspace() 主要用于生成等差数列,相关参数如下:start:起始点stop:终止点 【包含】num : 生成start和stop之间num个等差间隔的元素,默认50,endpoint :生成等差间隔为 (stop - start)/num 的元素,默认为Tr

1. np.newaxis()np.newaxis()的功能:插入新维度import numpy as nparr = np.arange(6)arr_row = arr[:, np.newaxis]# 扩展行,将数组的每行转换成列,arr_col = arr[np.newaxis, :]print(arr.shape)print(arr)print(arr_row)print(arr_col)输

pandas常用统计方法练习1: 假设现在我们有一组从2006年到2016年1000部最流行的电影数据,我们想知道这些电影数据中评分的平均分,导演的人数等信息,我们应该怎么获取?数据来源:https://www.kaggle.com/damianpanek/sunday-eda/data# coding=utf-8import pandas as pdimport numpy as npfile_