简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文设计了一种新的网络结构HRNet,以高分辨率子网络作为开始,逐步添加分辨率由高到低的子网络,并行连接多分辨率子网络,并且反复的进行多分辨率的信息融合,从而得到丰富的高分辨率表示,并且在整个网络过程中都保持高分辨率的表示。

论文Bridging the Gap Between Anchor-based and Anchor-free Detection via Adaptive Training Sample Selection官方代码GitHub - sfzhang15/ATSS: Bridging the Gap Between Anchor-based and Anchor-free Detection via

本文提出了一种名为SimSiam的简单孪生网络(Siamese network)结构,用于无监督的视觉表示学习。SimSiam提供了一个简单而有效的baseline,能够与现有的更复杂方法相媲美。这表明孪生网络结构本身可能是近期方法成功的核心原因。本文通过实验表明,对于损失和结构确实存在坍塌解,但停止梯度操作在防止坍塌方面起着至关重要的作用。本文还研究了SimSiam与现有的一些方法如SimCLR

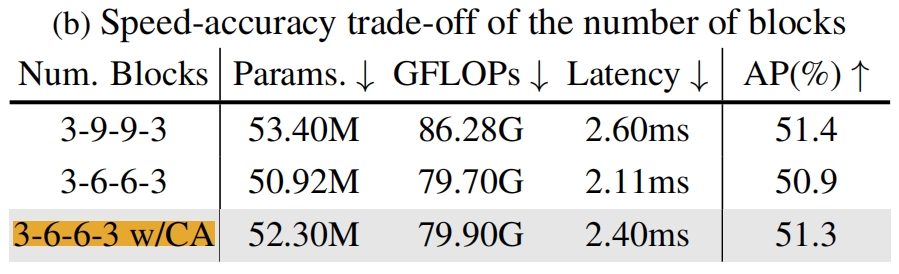

本文提出了一种新的单阶段实时目标检测模型RTDMet,超越了现有的YOLO系列,并且可以很方便了扩展到其它检测任务比如实例分割、选择目标检测等。

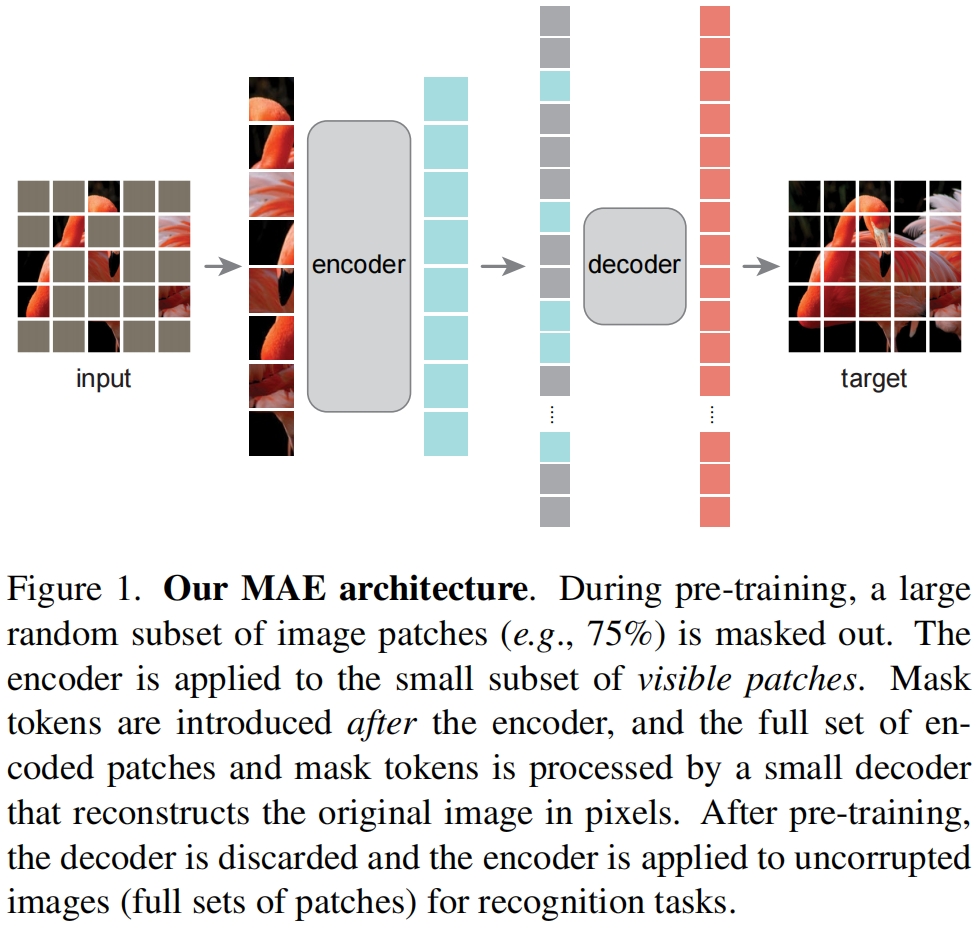

深度学习在计算机视觉领域取得了显著进展,但随着模型规模的增长,对数据的需求也在增加。在自然语言处理(NLP)领域,通过自监督预训练的方法(如BERT和GPT)成功解决了数据需求问题,这些方法通过预测数据中被遮蔽的部分来训练模型。然而,在计算机视觉领域,尽管存在相关研究,自监督学习方法的发展仍然滞后于NLP。

本文对标准transformer block的FLOPs和参数量,以及TNT block中的FLOPs和参数量进行的详细的推导。

给定CNN某层的输出激活张量 \(A\in R^{C\times H\times W}\),输入到一个基于激活的映射函数 \(\mathcal{F}\) 得到得到一个spatial attention map这里隐含的假设是一个隐含神经元激活值的绝对值可以用来表明该神经元对某个特定输入的重要程度,比如注意力图上某个位置的值越大说明网络越关注该位置。基于该假设,我们可以沿通道维度上计算这些值的统计数

中,对两张图片mixup后只是合并了两张图中的所有gtbox,并没有对类别标签进行mixup。其中\(x_{i},x_{j}\)是从训练集中随机挑选的两张图像,\(y_{i},y_{j}\)是对应的one-hot标签,通过先验知识特征向量的线性插值和对应目标的线性插值还是对应的关系,构造了新的样本\((\widetilde{x},\widetilde{y})\)。其中\(\lambda\)通过\(

分类网络的最后一层通常会采用softmax将logits转化成各类别的最终预测概率,本文将带温度 \(T\) 的softmax输出作为大模型学习到的“知识”,并作为监督信号监督小模型的训练从而将大模型的知识传递给小模型。如下所示温度 \(T\) 的引入可以使大模型输出的概率分布较为缓和,\(T\) 越大,分布越缓和。比如以MINIST分类为例,对于某张“2”的图像大模型输出3的概率为\(10^{-

这里需要特别介绍一下读取图片的操作。下面是一个例子,在这个例子中,partial(add, 5)创建了一个新的函数add_five,它实际上是add函数的一个版本,只不过把第一个参数固定为5。partial(self.read_img, use_cache=False)调用的self.read_img在COCODataset中实现,并且将参数use_cache固定为False,但是我们看到函数re