简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

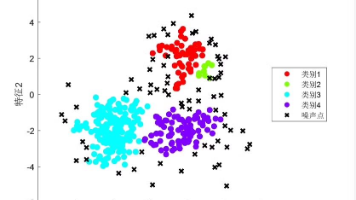

这十大方法覆盖了数据清洗从诊断到处理的全流程,基本能解决工作中90%的数据质量问题。方法之间不是孤立的,实际项目中常常组合使用,缺失值处理前先识别异常值,分箱前先标准化,形成组合拳威力更显著。AI时代的数据工作,质量比数量重要一百倍。干净的小数据集,胜过十个脏大数据堆。大模型对数据质量更敏感,训练数据中的噪声会被模型学习并放大。从今天开始,别再把数据清洗当成体力活,它是数据科学里最体现专业功底的环

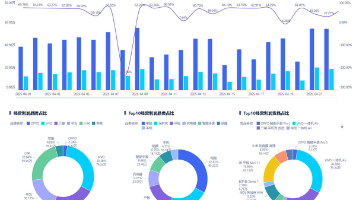

本文提炼了9个关键指标:库存周转率、持有成本率、呆滞库存占比反映资金效率;订单交付率、完美履行率和履行周期衡量客户体验;供应商交货率、产能利用率和总成本率评估运营协同。

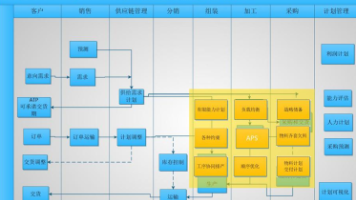

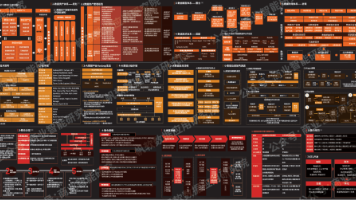

供应链管理是一套系统化的管理动作,其本质在于平衡成本与效率、速度与质量、风险与收益。真实的供应链是一张动态网络,而非简单的线性流程,涉及物料、信息和资金的高效流动。供应链管理的核心内容包括:需求管理(确保信息透明流动)、供应管理(建立稳定可控的供应体系)和库存管理(制定适合企业的库存策略)。同时需要理顺信息流(实现数据共享)、物流(优化布局流程)和资金流(追踪真实成本)。供应链管理的底层逻辑是客户

供应链管理远不止采购砍价或仓库理货,而是覆盖从需求到交付的全流程管控。核心环节包括:需求管理(销售与生产协同)、采购管理(供应商选择与成本平衡)、生产计划(动态排产与工序把控)、仓储管理(规范出入库与盘点制度)、交付管理(物流跟踪与异常处理)。

库存管理常见三大痛点:畅销品缺货与库存积压并存、采购预测不准、账实不符。库存流转分析通过四大维度破解难题:1.流动性分析(周转率评估库存流动效率);2.结构与分布分析(优化库位配置);3.价值与成本分析(ABC分类管理高价值商品);4.责任归属分析(追溯问题根源)。该分析方法适用于制造业采购优化、零售业动态补货、供应链预测等场景,借助数据看板实现精准决策,帮助企业在控制成本的同时提升周转效率。

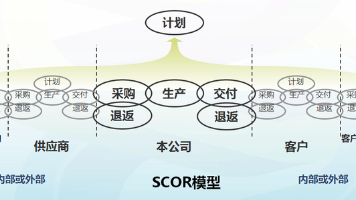

供应链管理五大核心模型解析:SCOR模型用于流程标准化,解决跨部门协作问题;牛鞭效应揭示需求波动放大现象,需信息透明与订单优化;VMI(供应商管理库存)转移库存管理责任,降低资金压力;QR(快速响应)缩短供需周期,适合快消行业;供应链平衡计分卡从财务、客户、流程、成长四个维度评估绩效。这些模型可单独或组合使用,帮助企业提升供应链效率与稳定性。

本文强调财务分析应回归基础,重点解读利润表、现金流量表和资产负债表的实用分析方法。利润表需动态分析收入趋势和利润质量;现金流量表要关注经营、投资和筹资活动的现金流动;资产负债表则需理解资产与负债的结构关系。三张报表相互关联,共同反映企业经营状况。有效的经营分析应基于报表数据追溯业务动因,避免脱离实际的复杂模型。掌握这些基础分析方法,才能真正提升财务分析的质量和价值。

摘要:本文推荐5款实用的数据库工具,帮助开发者高效处理数据同步、查询和管理需求。FineDataLink适合企业级数据集成,提供低代码ETL和实时同步;Navicat是多数据库管理的全能工具;DBeaver是开源免费的通用数据库工具;SQLark专精国产数据库迁移;HeidiSQL则是轻量级的MySQL/MariaDB管理利器。文章从核心功能、适用场景和预算角度给出选型建议,强调根据实际需求选择最

图计算是专门处理关联数据的计算方式,通过点(实体)和线(关系)构建网络模型。相比传统数据库,它能快速查询多层关联关系,适用于风控、供应链等场景。核心功能包括图查询(提取关联)、图计算(全局分析)和图学习(向量化处理)。应用时需明确业务目标,梳理数据关系,选择合适的工具,并通过小范围试错验证效果。随着工具简化,图计算正变得更容易上手,关键在于理解业务关联而非技术门槛。

穿透式监管是当前央国企改革的重要方向,涉及治理架构、技术平台和规则模型三大核心要素。穿透式监管体系作为顶层设计,包含体制机制、监管系统、监督追责和制度体系四大支柱;监管平台则是技术实现,需具备数据采集、智能预警等五大功能;规则模型作为核心,需精准设计风险场景、数据来源等六大要素。三者相互支撑,共同构成完整的穿透式监管闭环,推动企业风险管理从经验判断转向数据驱动的精准监控。