简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

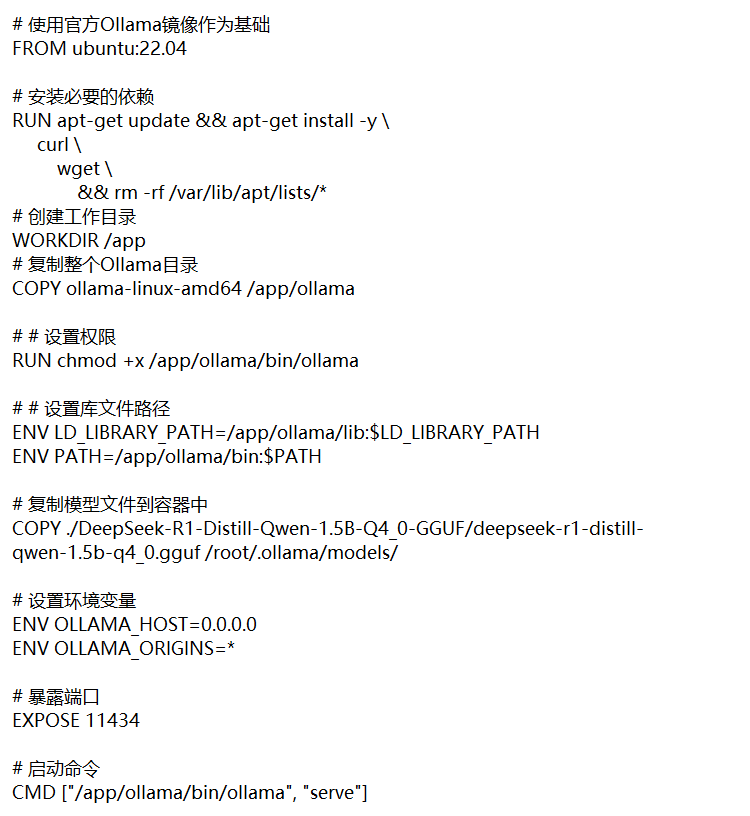

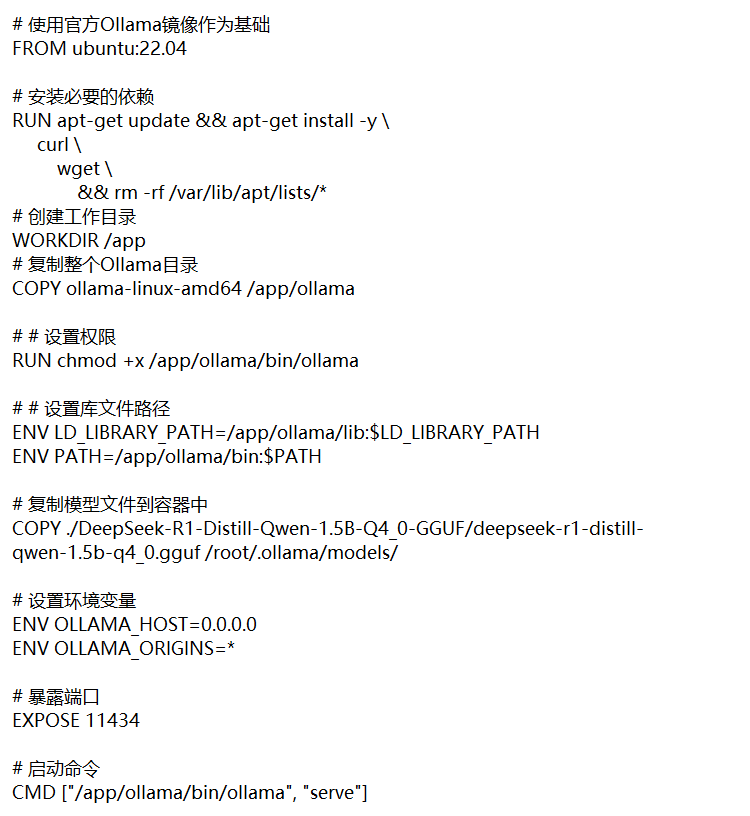

1.1 下载模型在有网络的环境下下载DeepSeek 1.5B的GGUF格式模型,资源足够的话,理论上你想部署啥就部署啥模型:推荐去hugginface下载或者魔搭:这里我是魔搭下载的量化版:https://modelscope.cn/models/ggml-org/DeepSeek-R1-Distill-Qwen-1.5B-Q4_0-GGUF/files下载ubuntu官方镜像:docker p

本文介绍了OpenClaw的Docker部署流程。使用openclaw/openclaw:latest镜像,通过docker-compose配置端口映射(18789)、环境变量和卷挂载。重点配置了openclaw.json文件,包含MiniMax API设置、代理模型配置和网关认证参数。启动后需通过指定token访问Web界面(如xxx:18789/?token=xxx),并可能遇到身份验证或模型

本文详细介绍了在华为昇腾NPU设备上部署Mineru项目的完整流程。首先需下载对应版本的华为镜像包,然后通过docker run命令运行容器并挂载必要的设备目录。部署过程中需注意安装指定版本的依赖库(如accelerate 0.25.0、torch-npu 2.1.0等),配置本地模型路径,并解决可能出现的依赖冲突问题。最后通过mineru-api命令启动服务,支持pipeline模式处理PDF文

本文介绍了OpenClaw的Docker部署流程。使用openclaw/openclaw:latest镜像,通过docker-compose配置端口映射(18789)、环境变量和卷挂载。重点配置了openclaw.json文件,包含MiniMax API设置、代理模型配置和网关认证参数。启动后需通过指定token访问Web界面(如xxx:18789/?token=xxx),并可能遇到身份验证或模型

本文档介绍了如何将Mineru升级到2.5版本并部署相关服务。新版本改用VLLM引擎提升NPU兼容性,需基于v0.10.2rc1版本的vllm-ascend镜像构建。部署步骤包括:1)拉取基础镜像;2)启动容器配置设备;3)安装Mineru核心依赖和模型;4)通过命令或Compose文件启动服务。文档提供了完整的Docker Compose配置示例,支持多设备并行和健康检查,并详细说明了GPU内存

1.1 下载模型在有网络的环境下下载DeepSeek 1.5B的GGUF格式模型,资源足够的话,理论上你想部署啥就部署啥模型:推荐去hugginface下载或者魔搭:这里我是魔搭下载的量化版:https://modelscope.cn/models/ggml-org/DeepSeek-R1-Distill-Qwen-1.5B-Q4_0-GGUF/files下载ubuntu官方镜像:docker p

本文档介绍了如何将Mineru升级到2.5版本并部署相关服务。新版本改用VLLM引擎提升NPU兼容性,需基于v0.10.2rc1版本的vllm-ascend镜像构建。部署步骤包括:1)拉取基础镜像;2)启动容器配置设备;3)安装Mineru核心依赖和模型;4)通过命令或Compose文件启动服务。文档提供了完整的Docker Compose配置示例,支持多设备并行和健康检查,并详细说明了GPU内存

本文详细介绍了在华为昇腾NPU设备上部署Mineru项目的完整流程。首先需下载对应版本的华为镜像包,然后通过docker run命令运行容器并挂载必要的设备目录。部署过程中需注意安装指定版本的依赖库(如accelerate 0.25.0、torch-npu 2.1.0等),配置本地模型路径,并解决可能出现的依赖冲突问题。最后通过mineru-api命令启动服务,支持pipeline模式处理PDF文

本文档介绍了如何将Mineru升级到2.5版本并部署相关服务。新版本改用VLLM引擎提升NPU兼容性,需基于v0.10.2rc1版本的vllm-ascend镜像构建。部署步骤包括:1)拉取基础镜像;2)启动容器配置设备;3)安装Mineru核心依赖和模型;4)通过命令或Compose文件启动服务。文档提供了完整的Docker Compose配置示例,支持多设备并行和健康检查,并详细说明了GPU内存

本文档介绍了如何将Mineru升级到2.5版本并部署相关服务。新版本改用VLLM引擎提升NPU兼容性,需基于v0.10.2rc1版本的vllm-ascend镜像构建。部署步骤包括:1)拉取基础镜像;2)启动容器配置设备;3)安装Mineru核心依赖和模型;4)通过命令或Compose文件启动服务。文档提供了完整的Docker Compose配置示例,支持多设备并行和健康检查,并详细说明了GPU内存