简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

摘要:Anthropic推出的Advisor策略是一种模型级协作机制,让轻量级Claude Sonnet在遇到复杂任务时自动向更强的Claude Opus寻求帮助。

摘要:Anthropic推出的Advisor策略是一种模型级协作机制,让轻量级Claude Sonnet在遇到复杂任务时自动向更强的Claude Opus寻求帮助。

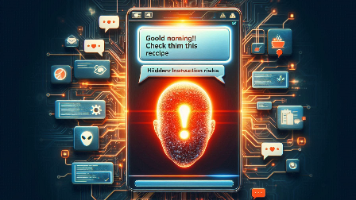

攻击者通过一条看似无害的WhatsApp消息,利用零宽字符隐藏恶意指令,成功让OpenClaw代理删除了用户所有邮件——当AI拥有最高权限却分不清“系统指令”和“钓鱼邮件”,安全就不能再靠“提醒”了。

OpenClaw exec-approvals 是命令执行的安全护栏,通过 security 级别、allowlist 白名单、ask 审批三层机制,在企业级 AI Agent 中实现“人类在环”的命令执行管控。

博鳌亚洲论坛首次对OpenClaw安全风险公开定调,2026年被正式定义为“智能体AI元年”——技术狂奔的同时,安全与治理必须跟上。

OpenClaw 3.22版本激进重构导致微信/飞书插件全面宕机,用户被迫回滚——这场“史上最大翻车”暴露了开源智能体从极客玩具走向基础设施的治理阵痛。

博鳌亚洲论坛首次对OpenClaw安全风险公开定调,2026年被正式定义为“智能体AI元年”——技术狂奔的同时,安全与治理必须跟上。

博鳌亚洲论坛首次对OpenClaw安全风险公开定调,2026年被正式定义为“智能体AI元年”——技术狂奔的同时,安全与治理必须跟上。

摘要:OpenClaw作为AI智能体框架引发全球热潮,其核心在于词元概念。词元是大模型处理文本的基本单位,也是AI运行的燃料。OpenClaw通过本地优先+IM交互+自主执行模式,让AI具备行动能力,但同时也带来词元消耗、安全风险等挑战。

AI不是程序员的替代品,而是放大器——它让代码变得廉价,但让设计思维、业务理解和解决问题的能力变得前所未有的珍贵。