简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

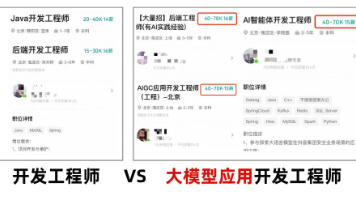

【摘要】一位32岁的北漂程序员分享了自己从传统软件开发转行AI大模型领域的经历。原为二本计算机专业毕业的他,在北京从事编程工作十年后陷入职业瓶颈,决定转型新兴的大模型应用开发领域。通过系统学习大模型微调、RAG技术和AI Agent开发等核心技能,仅用两个月成功获得月薪2万+的offer。文章详细剖析了大模型行业的就业前景、岗位分类(算法/应用工程师)及所需技能,指出应用层开发相对门槛较低但需求旺

【摘要】Github热门项目Pyre Code推出68道大模型面试题库,覆盖Multi-Head Attention手写、KV Cache等高频考点,支持在线刷题与自动评测。当前AI行业爆发式增长,大模型应用开发人才缺口巨大,腾讯、百度等企业相关岗位年薪超百万。项目提供从Transformer结构到Agent开发的系统学习路径,包含RAG技术、模型微调等实战内容,助力开发者构建核心竞争力。另附赠大

本文介绍了AI Agent(智能体)的核心概念与应用前景。与传统聊天机器人不同,AI Agent具备自主规划、工具调用、记忆存储等能力,能主动完成任务执行。文章解析了智能体的7大核心组件(目标/规划/工具/记忆等)和标准工作流程,对比了LLM与Agent的本质区别,并推荐了旅游规划师等适合新手的入门项目。同时指出当前AI应用层人才缺口巨大,详细列出了包含大模型微调、RAG技术、Agent开发在内的

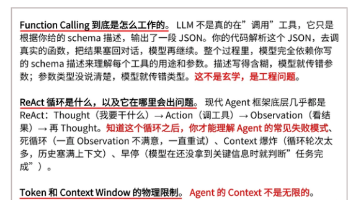

摘要: 本文系统性地解析了大模型应用的五个关键层级:1)理解大模型本质(Token、上下文、多模态等基础概念);2)掌握人机交互方式(GUI/CLI/API三种渠道及Prompt技巧);3)工具扩展能力(RAG实现知识检索、MCP标准化工具接入、Function Calling调用函数);4)Agent运作机制(任务拆解、工具调度、闭环执行);5)落地实践(办公场景集成与开发应用)。文章强调建立分

AI大模型应用开发工程师:技术与商业落地的关键桥梁 随着AI技术从实验室走向产业,大模型应用开发工程师成为连接技术与场景的核心角色。他们不研发新模型,而是基于现有大模型(如GPT、文心一言)开发实用工具,如AI客服、代码助手等,解决业务问题。核心职责包括需求拆解、技术选型、开发对接、测试优化及部署运维,需兼具技术能力与业务理解。 该岗位薪资优势显著,入门级月薪15k-25k,资深人才可达60k,因

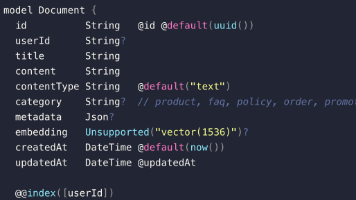

本文详细介绍了从零构建电商AI知识库的全过程,重点分享了RAG技术的实战应用。作者系统性地阐述了技术选型、数据库设计、Embedding生成、向量搜索等关键环节,并针对pgvector扩展、Prisma类型转换等常见问题提供了解决方案。通过集成RAG系统,电商AI助手实现了基于知识库的精准问答,显著提升了用户体验。文章不仅分享了完整的技术实现路径,还总结了模型选择、维度匹配等核心经验,为AI知识库

本文整理了18个免费学习人工智能的优质资源平台,涵盖提示词学习、项目开发、非编程应用和综合资源四大类。重点推荐Learn Prompting(全球最大提示词课程)、Kaggle Learn(Google数据科学课程)、DeepLearning.AI(吴恩达AI课程)等权威平台,以及B站、AI工具集等中文资源。文章特别强调AI行业尤其是大模型方向的发展潜力,指出头部企业相关岗位月薪可达3-6万元,并

AI五大趋势正在重塑未来:1)自主组件优化让机器自我改进;2)意图驱动工程凸显清晰表达的重要性;3)透明化揭示组织真实运作;4)大部分工作实为可替代的"脚手架";5)专家知识正变为公共资源。这些相互放大的趋势将带来指数级改进速度,最先适应的组织将获得碾压优势。未来竞争核心在于:清晰定义目标的能力、透明化管理水平,以及从"讲故事"到"看数据"的思维转变。AI正在加速重构所有行业,这场变革的速度和深度

本文指出当前流行的Agent学习路线存在顺序错误,建议从底层机制入手逐步深入。正确的学习路径应为:1)通过编写最小Agent理解核心机制;2)重点掌握LangGraph的状态图模型、条件边和Checkpointer;3)深入研究核心模块的工程实现;4)通过有数据的项目进行效果评估与优化。强调应先精通单Agent再学习Multi-Agent,并提供了相关学习资源。文章还分析了AI人才市场的供需矛盾,

企业推进AI Agent项目时,管理者常犯7个致命错误:追求过大场景、将Agent等同于聊天机器人、过度迷信模型能力、只关注Demo效果忽视业务闭环、缺乏统一评估标准、试点成功急于推广、将项目视为纯技术问题。这些错误看似合理,却会严重阻碍落地。成功关键在于:选择高频可控的小场景起步,将Agent视为可执行流程而非聊天界面,重视权限和回滚机制,建立业务闭环和量化指标,沉淀可复制模板,并让业务、技术和