简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

大语言模型 (LLM) 的训练和推理对硬件算力需求存在数量级差异,训练阶段消耗的算力约为推理的10^4-10^6 倍,具体体现在以下几个方面,大语言模型的训练和推理对硬件算力需求的具体差异的数据支撑如下

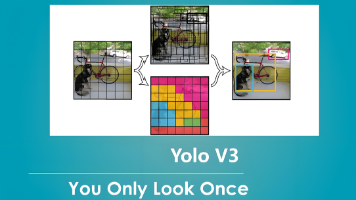

YOLO11以其精妙的模块设计和卓越的精度表现,重新定义了通用目标检测的技术高度;而YOLO26则以革命性的边缘优化和极致的部署效率,开启了端侧智能的新篇章。这两大模型的同期发布,不仅展示了Ultralytics团队的技术实力,更为整个行业提供了两种截然不同的技术路径选择。

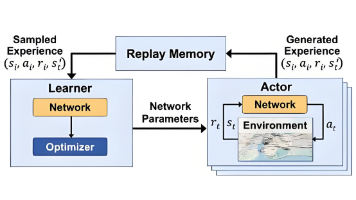

有监督学习:像按旅行指南走,一切明确,但缺乏灵活性。强化学习:像自由探索陌生城市,虽然起初困难,但能学到更灵活、更长远的策略。少设计规则,多给模型自由,它自己会找到更优解。

1、对于普通用户:1)不建议自行修改vBIOS。这是一个高风险行为,操作不当极易导致显卡无法启动(变砖),甚至物理损坏(如修改过高电压烧毁核心)。刷写vBIOS失败后的恢复过程也非常麻烦。当然,对于发烧友或骨灰级玩家群体而言,与CPU超频一样,还是有很多玩家愿意刷vBIOS。2)强烈不建议个人用户尝试修改或刷写专业GPU(如H100B200)的vBIOS。这些vBIOS与特定的服务器硬件和散热解决

若为嵌入式 / 边缘场景:优先选择 YOLOv8n/v11-S,搭配 INT8 量化 + 320x320 分辨率,算力需求控制在 2 TOPS 以内;初步实施可使用线上云服务器:如“智算云扉https://waas.aigate.cc/productService、算吧 https://www.suanba.cc/index”等租赁平台,支持按量计费。若为桌面 / 云端场景:选择 YOLOv8m/

随着技术的持续演进,AI 数字人生成的算力需求将呈现多维度动态平衡的趋势:硬件性能指数级提升与算法效率突破形成对冲,场景复杂度攀升与算力优化技术相互博弈,最终在普惠化、实时化、绿色化的驱动下,实现算力需求的 “螺旋式上升” 与 “结构性优化” 并存。以下从六大核心趋势展开分析

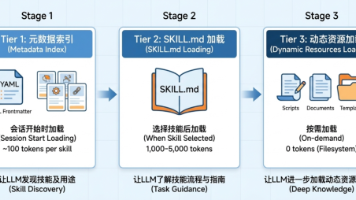

Anthropic 这家“AI 后期之秀”擅长在 Agent 工程领域“整活”。除了大家熟知的MCP(模型上下文协议)外,前两个月抛出了两个新概念:Skills (技能)与 程序化工具调用(PTC),并在自身的Claude开发平台落地支持。

AI Agent(人工智能代理)是一种为执行特定任务而设计的专项独立软件系统,核心特征是能在预设边界内自主感知环境、处理信息并完成目标,无需持续人工干预,是人工智能领域中聚焦 “单一任务落地” 的功能单元。

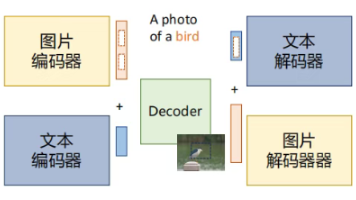

随着 Transformer 架构 的成功,人工智能不仅在语言处理上突飞猛进,在视觉、语音等领域也迎来了突破。如今,研究者们已经能够把“看”和“听”的能力与“语言”结合起来,形成了功能强大的 视觉-语言模型 和 音频-语言模型。

这个问题直击 LLM 落地的核心痛点,非常关键!LLM 应用架构的算力要求无固定标准,核心取决于,核心结论是:推理阶段以中高端 GPU 为主,训练阶段需大规模 GPU 集群,且算力需求随模型参数、并发量呈非线性增长。