简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

ios系统中有很多方式可以播放音频文件,这里我们就详细的说明下播放音乐文件的原理和实例。感兴趣的可以看我写的上面几篇。1. 几种播放音频文件的方式(一) —— 播放本地音乐2. 几种播放音频文件的方式(二) —— 音效播放3. 几种播放音频文件的方式(三) —— 网络音乐播放4. 几种播放音频文件的方式(四) —— 音频队列服务(Audio Queue Services)(一)5. 几种播放音频文

前面用了大量的篇幅介绍了iOS中的音、视频播放和录制,有些地方用到了封装好的播放器、录音机直接使用,有些是直接调用系统服务自己组织封装,正如本篇开头所言,iOS对于多媒体支持相当灵活和完善,那么开放过程中如何选择呢,下面就以一个表格简单对比一下各个开发技术的优缺点。提示:从本文及以后的文章中可能慢慢使用storyboard或xib,原因如下:1.苹果官方目前主推storyboard;

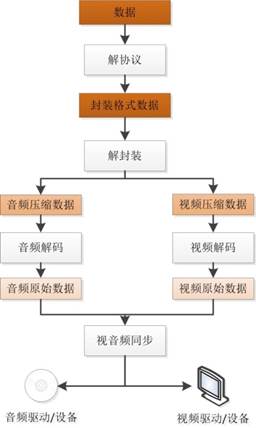

视音频技术主要包含以下几点:封装技术,视频压缩编码技术以及音频压缩编码技术。如果考虑到网络传输的话,还包括流媒体协议技术。视频播放器播放一个互联网上的视频文件,需要经过以下几个步骤:解协议,解封装,解码视音频,视音频同步。如果播放本地文件则不需要解协议,为以下几个步骤:解封装,解码视音频,视音频同步。他们的过程如图所示。

ios系统中有很多方式可以播放音频文件,这里我们就详细的说明下播放音乐文件的原理和实例。感兴趣的可以看我写的上面几篇。1. 几种播放音频文件的方式(一) —— 播放本地音乐2. 几种播放音频文件的方式(二) —— 音效播放3. 几种播放音频文件的方式(三) —— 网络音乐播放4. 几种播放音频文件的方式(四) —— 音频队列服务(Audio Queue Services)(一)5. 几种播放音频文

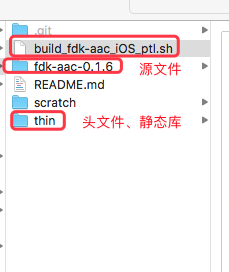

上一篇文章讲到FFmpeg默认的编译静态库中是没有音视频的编码器的,需要我们手动编译进FFmpeg,这篇文章就讲一样如何编译AAC音频编码器,主要还是对脚本的编写工作。和前面编译x264一样,脚本内容大致差不多,通过这个脚本编译即可。到这里就完成了对fdk-aac的编译。进入当前目录,打开终端进行编译就行。直接通过网络下载即可。

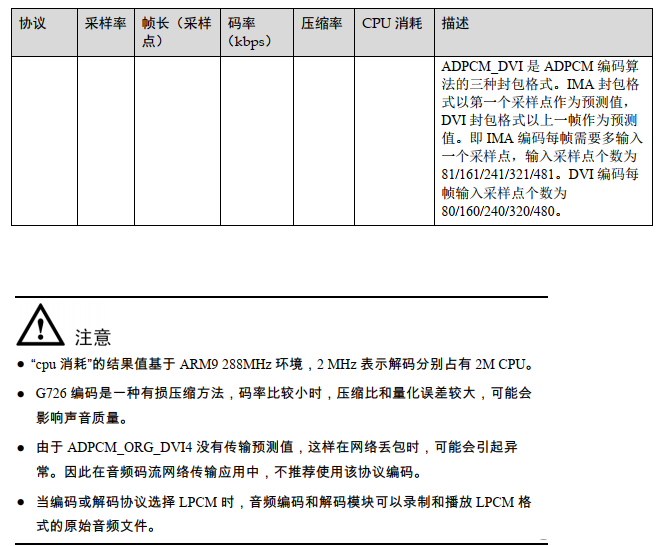

PCM、G726、ADPCM、LPCM、G711、AAC介绍格式对比音频帧长音频播放过程。

我们很难抉择应该给WebRTC应用选哪一款音视频编解码器。VP8?H.264?VP9?还是使用AV1?HEVC呢?*视频编解码器的温馨提示**曾几何时WebRTC世界很简单,只有和G.711。G.711被划掉是因为我不推荐使用它。真的没有理由这样做。后来,作为必须实现的视频编解码器加入。WebRTC进展顺利。之后,谷歌决定在Chrome中引入,将其作为备选编解码器。Mozilla也在Firefox

上一篇文章我们介绍了SurfaceView和TextureView的基础知识点;SurfaceView 以及 TextureView 均继承于 android.view.View,属于 Android 提供的控件体系的一部分。与普通 View 不同,它们都在独立的线程中绘制和渲染。所以,相比于普通的 ImageView 它们的性能更高,因此常被用在对绘制的速率要求比较高的应用场景中,用来解决普通

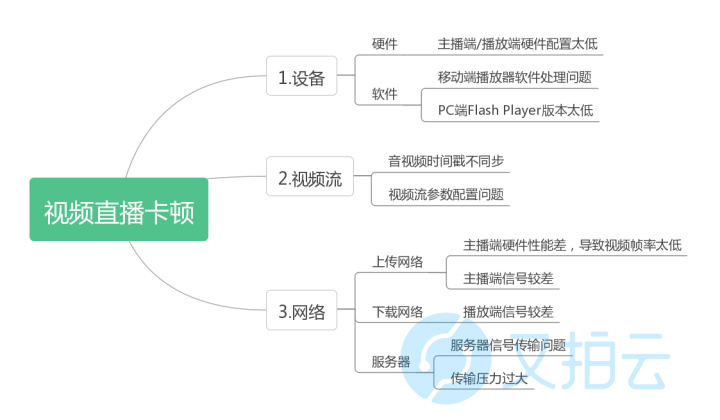

随着视频直播的发展,很多直播团队可能会遇到视频直播卡顿,频繁出现缓冲标志或者直播画面一卡一卡等情况。究竟是哪些原因造成了视频直播观看的卡顿情况呢?又拍直播云结合实践经验,从设备、视频流、网络这三方面进行解剖分析造成直播卡顿的问题及其解决方法。

在「简单了解 iOS CVPixelBuffer (中)」中,我们了解了颜色空间RGB和YUV的区别以及相关的背景知识,最后对中的相关类型进行了解读。我们已经对有了初步的了解,在这篇文章中,我们将继续聊聊在使用过程中的一些格式转换;RGB和YUV格式转换在很多场景下,我们需要将不同的颜色空间进行转换,以此来解决对应的工程性问题。