简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

LLM大语言模型(十):LangChain自定义Agent使用自定义的LLM

独立部署ChatGLM3-6B并提供HTTP API能力。自定义LLM封装对ChatGLM3-6B的访问。创建一个简单的Agent来使用自定义的LLM。

ffmpeg-go库的介绍

本质上ffmpeg-go是对命令行ffmpeg工具的封装,最终功能的实现都是通过在go里执行命令行工具来实现。在go代码中调用ffprobe命令行工具。

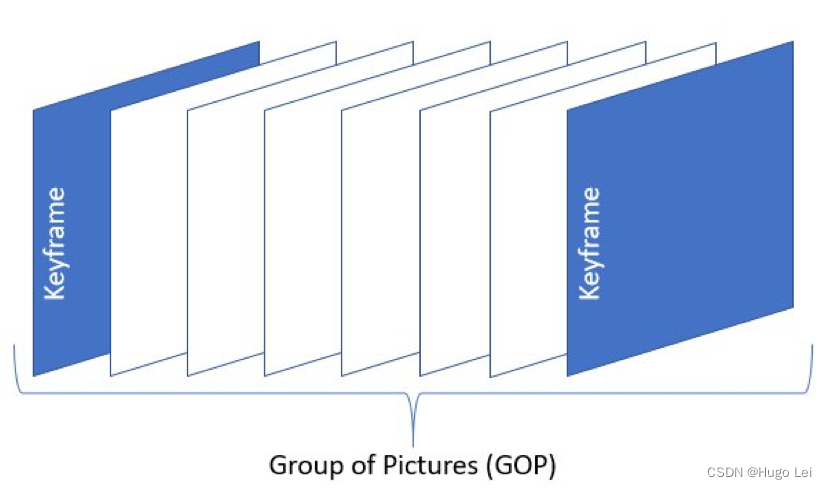

AI视觉领域流媒体知识入门介绍(二):深入理解GOP

对GOP的理解,要基于视频编解码的基本原理来。

LLM大语言模型(七):部署ChatGLM3-6B并提供HTTP server能力

部署ChatGLM3-6B并对外提供HTTP server能力

LLM大语言模型(十三):ChatGLM3-6B兼容Langchain的Function Call的一步一步的详细转换过程记录

ChatGLM3-6B兼容Langchain的Function Call的一步一步的详细转换过程记录

Llama(二):Open WebUI作为前端界面,使用本机的llama3

Open WebUI是一个可扩展、功能丰富、用户友好的自托管WebUI,旨在完全离线操作。它支持各种LLM运行程序,包括Ollama和OpenAI兼容的API。

LLM大语言模型(三):使用ChatGLM3-6B的函数调用功能前先学会Python的装饰器

本文介绍了如何在ChatGLM3-6B中使用自定义函数,来扩展大模型的能力。

LLM大语言模型(十五):LangChain的Agent中使用自定义的ChatGLM,且底层调用的是remote的ChatGLM3-6B的HTTP服务

本文搭建了一个完整的LangChain的Agent,调用本地启动的ChatGLM3-6B的HTTP server。为后续的RAG做好了准备。

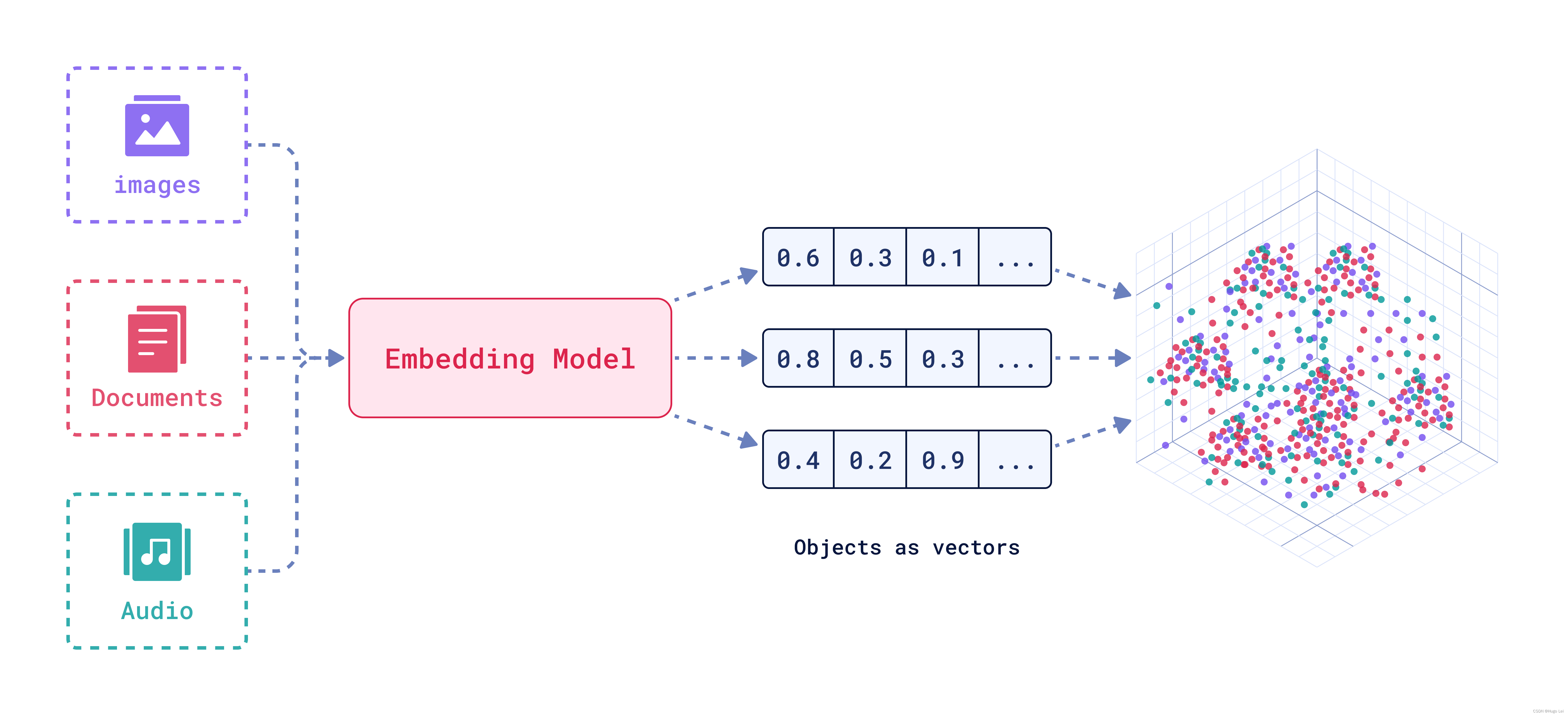

LLM大语言模型(六):RAG模式下基于PostgreSQL pgvector插件实现vector向量相似性检索

在LLM的RAG场景下,使用PostgreSQL+pgvector插件,作为向量数据的管理后端,简单高效。

LLM大语言模型(八):ChatGLM3-6B使用的tokenizer模型BAAI/bge-large-zh-v1.5

BGE embedding系列模型是由智源研究院研发的中文版文本表示模型。可将任意文本映射为低维稠密向量,以用于检索、分类、聚类或语义匹配等任务,并可支持为大模型调用外部知识。