简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

问题:Oracle数据库中大概有多少条error message?解答:根据对Oracle官网资料(https://docs.oracle.com/cd/E11882_01/server.112/e17766/title.htm)的分析,估算为1万条以上。以下为整理的前400条error message,相比半结构化的网页数据,整理出来的结构化表格看着舒服多了。 Oracl...

继续学习VBA。在实际工作中,发现用Excel连接Oracle数据库有时有问题:1. 在Toad中运行良好的脚本,到了Excel query里就有问题了(不知是否因为脚本中包含了一些聚合函数的原因)。2. 在Excel中连接数据库,刷新数据的速度很慢。Toad中查询数据并导出到Excel用时两分钟,在Excel中直接刷新耗时可达20分钟。当然,优点是多了一条获取数据的路径(用户无需安装Toad等数

数据分析中,经常要用到频度分析。在Spotfire中,可通过插入Binned Column方式自定义频度,快速、便捷的进行频度分析。比如,通过原始数据统计出的词频表如下所示:由于各词类的词条数相差很大(最少1条,最多几千条),放在同一张图上基本没法看。虽然可以使用Show/Hide Items来仅显示一部分数据(如Top 40),如下图所示,但毕竟,不能反映数据全貌。

游戏规则如下:a gambling game played with two dice; a first throw of 7 or 11 wins and a first throw of 2, 3, or 12 loses and a first throw of any other number must be repeated to win before a 7 is thrown

第一次使用Excel的数据分析功能绘制直方图,发现有比较严重的bug。从来没发现Excel会有如此严重的bug。正确的直方图:Excel自动绘制的直方图:修正方法:手动修改横坐标轴及累积百分比的数据引用。

数据如下:分析图表:容易看出,排名前5的人口大省为:广东、山东、河南、四川、江苏(人口多,不代表经济强哦)人口增长最快的5个省份是:北京、天津、上海、广东、浙江(都是发达地区啊)人口增长绝对数量最多的5个省份是:广东、浙江、北京、上海、河北(前4名经济都挺强)后记:本例本来是要用水晶易表来展现出以下效果,但我感觉,从数据模型角

《谁说菜鸟不会数据分析》这本书,看起来是本给小白看的书,实则内容丰富,值得认真学习。从今天开始,看第三遍,顺便写个读书笔记,备忘。数据分析类型:描述性数据分析、探索性数据分析、验证性数据分析数据分析作用:现状分析、原因分析、预测分析数据分析六步曲:明确分析目的和思路——》数据收集——》数据处理——》数据分析——》数据展现——》报告撰写PEST分析框架:政治、经济、社会、

Unit 7 -Mark Twain-Mirror of AmericaMark Twain-Mirror of AmericaNoel GroveMost Americans remember Mark Twain as the father of Huck Finn's idyllic cruise through eternal boyhood and Tom Sawyer's endles

大数据特点:Volume(数据量大), Variety(数据类型多样), Velocity(数据处理实时性强), Veracity(数据真实性)Access数据库窗口中包含6大对象:表、查询、窗体、报表、宏、模块(这和Oracle简直判若两物啊)导入数据的方法:直接导入、建立链接合并数据的方法:横向合并(即,多表关联查询)、纵向合并(数据集行数增加,列数不变)内连接、左连接

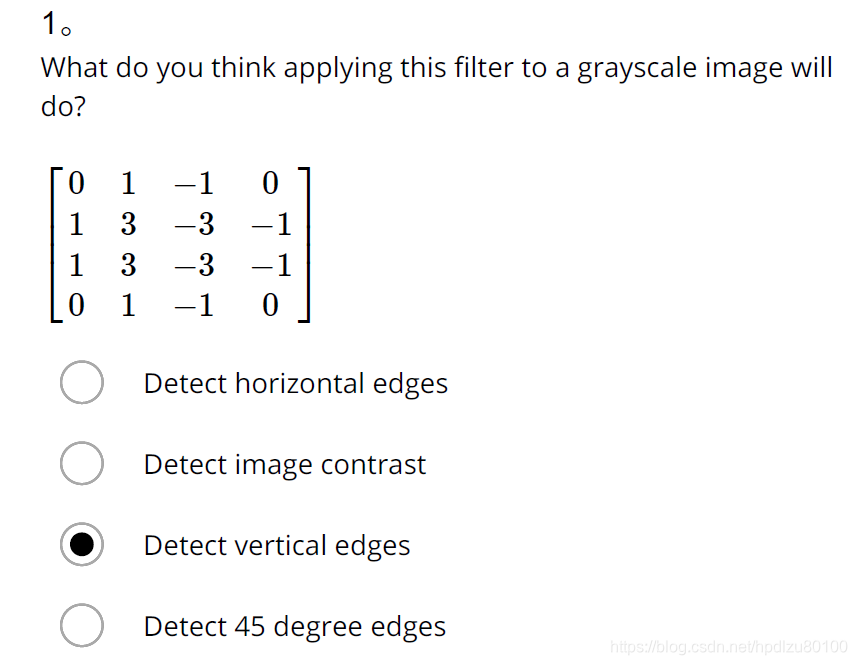

C4W1 Quiz - The basics of ConvNetsAns: CAns: DNote: 100*(300*300*3)+100 = 27000100Ans: BNote: 5*5*100 + 100 = 2600Ans: CNote: n=63, f=7, nC=32, s=2, p=0nH=nW=(n+2p-f)/s+1=(63-7)/2+1=29Shape of output: