简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

在使用claude code的时候,我发现,我提供了一系列的操作规范,比如代码编译,容器创建,资源初始化等标准化的操作规范,我让它按照规范执行操作。会话前期,它会严格执行,但是会话长了以后,它会忽略掉我的标准规范,导致编写代码报错,执行报错等问题,然后逐渐失控。我的方案是提供docs目录,放置大量操作规范,是不是采用skills技术,会跟家稳定呢?

(fds)</div><div>犯得上发射点

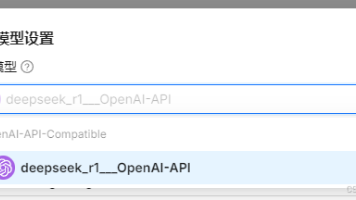

更新系统模型设置,可以看到添加的本地模型了。

接上篇下载Qwen-VL-Chat-Int4版本模型这个版本模型体积小不少2060 6G 仍然不能启动web尝试参考模型中的README.md编写使用量化的代码test.py启动报错这个脚本的依赖与requirements.txt有一定差异参考文档手动安装故障依旧AI分析然而,根据之前的错误信息,对象似乎缺乏方法,导致在尝试从预训练模型加载时抛出了异常。这可能意味着在您当前安装的版本中,对于如何与

设置模型支持的最大上下文长度为81,920 tokens。:预留4GB的CPU内存/磁盘空间作为GPU内存交换区。:缓解GPU内存不足问题(单位可能是GB,需确认文档)。:API请求时可通过此名称指定模型(多模型部署时重要)。:指定容器内模型文件的路径(对应挂载的宿主机目录)。:支持超大模型推理(如32B参数模型需多卡并行)。:节省GPU内存,同时保持数值稳定性(适合推理)。:设置张量并行度为8,

多卡运行分布式训练卡死 - 知乎

在使用claude code的时候,我发现,我提供了一系列的操作规范,比如代码编译,容器创建,资源初始化等标准化的操作规范,我让它按照规范执行操作。会话前期,它会严格执行,但是会话长了以后,它会忽略掉我的标准规范,导致编写代码报错,执行报错等问题,然后逐渐失控。我的方案是提供docs目录,放置大量操作规范,是不是采用skills技术,会跟家稳定呢?

在使用claude code的时候,我发现,我提供了一系列的操作规范,比如代码编译,容器创建,资源初始化等标准化的操作规范,我让它按照规范执行操作。会话前期,它会严格执行,但是会话长了以后,它会忽略掉我的标准规范,导致编写代码报错,执行报错等问题,然后逐渐失控。我的方案是提供docs目录,放置大量操作规范,是不是采用skills技术,会跟家稳定呢?

知识本体并非要取代关系数据库,而是与其互补。它将数据从“记录的集合”升华为“知识的网络”,赋予机器理解与推理的能力。传统数据库(如PostgreSQL)通过扩展(如向量插件、图查询)支持更多语义操作。推理机不断优化,通过混合存储、并行计算等手段逼近海量数据的实时处理。AI原生数据库的兴起,将逻辑推理、机器学习能力深度集成到数据平台中。对于企业而言,知识本体是构建智能化应用(如智能问答、决策支持、风