简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

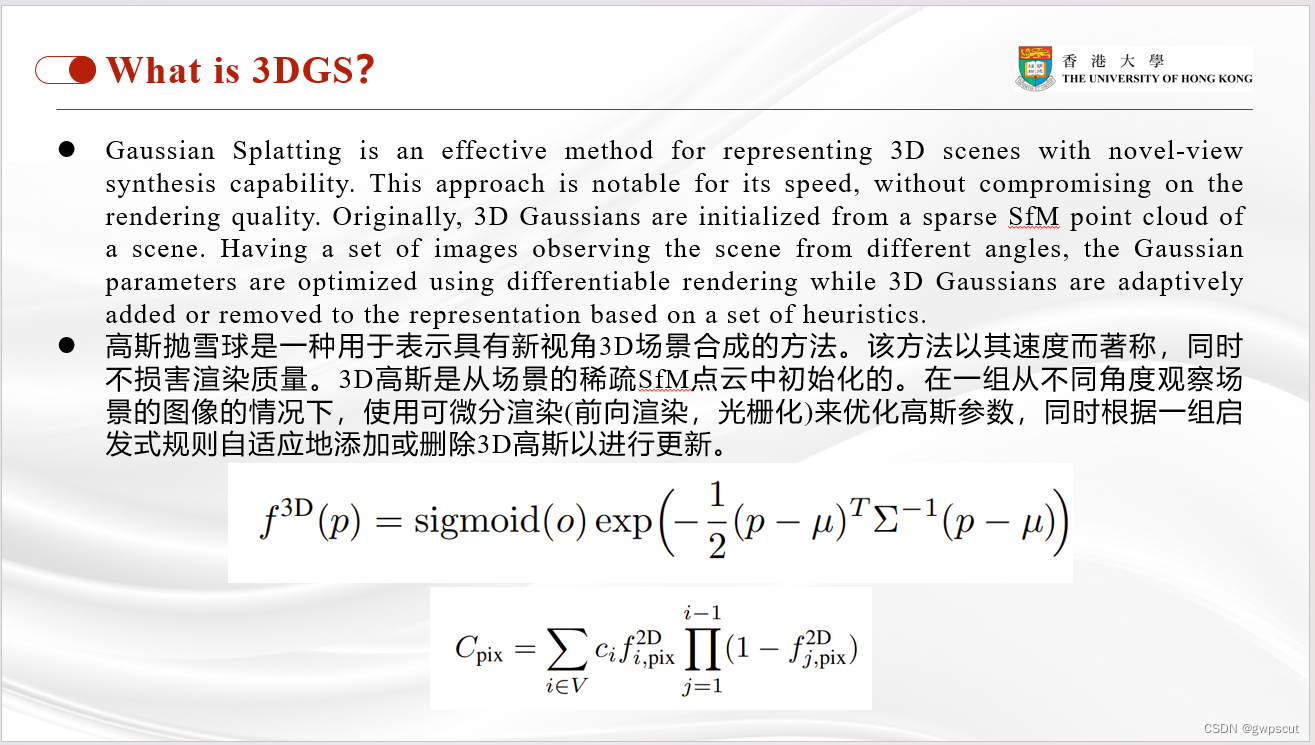

最近对一系列基于3D Gaussian Splatting(3DGS)SLAM的工作的源码进行了测试与解读。为此写下本博客mark一下所有的源码解读以及对应的代码配置与测试记录~其中工作1~5的原理解读见博客:学习笔记之——3D Gaussian Splatting及其在SLAM与自动驾驶上的应用调研_3d gaussian splatting slam-CSDN博客。但由于其相关工作太多了,为此

本博文为本人的学习笔记。参考材料为《深度学习入门之——PyTorch》pytorch中文网:https://www.pytorchtutorial.com/ 关于反卷积:https://github.com/vdumoulin/conv_arithmetic/blob/master/README.md关于卷积和反卷积函数中的参数——“dilation(int or tuple, opt...

本博文为本人学习深度强化学习的学习笔记。仅供本人学习记录用,如有写得不对的地方,请多指教哈~目录强化学习深度强化学习基于深度强化学习的移动机器人导航参考资料:Deep Reinforcement Learning,百度百科上对其解释是“深度强化学习将深度学习的感知能力和强化学习的决策能力相结合,可以直接根据输入的图像进行控制,是一种更接近人类思维方式的人工智能方...

最近看了系列论文,对于里面的attention机制理解不到位,为此写下这篇博文,作为对attention机制的学习笔记。本文的文字来源于网络的各种推文、博客加本人的总结。仅供本人学习记录用,不做商业用途基于RNN(循环神经网络)的attention机制,直接百度搜的话,应该大多数都是机器翻译或自然语言处理方面的。本文主要介绍CV中的attention机制。注意力(attention)...

图像补全(image inpainting)要求算法根据图像自身或图像库信息来补全待修复图像的缺失区域,使得修复后的图像看起来非常自然,难以和未受损的图像区分开。根据恐怖谷理论,只要填补内容和未受损区域有细微的不协调,就会非常显眼。因此高质量的图像补全不仅要求生成的内容语义合理,还要求生成的图像纹理足够清晰真实。目前最好的图像补全的方法主要分为两类:一类是经典的纹理合成方法,核心是从图像的未受..

之前博客《ROS学习笔记之——Navigation Stack及路径规划》介绍了navigation stack,其中涉及到的amcl以及避障还没有详细的展开AMCL避障(avoid obstales)Robot Navigation Challenge参考资料http://wiki.ros.org/amcl不错的视频学习链接(https://www.youtube.com/r...

首先安装驱动sudo add-apt-repository ppa:ubuntu-toolchain-r/testsudo add-apt-repository ppa:inivation-ppa/inivation-bionicsudo apt-get updatesudo apt-get install dv-gui但是运行的时候出现报错[ WARN] [1632472696.85824933

本博文为本人学习三维重建的学习笔记,本博文的大部分内容来源于网络各类教程博客,本博文仅供本人学习记录用。

最近在做移动机器人路径规划相关的topic,打算对路径规划算法做一个调研,并写下这篇记录。本博文的大部分内容来源于网络的博客或者论文,相关的参考也会给出来。本博文仅作本人学习记录用。参考资料https://blog.csdn.net/chauncygu/article/details/78031...

本博文为本人学习深度强化学习的学习笔记。仅供本人学习记录用,如有写得不对的地方,请多指教哈~目录强化学习深度强化学习基于深度强化学习的移动机器人导航参考资料:Deep Reinforcement Learning,百度百科上对其解释是“深度强化学习将深度学习的感知能力和强化学习的决策能力相结合,可以直接根据输入的图像进行控制,是一种更接近人类思维方式的人工智能方...