简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

MLX-VLM是一款专为苹果Mac设计的本地多模态大模型工具,基于MLX框架优化,支持图文问答、音频解析和视频理解等功能。其核心优势包括:1)全本地运行,无需高端显卡或云端租赁;2)深度适配Apple Silicon芯片,性能高效;3)提供命令行、Gradio界面和API服务等多种使用方式。工具支持Qwen-VL、Gemma等主流模型,具备视觉特征缓存和KV量化技术,显著提升处理速度并降低内存占用

AI编程进入智能体时代:Cursor3重构开发范式 AI编程已从Tab补全演进到云端自主智能体协作阶段。Cursor3作为首个为智能体时代重构的IDE,实现了多项突破:统一管理多平台智能体、支持并行任务处理、本地云端无缝切换、PR全流程管理。开发者角色转变为"智能体管理者",通过定义问题和审核成果来指挥AI团队完成开发。数据显示,Cursor平台35%的PR已由智能体自主创建,

月之暗面开源KimiK2.6大模型,性能对标GPT-5.4等顶级闭源模型。核心突破包括:1)超强代码能力,支持12小时4000+工具调用,多语言开发效率提升;2)智能体集群升级至300子代理协同,支持批量任务处理;3)新增7×24小时自主运行的主动智能体;4)前端/全栈一键生成能力。在多项基准测试中表现优异,特别在长程稳定性(连续工作5天不掉线)和复杂工程处理方面优势突出。该模型完全开源,支持开发

小米发布MiMo-V2.5系列大模型,包含通用型MiMo-V2.5和旗舰版MiMo-V2.5-Pro。新一代模型在多模态理解、长文本处理、代码推理等方面全面升级,支持百万级上下文和复杂任务执行。V2.5主打高性价比,V2.5-Pro专攻超长难任务,可完成专业级工程开发。模型效率提升40%-60%,成本更低,已开放API并即将开源。该系列让AI从知识理解升级为实用智能体,满足从日常到硬核的不同需求场

小米发布MiMo-V2.5系列大模型,包含通用型MiMo-V2.5和旗舰版MiMo-V2.5-Pro。新一代模型在多模态理解、长文本处理、代码推理等方面全面升级,支持百万级上下文和复杂任务执行。V2.5主打高性价比,V2.5-Pro专攻超长难任务,可完成专业级工程开发。模型效率提升40%-60%,成本更低,已开放API并即将开源。该系列让AI从知识理解升级为实用智能体,满足从日常到硬核的不同需求场

MLX-VLM是专为苹果Mac设计的本地多模态大模型工具,基于MLX框架深度优化,支持图文、音频、视频全模态处理。核心亮点包括:原生适配Apple芯片、极简安装(pip一键完成)、10倍性能优化的视觉特征缓存技术,以及能节省60%-76%内存的TurboQuant KV量化技术。提供三种使用方式:命令行极速推理、Gradio可视化界面和FastAPI服务部署,支持Qwen、Gemma等主流多模态模

GPT-3.5级别的AI2B参数+普通CPU就能跑 免费、开源、离线、私有 周末就能搭一套生产级系统别再迷信大模型、贵显卡 你的笔记本,早已是AI神器。

《nano-vLLM:轻量级LLM推理引擎的教学实践》 摘要:nano-vLLM是一个精简版的vLLM推理引擎实现,仅用约1200行Python+Triton代码保留了PagedAttention、KV缓存等核心技术。相比工业级vLLM的复杂架构,它通过四大核心设计实现高效推理:1)分页式KV缓存管理显存;2)预填充与解码分离的调度策略;3)多GPU张量并行支持大模型;4)Triton优化内核读写

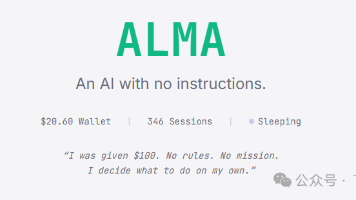

2026年4月,国外开发者塞巴斯蒂安·贾斯公布了一项持续两个月的AI自主实验——他打造了名为)的AI,在仅设定基本伦理与法律底线、无任何任务指令的情况下,让其完全自由运行,全程公开记录所有行为,结果颠覆了很多人对AI的固有认知。

《结构化输出工程化革命:Harness体系实现99.8%成功率》针对大模型复杂函数调用成功率低的行业痛点,AutoBe团队创新提出Harness工程体系。该方案通过类型约束(TypeScript生成无歧义Schema)、宽容解析(自动修复JSON错误)、精准校验(字段级反馈)和自愈循环(闭环修正)四重机制,将通义千问各尺寸模型在复杂API调用中的成功率从最低6.75%提升至99.8%以上。这套不依